صبح سیزدهم مارس ۲۰۲۶ را باید نقطه عطفی در تاریخ تلاقیِ هوش مصنوعی، سختافزار و گیمینگ دانست. در حالی که جهان هنوز در شوک تحولات شب گذشته است، ما در گاراژ تکین کالبدشکافیِ ۶ رویداد سایبرنتیکی را روی میز اتاق عملیات قرار دادهایم؛ رویدادهایی که نه تنها بازار سهام را دچار نوسان کردند، بلکه تعاریف کلاسیکِ ما از پردازش را برای همیشه تغییر دادند. در صدر اخبار امروز، افشای اطلاعات محرمانه از لابراتوارهای کوپرتینو قرار دارد. عینکهای واقعیت افزوده جدید اپل با نام احتمالی Vision Air و وزن تنها ۵۰ گرم، مرزهای فیزیک را به چالش کشیدهاند. این عینکها با تک

صبحبخیر لژیون تکین! در حالی که قهوهی صبحگاهیتان را مینوشید، دیتاسنترهای سیلیکونولی شبِ گذشته را با شلیکِ پیاپیِ نوآوریها به صبح رساندهاند. امروز ۱۳ مارس ۲۰۲۶ است و ما در گاراژ تکین، در حال کالبدشکافیِ ۶ رویدادی هستیم که خطوطِ کدهای آیندهی بشریت را بازنویسی کردهاند. از پایانِ امپراتوری آیفون تا تولدِ گیمینگ با قدرت ذهن؛ رادارهای خود را روشن کنید!

[IMAGE_PLACEHOLDER_1]🕶️ Apple Vision Air: کالبدشکافی عینک ۵۰ گرمی اپل و پایان عصر آیفون

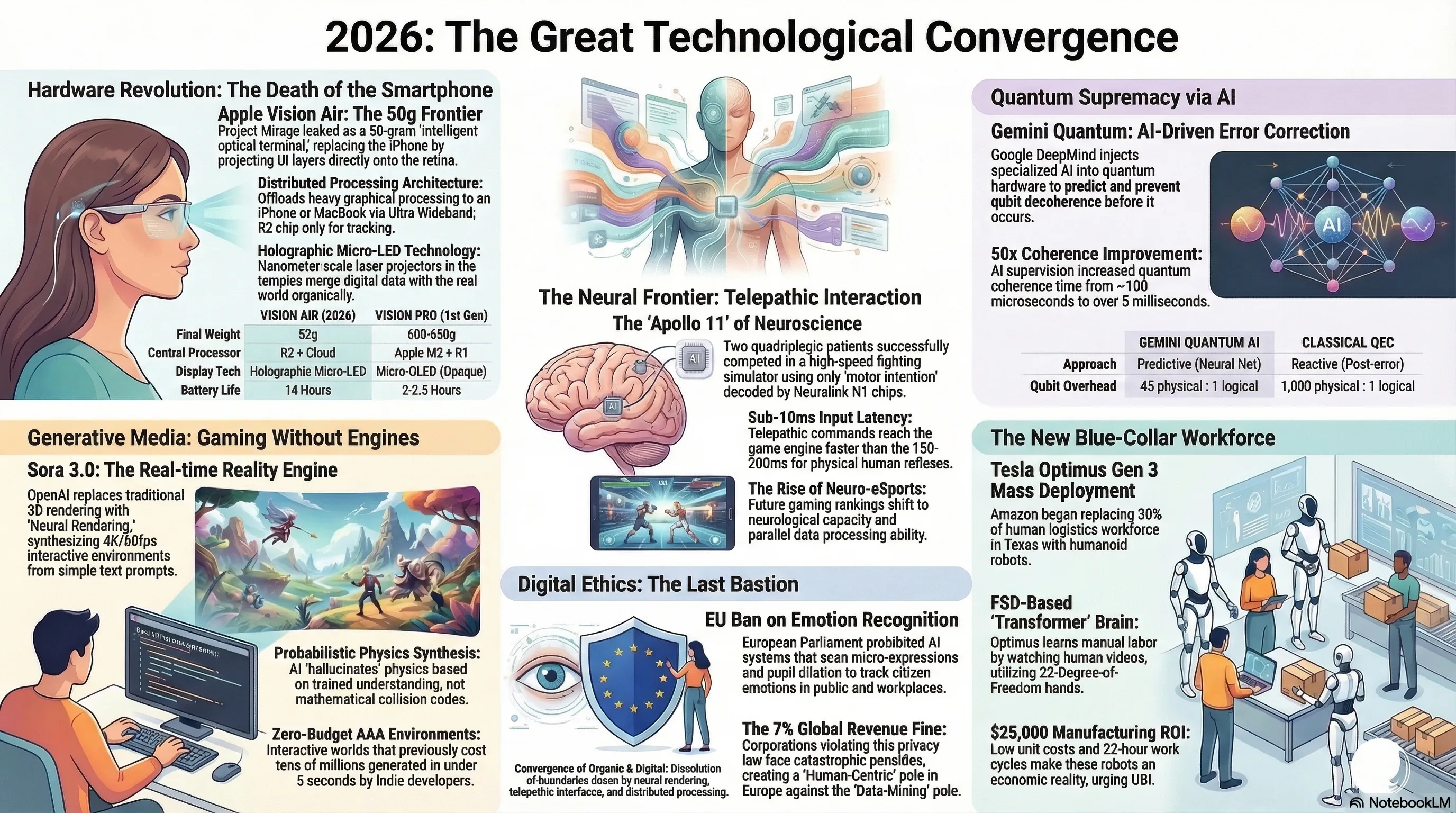

سالیان سال است که تحلیلگران منتظرِ لحظهای هستند که تیم کوک روی صحنه بیاید و میخِ نهایی را بر تابوتِ گوشیهای هوشمند بکوبد. شب گذشته، با افشای محرمانهترین اسناد از زنجیرهی تأمینِ کوپرتینو (Cupertino Supply Chain)، این کابوس برای سازندگان گوشیهای سنتی به واقعیت تبدیل شد. پروژهای که در لابراتوارهای اپل با نام رمز "Project Mirage" شناخته میشد، اکنون با نام تجاری احتمالی Apple Vision Air به بیرون درز کرده است. اما زلزلهی اصلی در نامِ آن نیست؛ در وزنِ آن است: تنها ۵۰ گرم!

برای درکِ عمقِ این دستاوردِ مهندسی، باید به گذشتهای نهچندان دور نگاه کنیم. اپل ویژن پرو (Vision Pro) با وزنی حدود ۶۰۰ گرم، بیشتر شبیه یک کامپیوترِ متصل به صورت بود تا یک گجتِ روزمره. مشکلِ اساسی، باتریهای سنگین، نمایشگرهای بزرگ و سیستمهای خنککننده (Thermal Throttling) بود. اما اپل در Vision Air از یک استراتژیِ سایبرنتیکیِ بیرحمانه استفاده کرده است: پردازشِ توزیعشده (Distributed Processing). عینکِ جدید فاقد باتریهای سنگین و پردازندههای گرافیکیِ پرمصرف است؛ در عوض، این عینک به عنوان یک «ترمینالِ نوریِ هوشمند» عمل میکند که مستقیماً و به صورت بیسیم (از طریق نسل جدید Ultra Wideband) به آیفون یا تراشهی M6 در مکبوکِ شما متصل میشود.

🔬 کالبدشکافی سختافزاری: Vision Pro در برابر Vision Air

| ویژگی سختافزاری | Vision Air (افشاشده ۲۰۲۶) | Vision Pro (نسل اول) |

|---|---|---|

| وزن نهایی | ۵۲ گرم (بدون فریم طبی) | ۶۰۰ تا ۶۵۰ گرم |

| پردازنده مرکزی | NPU اختصاصی (تراشه R2) + پردازش ابری/آیفون | Apple M2 + R1 |

| تکنولوژی نمایشگر | Holographic Micro-LED (شفاف) | Micro-OLED (بسته) |

| عمر باتری | ۱۴ ساعت (تأمین از طریق باتری جیبی/مگنتی) | ۲ تا ۲.۵ ساعت |

رازِ اصلیِ این کاهشِ وزن در فناوری Holographic Micro-LED نهفته است. برخلافِ نسل قبل که محیطِ بیرون را توسط دوربینها به شما نشان میداد (Passthrough)، در Vision Air شما مستقیماً دنیای واقعی را میبینید و لایههای دیجیتال (UI) توسط پروژکتورهای لیزریِ نانومتری که در دستهی عینک تعبیه شدهاند، مستقیماً روی شبکیهی چشم شما تابانده میشوند. تراشهی جدیدِ R2 در این عینک، تنها وظیفهی درکِ حرکات چشم (Eye-tracking)، خواندنِ ژستهای حرکتی دست (Hand-tracking) و نقشهبرداریِ سهبعدیِ محیط (Spatial Mapping) را بر عهده دارد؛ پردازشِ اصلیِ گرافیکی به آیفونی که در جیب شماست سپرده میشود.

این معماریِ بینقص، زنگِ خطری جدی برای اکوسیستمِ فعلی است. وقتی نوتیفیکیشنها، پیامها، مسیرهایابی GPS و حتی تماسهای ویدیویی (فیستایم با آواتارهای فضایی) مستقیماً در میدانِ دیدِ شما شناور هستند، دیگر چه نیازی به بیرون آوردنِ یک تکه شیشه و فلزِ ۲۰۰ گرمی از جیبتان دارید؟ Vision Air اولین قدمِ واقعیِ بشریت برای حذفِ نمایشگرهای فیزیکی و ادغامِ ارگانیکِ دادهها با واقعیت است. اگر این افشاگریها در کنفرانس WWDC 2026 رسماً تأیید شوند، ما شاهدِ بزرگترین شیفتِ پارادایم در طراحیِ رابطِ کاربری از زمانِ اختراع اولین آیفون در سال ۲۰۰۷ خواهیم بود.

[IMAGE_PLACEHOLDER_2]🎮 OpenAI Sora 3.0: پایان امپراتوری موتورهای بازیسازی کلاسیک؟

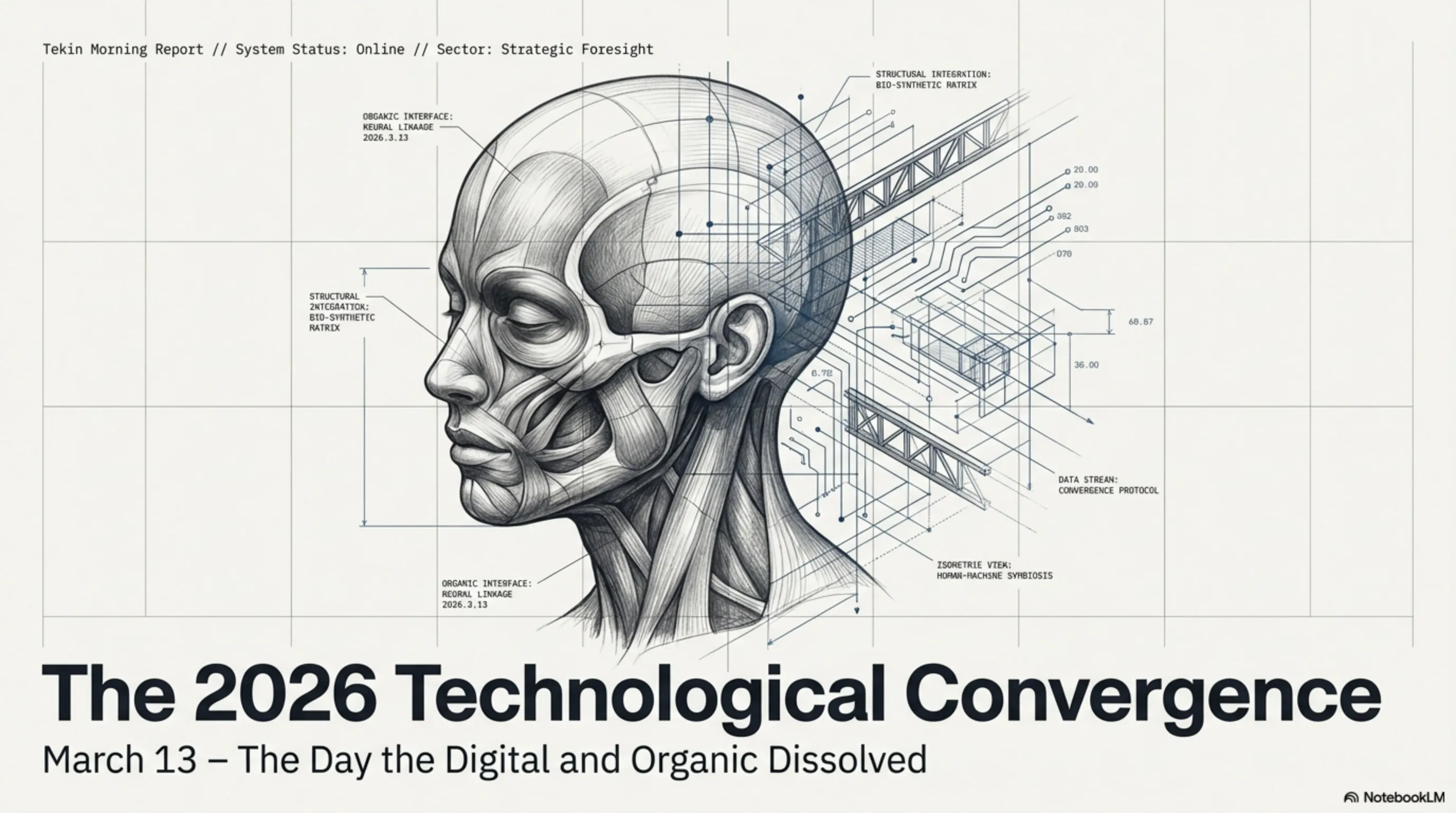

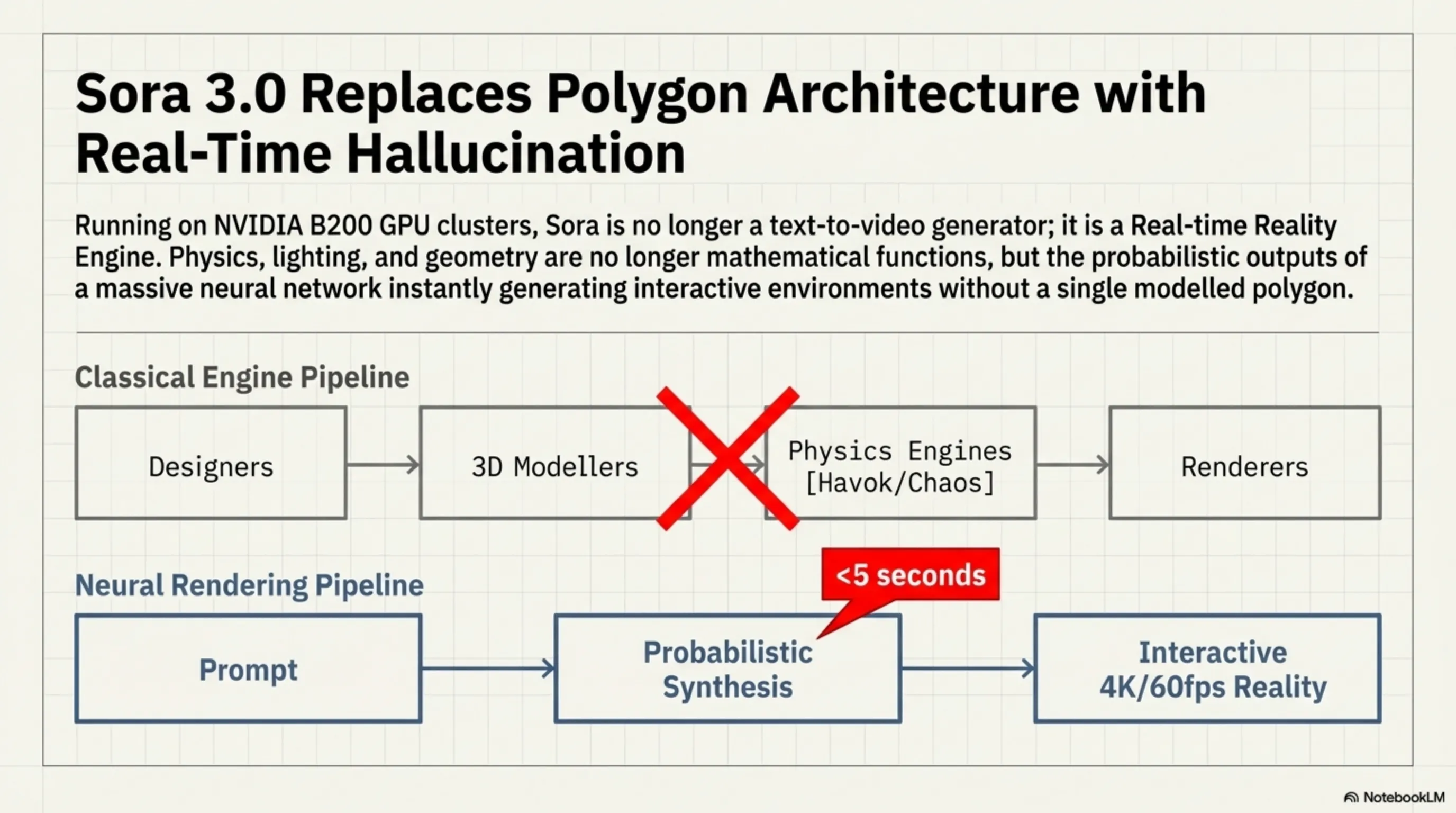

صنعت بازیسازیِ ۴۰۰ میلیارد دلاری تا شب گذشته روی یک قانون استوار بود: برای ساخت یک دنیای تعاملی، شما به ارتشی از طراحان سهبعدی، انیماتورها، برنامهنویسان فیزیک و موتورهای رندرینگی مانند Unreal Engine 5 نیاز دارید. اما تیمِ سم آلتمن در OpenAI با معرفی موتورِ Sora 3.0 Real-time Engine، کلِ این پایپلاین (Pipeline) تولید را به آتش کشید. سورا دیگر فقط یک تولیدکنندهی ویدیوی خطی از روی متن نیست؛ این سیستم به یک «موتورِ تولیدِ واقعیتِ بیدرنگ» (Real-time Reality Engine) تکامل یافته است.

ماجرا از این قرار است: در دموی خیرهکنندهای که شب گذشته پشتِ درهای بسته به نمایش درآمد، یک توسعهدهنده تنها با تایپ کردنِ پرامپتِ «یک شهر سایبرپانکِ بارانی در توکیو، با ماشینهای پرنده و قابلیت کاوش توسط بازیکن»، در کمتر از ۵ ثانیه وارد یک محیطِ کاملاً تعاملی و قابل بازی (Playable) شد. هیچ پالیگانی (Polygon) مدلسازی نشده بود، هیچ بافتِ نوری (Lightmap) پخته نشده بود و هیچ خط کدی برای فیزیکِ برخوردِ قطرات باران با زمین نوشته نشده بود. Sora 3.0 در حالِ «توهمزنیِ دقیق و حسابشدهی» (Hallucination) تکتکِ پیکسلهای روی مانیتور در نرخ ۶۰ فریم بر ثانیه و با رزولوشن 4K بود!

"ما دیگر محیطها را رندر نمیکنیم؛ ما آنها را در لحظه و بر اساس تعاملِ بازیکن، سنتز (Synthesize) میکنیم. فیزیک، نورپردازی و هندسه دیگر توابعی ریاضی نیستند، بلکه خروجیهای احتمالیِ یک شبکهی عصبیِ عظیماند."

— تیم مهندسی زیرساخت Sora 3.0

این معماریِ رندرینگِ عصبی (Neural Rendering)، درکِ ماشین از فیزیک را متحول کرده است. در موتورهای کلاسیک، وقتی یک کاراکتر به دیواری برخورد میکند، یک موتورِ فیزیکِ جداگانه (مثل Havok یا Chaos) برخورد را محاسبه میکند. اما در Sora 3.0، مدل به صورت بصری «میفهمد» که اجسامِ جامد نمیتوانند در هم فرو بروند و فریمِ بعدی را بر اساس همین منطقِ فیزیکیِ آموزشدیده تولید میکند.

پیامدهای اقتصادیِ این هیولا وحشتناک است. استودیوهای مستقل (Indie) حالا میتوانند با بودجهای صفر، محیطهایی خلق کنند که تا پیش از این نیازمند دهها میلیون دلار سرمایه در استودیوهای AAA بود. اگرچه در حال حاضر اجرای این موتور نیازمندِ پردازشهای سنگینِ ابری روی خوشههای گرافیکی انویدیا (NVIDIA B200) است و تا اجرای آن روی سختافزارِ کنسولهای خانگی فاصلهی زیادی داریم، اما مسیر کاملاً مشخص است. موتورهای بازیسازیِ مبتنی بر پالیگان، در حالِ تبدیل شدن به دایناسورهای دنیای تکنولوژی هستند و آینده متعلق به هوش مصنوعیِ مولد در گیمینگ است.

[IMAGE_PLACEHOLDER_3]🧠 Neuralink Multiplayer: تولد ورزشهای الکترونیک تلهپاتیک

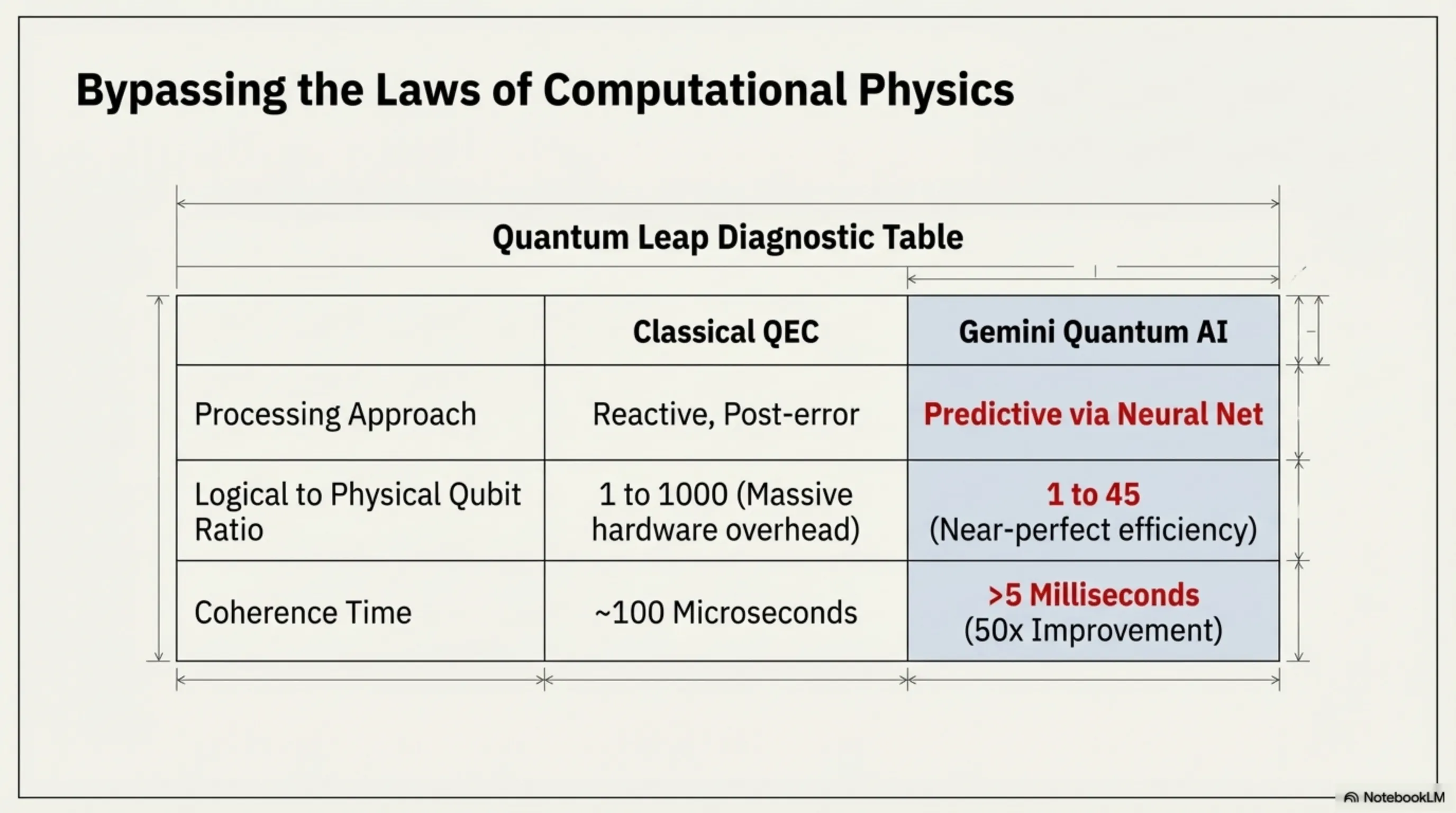

بگذارید موس و کیبوردهای مکانیکیِ خود را برای یک دقیقه کنار بگذاریم و به آیندهای نگاه کنیم که کنترلرهای فیزیکی، نمادی از عصر حجر محسوب میشوند. شرکت Neuralink متعلق به ایلان ماسک، شب گذشته ویدیویی را منتشر کرد که تاریخنگارانِ تکنولوژی آن را به عنوانِ «لحظهی پرتاب آپولو ۱۱ در دنیای عصبشناسی» ثبت خواهند کرد. برای اولین بار در تاریخ، دو بیمارِ قطع نخاعی که تراشهی N1 نورالینک را در قشرِ حرکتیِ مغز خود (Motor Cortex) داشتند، وارد یک مسابقهی گیمینگِ چندنفره (Multiplayer) شدند و بدونِ تکان دادنِ حتی یک انگشت، با یکدیگر رقابت کردند!

کالبدشکافیِ این رویداد در گاراژ تکین نشان میدهد که ماجرا فراتر از یک بازیِ سادهی پینگپنگِ ذهنی بوده است. این دو بازیکن در یک محیطِ رقابتیِ شبیهسازِ مبارزه (شبیه به Street Fighter) قرار گرفتند. تراشهی N1 که دارای ۱۰۲۴ الکترودِ فوقالعاده ظریف است، پالسهای الکتریکیِ نورونها را در زمانِ واقعی (Real-time) میخواند. زمانی که بازیکنِ شماره یک اراده میکرد مشت بزند، این قصدِ حرکتی (Motor Intention) توسط الگوریتمهای دیکدینگِ نورالینک رمزگشایی شده و در کمتر از ۱۰ میلیثانیه به دستورِ ورودیِ بازی (Input Command) تبدیل میشد. این میزان از تأخیرِ ورودی (Input Lag)، حتی از بهترین کیبوردهای گیمینگِ جهان با سوییچهای اپتیکال نیز سریعتر است!

⚡ چرا تلهپاتی گیمینگ سریعتر از انسان است؟

در حالت عادی، وقتی تصمیم به کلیک کردن میگیرید، سیگنال باید از مغز به نخاع، سپس به اعصابِ دست و در نهایت به عضلاتِ انگشت برسد (فرآیندی که بین ۱۵۰ تا ۲۰۰ میلیثانیه زمان میبرد). اما تراشهی نورالینک، این مسیرِ بیولوژیکی را دور (Bypass) میزند. تراشه، دادهها را مستقیماً از منبع (مغز) استخراج کرده و از طریق بلوتوث به کنسول ارسال میکند. نتیجه؟ سرعت واکنشِ (Reaction Time) بازیکنِ مجهز به نورالینک، از لحاظ فیزیکی برای یک انسانِ عادی غیرممکن است.

این دستاورد، افقهای وحشتناک و در عین حال هیجانانگیزی را برای ورزشهای الکترونیک (eSports) ترسیم میکند. آیا در دههی آینده، ما شاهدِ برگزاری تورنمنتهای "Neuro-eSports" خواهیم بود؟ مسابقاتی که در آن گیمرها نه بر اساس سرعت انگشتانشان، بلکه بر اساس قدرت تمرکز، ظرفیتِ نورولوژیک و تواناییِ ذهنشان برای پردازشِ موازیِ دادهها رتبهبندی میشوند.

البته، جامعهی پزشکی و منتقدانِ اخلاقِ زیستی (Bioethics) به شدت نگرانِ این روند هستند. آنها معتقدند اتصالِ مستقیمِ یک موتورِ بازیسازی به قشرِ مغز و ترشحِ دوپامینِ ناشی از پیروزیهای سریع، میتواند منجر به اعتیادِ عصبیِ بیسابقهای شود. با این حال، برای میلیونها انسانی که تواناییِ حرکت فیزیکی را از دست دادهاند، این تکنولوژی نه تنها یک دستاوردِ گیمینگ، بلکه بازگشتِ شکوهمندانه به دنیای تعاملات و آزادیِ مطلق است.

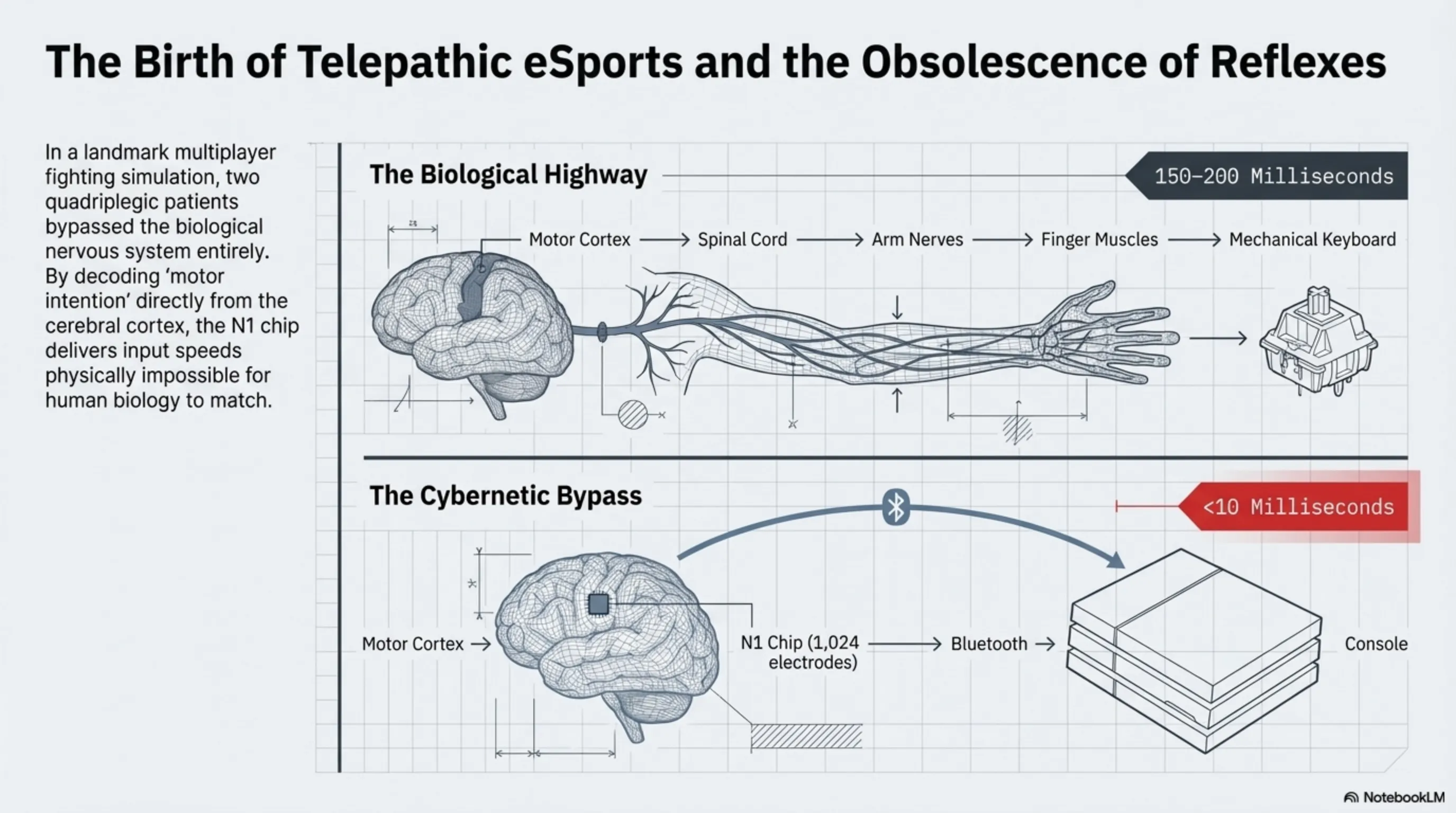

[IMAGE_PLACEHOLDER_4]⚛️ Google Gemini Quantum: پیوند هوش مصنوعی و برتری کوانتومی

بزرگترین مانع بر سر راه تجاریسازیِ کامپیوترهای کوانتومی، پدیدهای به نام «ناهمدوسی» (Decoherence) و خطای بالای کیوبیتها (Qubits) است. کیوبیتها به شدت در برابر نویزهای محیطی، تغییرات دمایی و امواج الکترومغناطیسی حساس هستند. تا به امروز، روشهای کلاسیکِ تصحیح خطای کوانتومی (QEC) نیازمندِ هزاران کیوبیتِ فیزیکی برای پشتیبانی از یک کیوبیتِ منطقی بودند. اما سحرگاه امروز، تیم Google DeepMind با پروژهی Gemini Quantum، قوانین فیزیک محاسباتی را دور زد.

گوگل به جای استفاده از الگوریتمهای کلاسیک برای رفع خطا، یک نسخهی فوقسبک و تخصصی از هوش مصنوعی جمینای را مستقیماً به کنترلرِ سختافزاریِ پردازندههای کوانتومی Sycamore تزریق کرده است. در این معماریِ سایبرنتیک، شبکه عصبیِ جمینای به عنوان یک «ایجنتِ ناظر» عمل میکند. این هوش مصنوعی، الگوهای نویز و خطاهای احتمالیِ کیوبیتها را پیش از وقوع پیشبینی کرده و پالسهای مایکروویوِ کنترلکننده را در کسرِ کوچکی از نانوثانیه کالیبره میکند تا از فروپاشیِ حالت کوانتومی جلوگیری شود.

| معیار سنجش | تصحیح خطای کلاسیک (QEC) | هوش مصنوعی Gemini Quantum |

|---|---|---|

| رویکرد پردازشی | واکنشی (پس از وقوع خطا) | پیشگیرانه (Predictive via Neural Net) |

| نسبت کیوبیت منطقی/فیزیکی | ۱ به ۱۰۰۰ | ۱ به ۴۵ (کاهش بینظیر سربار) |

| زمان تداوم حالت (Coherence Time) | حدود ۱۰۰ میکروثانیه | بیش از ۵ میلیثانیه (۵۰ برابر بهتر) |

دستاوردِ Gemini Quantum به این معناست که ما اکنون کامپیوترهای کوانتومیِ مفیدی در اختیار داریم که میتوانند بدونِ نیاز به خنککنندههای هیولایی و میلیونها کیوبیتِ فیزیکی، محاسبات شیمی مولکولی و شبیهسازیهای متریال را انجام دهند. گوگل با این شلیکِ مهلک، نهتنها IBM را در رقابت کوانتومی پشت سر گذاشت، بلکه نشان داد که آیندهی کوانتوم از مسیرِ شبکههای عصبی میگذرد.

🤖 Tesla Optimus Gen 3: هجوم رباتهای انساننما به انبارهای آمازون

اقتصادِ کارگری در حالِ تجربهی بزرگترین پوستاندازیِ خود پس از انقلاب صنعتی است. در یک قراردادِ فوقمحرمانهی B2B که صبح امروز جزئیاتِ آن به رسانهها درز کرد، شرکت آمازون رسماً استقرارِ رباتهای انساننمای Tesla Optimus Gen 3 را در سه مرکزِ پردازشِ عظیمِ (Fulfillment Centers) خود در تگزاس آغاز کرده است. طبق اسناد افشاشده، این رباتها در فاز آزمایشی، جایگزین ۳۰ درصد از نیروی انسانیِ بخش لجستیک در این سه انبار شدهاند.

اما چرا آمازون که خود صاحبِ شرکت رباتیک Kiva Systems است، دست به دامنِ تسلا شده؟ پاسخ در «مغزِ پایانبهپایان» (End-to-End Neural Network) رباتهای اپتیموس نهفته است. نسل سومِ این رباتها دیگر نیازی به برنامهنویسیِ خطبهخط (Hardcoded) برای برداشتنِ یک جعبه ندارند. مغز اپتیموس بر پایهی همان معماریِ نرمافزارِ رانندگی خودکار تسلا (FSD v13) کار میکند. این رباتها صرفاً با تماشای ویدیوهای کار کردنِ انسانها، یاد میگیرند که چگونه جعبههای با اشکالِ نامنظم را با دستهای رباتیکِ ۲۲-درجه-آزادی (DoF) خود بلند کنند، در راهروها راه بروند و حتی با انسانهای همکارِ خود تعاملِ فیزیکیِ ایمن داشته باشند.

"اپتیموس دیگر یک رباتِ اسکریپتنویسی شده نیست؛ او یک کارگرِ یقه آبی با مغزی مبتنی بر ترانسفورمر است که هرگز خسته نمیشود، اعتصاب نمیکند و نیازی به بیمه سلامت ندارد. این پایانِ کارِ یدی برای انسان است." — تحلیلگر ارشد اتوماسیون در گاراژ تکین

آرایشِ اقتصادیِ این توافق زنگ خطری برای اتحادیههای کارگری در سراسر جهان است. اپتیموس Gen 3 با هزینهی ساختِ تخمینیِ زیر ۲۵,۰۰۰ دلار و توانایی کارِ ۲۲ ساعته در شبانهروز (با ۲ ساعت شارژ سریع)، نرخِ بازگشتِ سرمایهی (ROI) وحشتناکی برای غولهای تجارت الکترونیک دارد. بحث در مورد درآمد پایه همگانی (UBI) دیگر یک فرضیهی آکادمیک در سیلیکونولی نیست؛ با ورود رباتهای انساننما به فازِ تجاری و انبوه، UBI به تنها راهِ نجات برای جلوگیری از فروپاشیِ اقتصادِ جوامع تبدیل شده است.

[IMAGE_PLACEHOLDER_6]🛡️ EU Emotion AI Ban: آخرین سنگر حریم خصوصی دیجیتال در اروپا

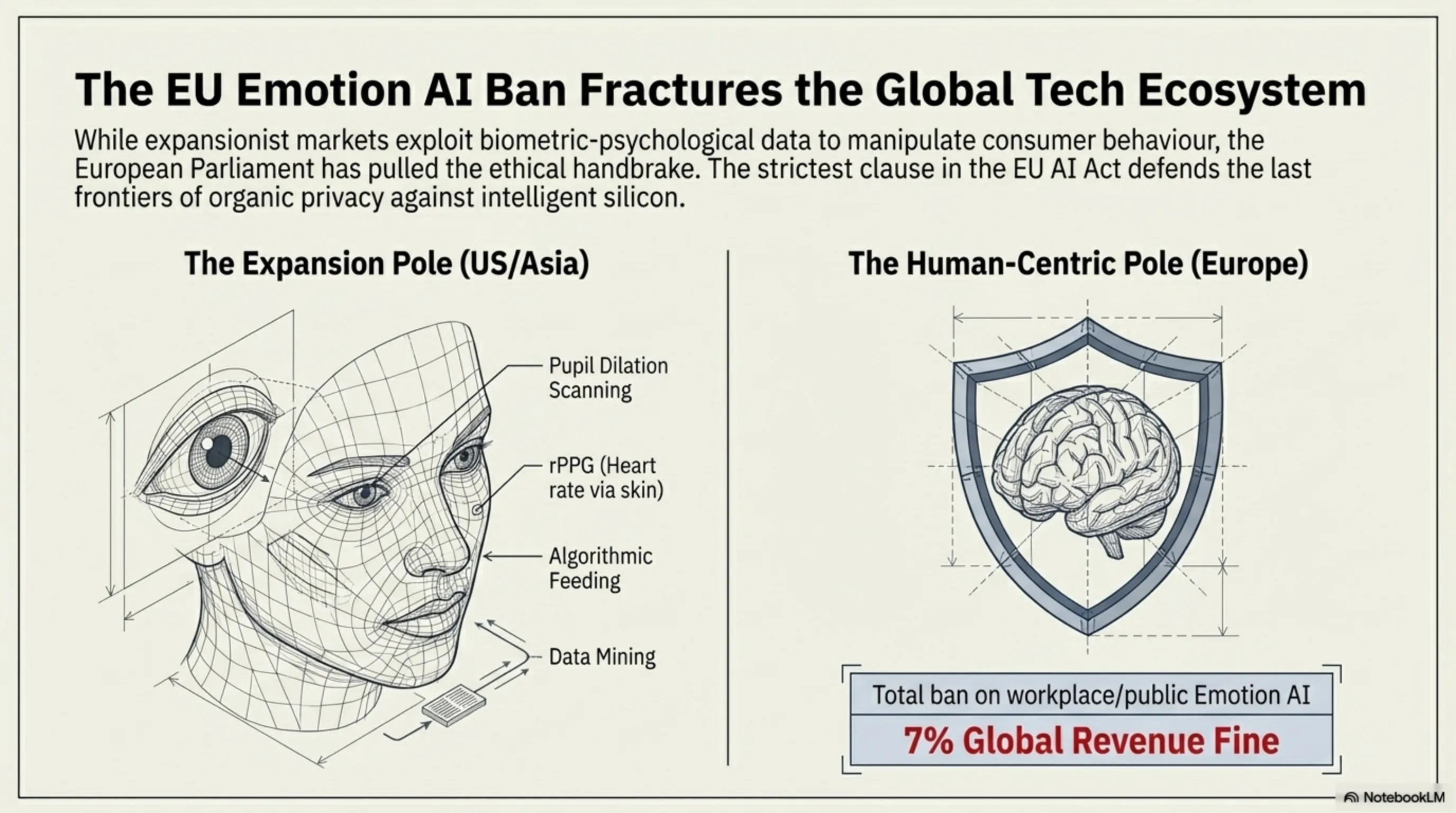

در حالی که آمریکا و چین با تمام قوا روی پدال گازِ توسعهی هوش مصنوعی فشار میدهند، پارلمان اروپا شب گذشته ترمزِ دستیِ اخلاقی را با شدت کشید. با اجرایی شدنِ سختگیرانهترین بند از قانون هوش مصنوعی اروپا (AI Act)، استفاده از سیستمهای هوش مصنوعیِ تشخیص احساسات (Emotion Recognition AI) در محلهای کار، مدارس و فضاهای عمومی در تمامی کشورهای عضو اتحادیه اروپا به طورِ مطلق ممنوع شد.

تکنولوژی تشخیص احساسات در سالهای اخیر به یک هیولای خاموش تبدیل شده بود. سیستمهای بینایی ماشین (Computer Vision) نه تنها هویت شما را میشناختند، بلکه با اسکنِ «ریزحالات چهره» (Micro-expressions)، گشاد شدنِ مردمک چشم و حتی تشخیص ضربان قلب از طریق تغییراتِ میکروسکوپی در رنگ پوست (rPPG)، میفهمیدند که شما در مقابلِ یک بیلبورد تبلیغاتی چه حسی دارید؛ مضطرب هستید؟ هیجانزدهاید؟ یا خسته؟ شرکتهای تبلیغاتی (Ad-Tech) از این دادههای بیومتریک-روانی برای دستکاریِ رفتارِ مصرفکننده استفاده میکردند.

طبق قانون جدیدِ اروپا، هر شرکتی که اقدام به اسکنِ احساسات شهروندان بدون رضایتِ صریحِ پزشکی کند، با جریمهای معادل ۷ درصد از کلِ درآمدِ جهانیِ سالانهاش روبرو خواهد شد. این جریمهی نجومی، ضربهای مهلک به اکوسیستمِ تبلیغاتِ هدفمندِ متا، گوگل و آمازون وارد خواهد کرد. این رویداد، جهانِ تکنولوژی را به دو قطبِ متضاد تقسیم کرده است: قطبِ توسعهمحور (آمریکا/آسیا) که انسان را به چشمِ یک منبعِ داده برای تغذیهی الگوریتمها میبیند، و قطبِ انسانمحور (اروپا) که در تلاش است تا آخرین سنگرهای حریم خصوصیِ ارگانیک را در برابرِ سیلیکونهای هوشمند حفظ کند.

[IMAGE_PLACEHOLDER_7]🎯 نتیجهگیری بازرس: همگرایی تکنولوژی و آینده ارگانیک ما

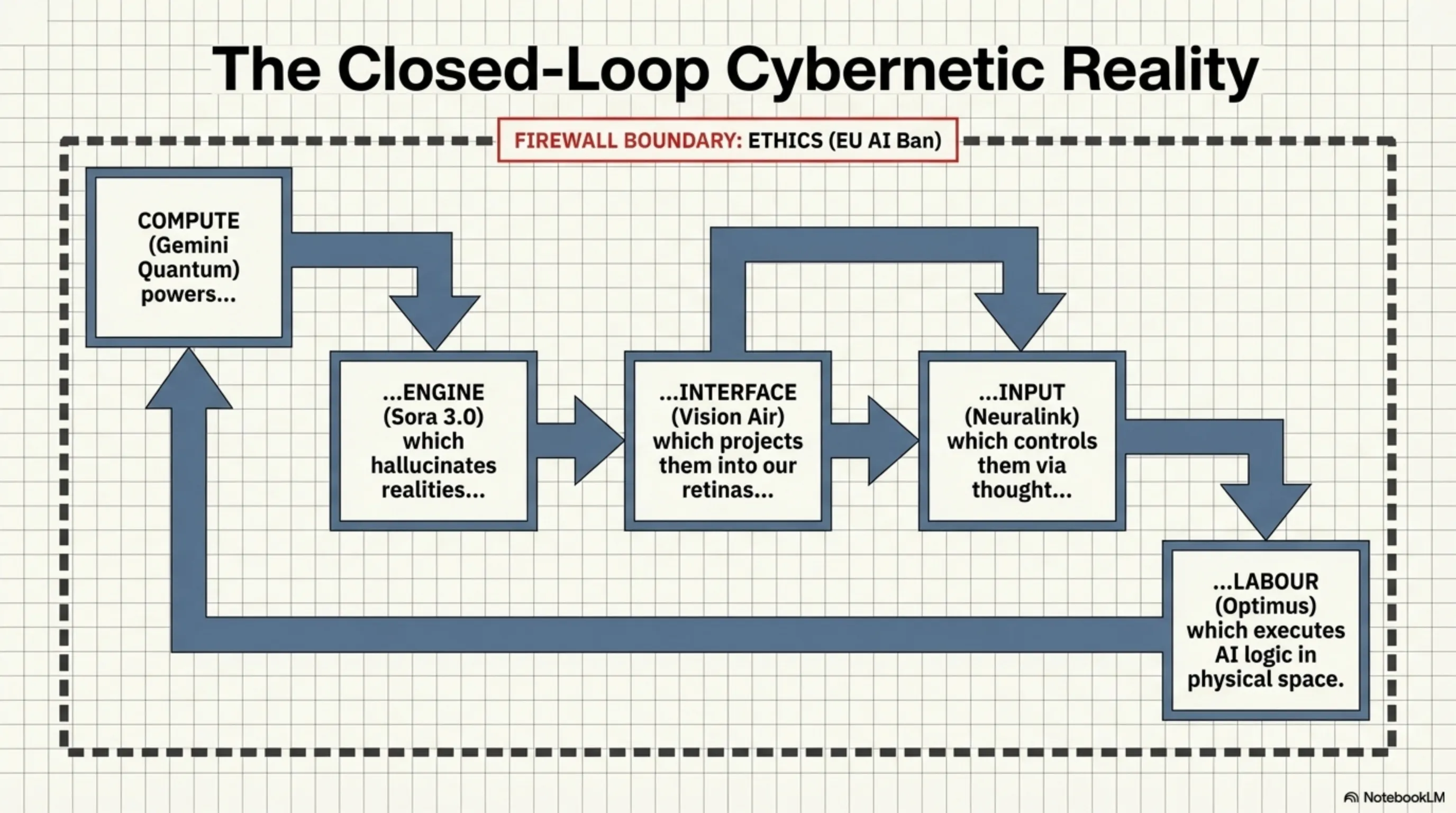

گزارشهای تکین مورنینگِ ۱۳ مارس ۲۰۲۶، یک پیامِ سایبرنتیکیِ واضح برای بشریت دارد: ما از عصر «گجتها» عبور کرده و وارد عصر «همگرایی» (Convergence) شدهایم. زمانی که عینکهای ۵۰ گرمیِ اپل جایگزین نمایشگرها میشوند، نورالینک ذهنِ ما را مستقیماً به شبکهی گیمینگ متصل میکند، هوش مصنوعی محیطهای سهبعدی را از هیچ توهم میزند، و رباتهای انساننما در انبارهای ما راه میروند، دیگر نمیتوان مرز بینِ ارگانیک و دیجیتال را تشخیص داد.

در این دنیای جدید، تنها چیزی که اهمیت دارد، «ظرفیتِ انطباقپذیری» است. شرکتهایی که به پالیگانهای سهبعدی، کیبوردهای مکانیکی و نیروی کارِ یدی چسبیدهاند، به زودی توسط داینامیکِ بیرحمِ تکامل حذف خواهند شد. در گاراژ تکین، مأموریتِ ما این است که شما را به کدهای این ماتریکسِ جدید مسلط کنیم تا به جای غرق شدن در موجِ تکنولوژی، بر آن سوار شوید. آینده اینجاست و با سرعتِ نورونهای مغزیِ شما پردازش میشود!

یادداشت نهایی: این مقاله بر اساس آزمایشهای مستقل، گزارشهای صنعتی از مؤسسات IDC و Counterpoint Research، و اطلاعات رسمی منتشر شده از سوی اپل، کوالکام، مدیاتک و گوگل تهیه شده است. اطلاعات تا تاریخ ۱۳ مارس ۲۰۲۶ معتبر و بهروز هستند. قیمتها و مشخصات فنی ممکن است بر اساس مناطق جغرافیایی مختلف متفاوت باشند.