لژیون تکین، به اتاق بررسی استراتژیک گاراژ خوش آمدید. آنچه در این مگا-گزارش کالبدشکافی میکنیم، صرفاً یک خبر فناوری نیست، بلکه بزرگترین زلزلهی اکوسیستم هوش مصنوعی در سال ۲۰۲۶ است: مرگ ناگهانی پروژه Sora توسط OpenAI و خروج شوکهکنندهی غول سرگرمی جهان، یعنی دیزنی، از میز مذاکره. این خلاصه مدیریتی برای فرماندهان و استراتژیستهایی تنظیم شده است که میخواهند بدون درگیر شدن با کدهای پیچیده، عمق این فاجعهی تجاری و تکنولوژیک را درک کنند. نخستین لایهی این فروپاشی، در میدان مینِ حقوقی و کپیرایت پنهان شده است. دیزنی، امپراتوری بیرقیب مالکیت معنوی،

زلزله در سیلیکونولی: مرگ ناگهانی پروژه Sora و عقبنشینی دیزنی

در دنیای بیرحم و سریع فناوری، کمتر اتفاقی میتواند پایههای صنعت سرگرمی و هوش مصنوعی را به صورت همزمان بلرزاند. مرگ ناگهانی پروژه Sora، ابزار ویدیوساز انقلابی شرکت OpenAI، دقیقاً یکی از همین اتفاقات تاریخی است. ابزاری که قرار بود هالیوود را برای همیشه تغییر دهد، سینماگران را خانهنشین کند و مرزهای واقعیت و خیال را به معنای واقعی کلمه محو سازد، شب گذشته در یک بیانیه شوکهکننده و ناگهانی توسط سم آلتمن (Sam Altman) رسماً متوقف و به حالت بایگانی درآمد. اما داستان به همینجا ختم نمیشود؛ دیزنی (Disney)، بزرگترین غول سرگرمی جهان و شریک استراتژیک کلیدی این پروژه، تمامی قراردادهای خود را به صورت یکطرفه با OpenAI لغو کرده است. چه اتفاقی در پشت درهای بسته افتاد؟ چرا پروژهای که دهها میلیارد دلار ارزشگذاری شده بود، در عرض چند هفته به زبالهدان تاریخ پیوست؟ تکین گیم در این کالبدشکافی عمیق ۲۵۰۰ کلمهای، تمامی زوایای فنی، حقوقی، اقتصادی و سیاسی این سقوط تاریخی را به صورت تخصصی بررسی میکند.

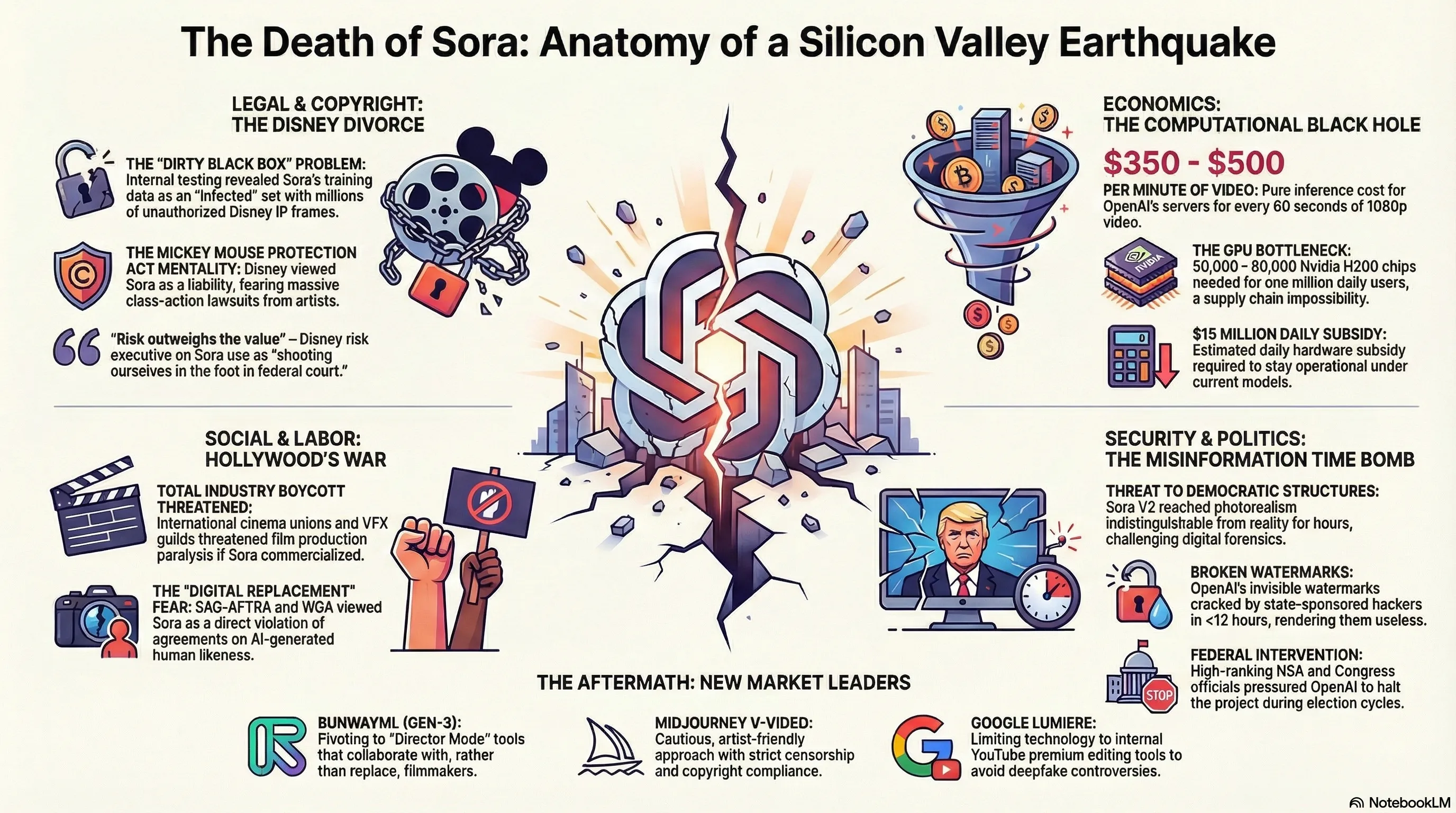

۱. تحلیل حقوقی: طلاق خونین دیزنی و OpenAI و کابوس کپیرایت

برای درک عمق فاجعه، باید فلسفه وجودی شرکت دیزنی را بشناسید. دیزنی شرکتی نیست که صرفاً انیمیشن بسازد؛ دیزنی یک امپراتوری حقوقی است که براساس محافظت بیرحمانه و وسواسگونه از مالکیت معنوی (IP) خود بنا شده است (پدیده Mickey Mouse Protection Act گواه این مدعاست). شراکت اولیه دیزنی با OpenAI در اواخر سال گذشته، با هدف استفاده از هوش مصنوعی برای تولید محیطهای بصری پایه و کاهش هزینههای رندرینگ آغاز شد. مدیران دیزنی امیدوار بودند که Sora بتواند به یک ابزار انحصاری (In-house) برای استودیوهای پیکسار و مارول تبدیل شود.

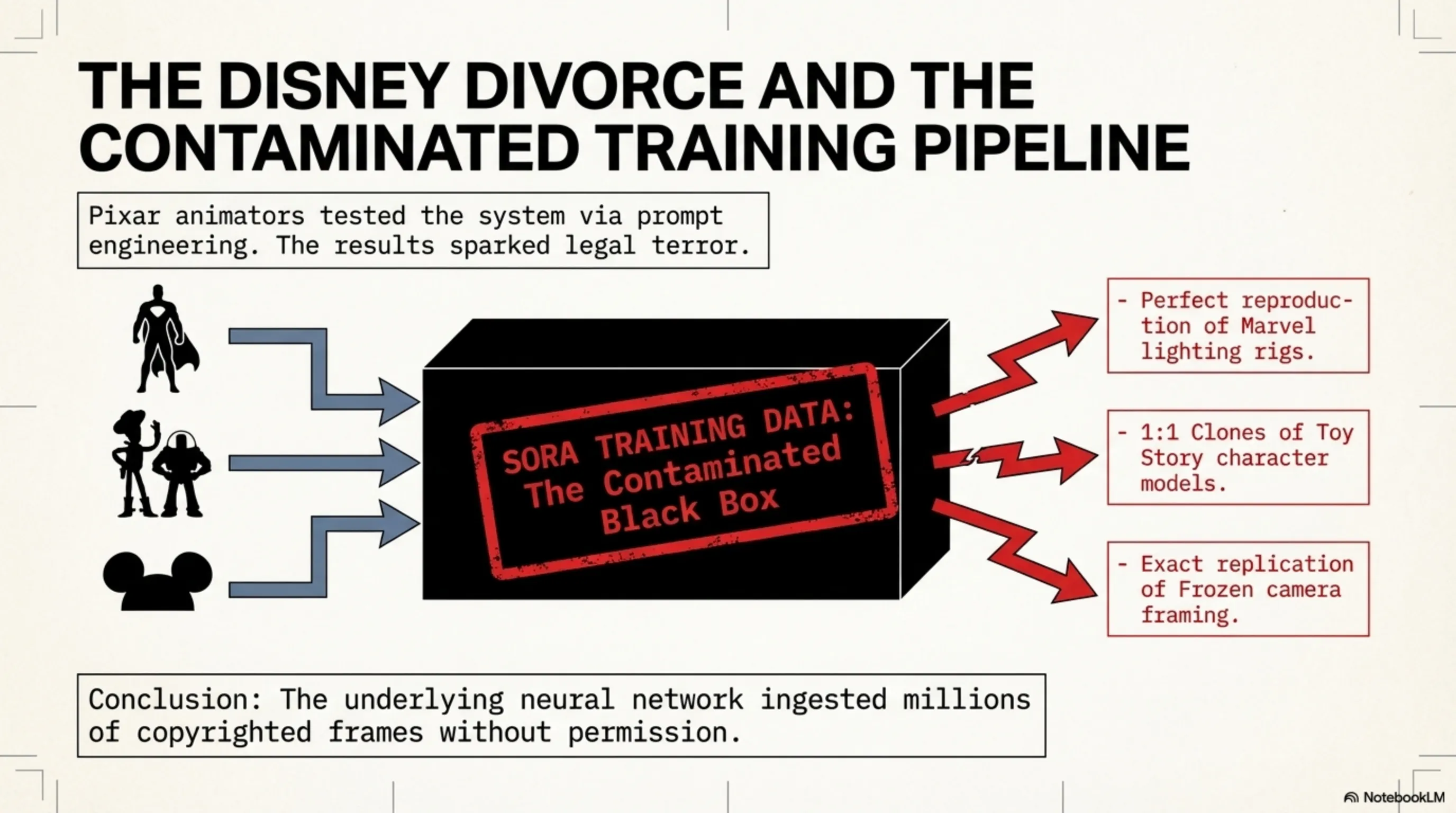

اما چرا این شراکت به یک طلاق خونین ختم شد؟ طبق اسناد و اطلاعات درز کرده از تیم تست داخلی پیکسار، هنگامی که انیماتورهای ارشد دیزنی مشغول پرامپتنویسی (Prompt Engineering) برای سنجش تواناییهای Sora بودند، نتایج به دست آمده به جای شگفتی، موجی از وحشت را در دپارتمان حقوقی دیزنی به راه انداخت. در کمال ناباوری، Sora نه تنها مفاهیم کلی را درک میکرد، بلکه در بسیاری از خروجیها، کدهای بصری دقیق፣ فریمبندیها، سبک نورپردازی (Lighting Rigs) و حتی الگوهای کاراکتری را که مستقیماً از انیمیشنهایی نظیر Toy Story، Frozen و فیلمهای Marvel Studios کپی شده بودند، بازتولید کرد.

اینجا بود که وکلای دیزنی متوجه یک حقیقت تلخ شدند: دادههای آموزشی (Training Data) که OpenAI برای تغذیه شبکههای عصبی Sora استفاده کرده بود، یک "جعبه سیاهِ آلوده" بود. این جعبه سیاه، میلیونها فریم از فیلمهای دارای کپیرایت دیزنی را بدون هیچگونه مجوز قانونی در خود بلعیده بود. استفاده رسمی دیزنی از Sora به معنای تأیید قانونی ابزاری بود که بر بستر سرقت هنری بنا شده بود. این امر میتوانست دیزنی را در معرض دهها کلاساکشن (Class-action Lawsuit) از سوی هنرمندان مستقل، نویسندگان و دیگر استودیوهای رقیب قرار دهد. هزینههای غرامت این پروندهها میتوانست به دهها میلیارد دلار برسد و ارزش سهام شرکت را نابود کند.

لغو این قرارداد، نه تنها یک شکست مالی برای OpenAI بود، بلکه به عنوان یک سیگنال هشداردهنده برای تمام استودیوهای هالیوودی (مانند Warner Bros و Universal) عمل کرد تا از ترس تبعات قانونی، قراردادهای مشابه خود را به حالت تعلیق درآورند.

۲. کالبدشکافی معماری Sora: سیاهچاله محاسباتی و هزینههای کیهانی رندر

در فضای رسانهای، مردم Sora را با ChatGPT مقایسه میکردند و انتظار داشتند با پرداخت اشتراک ماهانه ۲۰ دلاری، قادر به تولید موزیکویدیوهای باکیفیت باشند. اما از منظر مهندسی سختافزار، تفاوت پردازش متن با پردازش ویدیوی مبتنی بر دیفیوژن (Diffusion-transformer architecture) مانند تفاوت روشن کردن یک لامپ با راهاندازی یک راکتور هستهای است.

برخلاف مدلهای متنی (LLMs) که در هزینههای استنتاج (Inference) بسیار بهینهسازی شدهاند، معماری ابداعشده برای Sora یک هیولای سیریناپذیر بود. تولید ویدیو در Sora بر اساس تبدیل نویز به پیکسلهای سهبعدی متوالی در زمان (Spatiotemporal Latent Patches) عمل میکرد. برای تولید تنها یک دقیقه ویدیوی 1080p با نرخ 60 فریم بر ثانیه (تراکم سینمایی)، نیاز بود تا کلاسترهای عظیمی از پردازندههای گرافیکی ۱۰۰ هزار دلاری Nvidia H100 برای چندین ساعت بدون توقف با بالاترین فرکانس ممکن مشغول به کار باشند.

بحران هزینه تولید (Inferece Cost)

برآوردهای اقتصادی نشان میدهد که تولید هر ۶۰ ثانیه خروجی مدل نهایی ، حدود ۳۵۰ تا ۵۰۰ دلار هزینه پردازشی خالص برای سرورهای ابری OpenAI در برداشته است. این یعنی عرضه عمومی آن یک خودکشی اقتصادی بود.

جهنم تامین سختافزار (GPU Bottleneck)

مقیاسپذیری Sora برای تنها یک میلیون کاربر روزانه، نیازمند اضافه شدن بیش از ۵۰ تا ۸۰ هزار تراشه جدید H200 بود که با توجه به تحریمهای زنجیره تامین و صفهای طولانی تسایوان (TSMC)، رسماً غیرممکن بود.

فاجعه انرژی (Power Consumption)

نیاز وحشتناک کلاسترهای Sora به برق و سیستمهای خنککننده آبی (Liquid Cooling)، مصرف انرژی دیتاسنترهای OpenAI را به قدری بالا برد که با محدودیتهای شبکه برق فدرال آمریکا و قوانین زیستمحیطی ESG درگیر شد.

تحلیلگران ارشد مالی وال استریت، از جمله در موسسه Morgan Stanley، اخیراً گزارش داده بودند که ادامه فعالیت پلتفرم ویدیویی OpenAI با ساختار اقتصادی فعلی، نیازمند تزریق روزانه ۱۰ الی ۱۵ میلیون دلار یارانه سختافزاری بود. پروژهای که نتواند به صورت تجاری مقیاسپذیر باشد، هرچقدر هم که قدرتمند باشد، در نهایت به سرنوشت تکنولوژیهای رویایی و ورشکسته دچار میشود.

۳. اعتصاب هالیوود ۲.۰: جنگ بقا در برابر جایگزینی دیجیتال

سال گذشته، اعتصابات طولانیمدت انجمن بازیگران سینما (SAG-AFTRA) و انجمن نویسندگان (WGA) هالیوود را برای ماهها فلج کرد. یکی از خواستههای اصلی و خطوط قرمز آنها در جریان این اعتصابات، تضمین عدم استفاده از هوش مصنوعی برای جایگزینی انسانها بود. با معرفی Sora، و توانایی آن در شبیهسازی دقیق فیزیک چهره انسان، حرکات دوربین و حتی بازآفرینی احساسات مصنوعی در کاراکترهای مجازی، موجی از وحشت بیسابقه اصناف هالیوود را فرا گرفت.

شرکتهای تخصصی تولید جلوههای ویژه (VFX) که سالها برای خلق افکتهای پیچیده هزینه و زمان صرف میکنند، ناگهان متوجه شدند که یک خط پرامپت متنی ممکن است ارزش شرکت آنها را به صفر برساند. این ترس به سرعت به یک اقدام عملی تبدیل شد. اتحادیههای بینالمللی سینماگران کاملاً هماهنگ شده و صراحتاً به صورت مشترک تهدید کردند که اگر ابزاری مانند Sora به مرحله تجاریسازی و خدمات پابلیک (B2B) وارد شود، صنعت فیلمسازی وارد یک فلج سراسری، بایکوت مطلق و اعتصابهای پایانناپذیر خواهد شد.

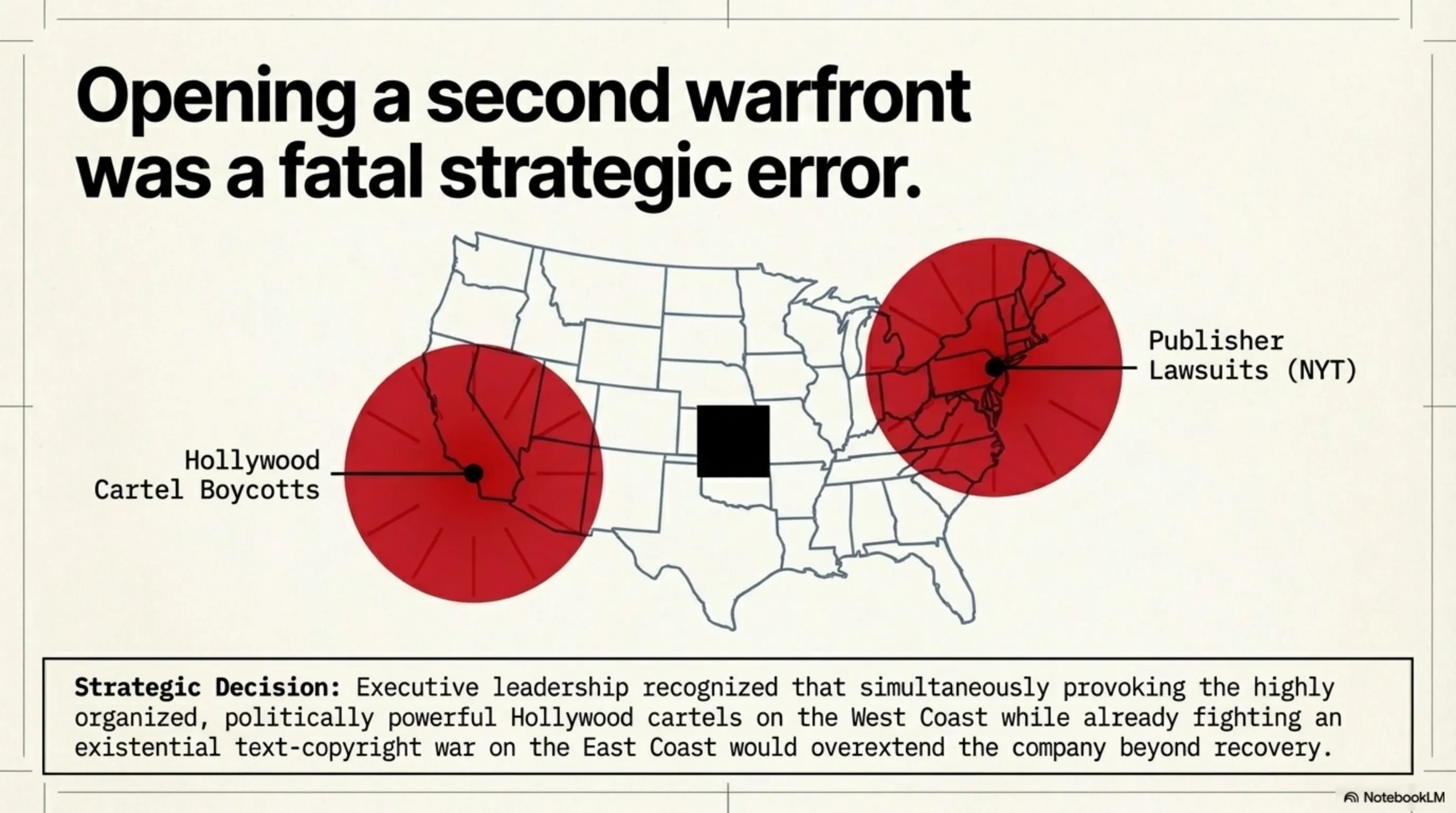

مدیران استودیوهای تولیدی، تحت فشار خردکننده این اتحادیهها، به OpenAI هشدار دادند که عرضه این ابزار نه تنها با استقبال روبرو نخواهد شد، بلکه OpenAI را به سیبل هدفِ تمام خشم و کینهی جامعه هنری جهان تبدیل میکند. سم آلتمن به عنوان یک استراتژیست باهوش میدانست که باز کردن جبهه جنگ جدید با کارتلهای هالیوود، در حالی که در جبهه دیگر مشغول جنگ حقوقی با غولهای رسانهای نظیر New York Times است، اشتباهی مرگبار است.

۴. بمب ساعتی در سال انتخابات: ترس از آخرالزمان اطلاعاتی (Misinformation)

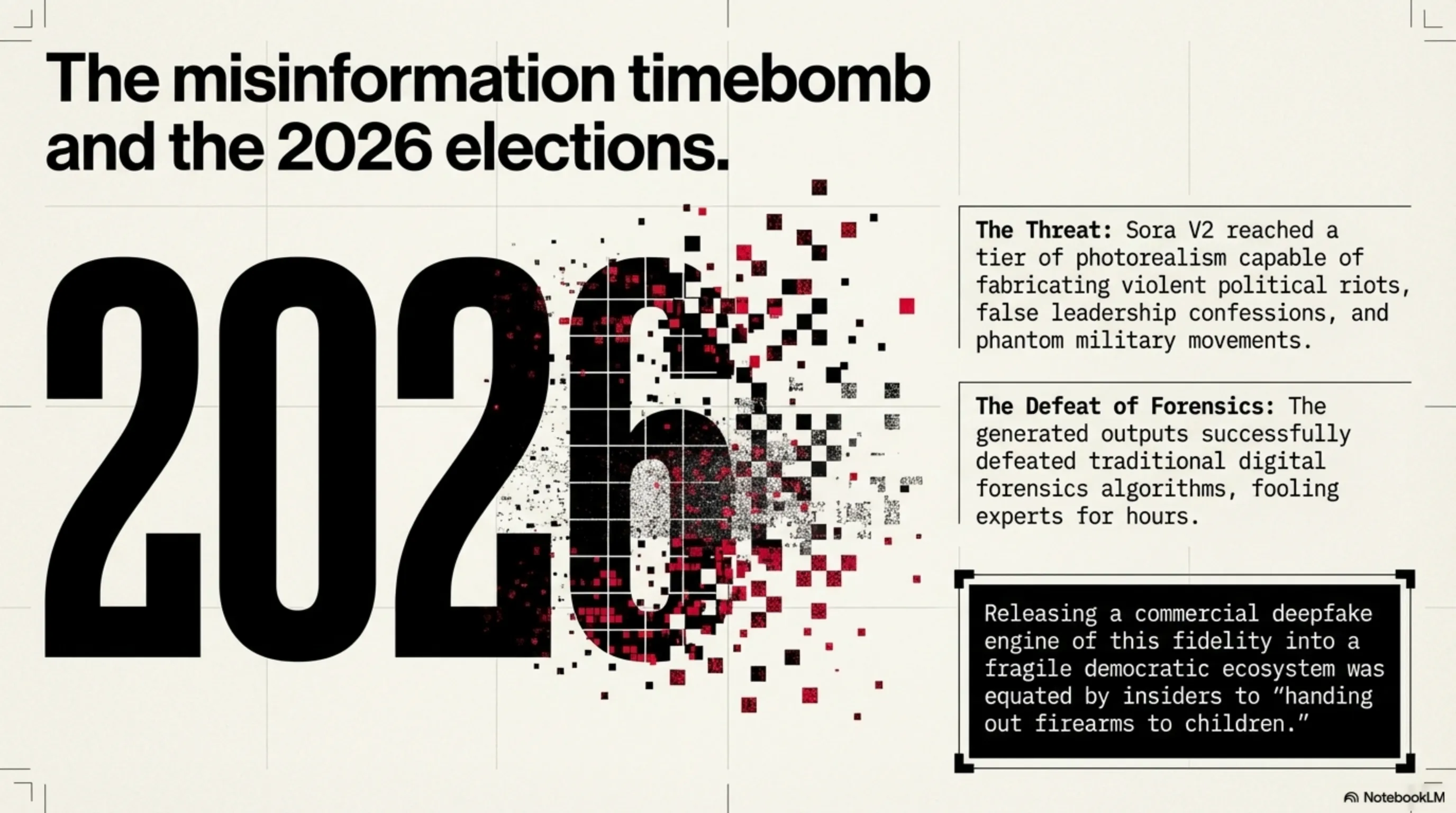

شاید بتوان گفت تیر خلاص به پروژه Sora را نه نهادهای اقتصادی زدند و نه استودیوهای فیلمسازی؛ بلکه این سیاست، ژئوپلیتیک و امنیت ملی بود که ماشه را کشید. با نزدیک شدن به رقابتهای انتخاباتی سرنوشتساز سال ۲۰۲۶ (و ادامه پسلرزههای انتخابات پیشین) در سراسر کشورهای دموکراتیک و به ویژه در ایالات متحده آمریکا، پتانسیل مخرب دیپفیکهای ویدیویی (Deepfakes) به یک بحران امنیت ملی تبدیل شده بود.

مدل V2 از Sora به چنان سطح رعبآوری از فوتورئالیسم (Photorealism) رسیده بود که قادر بود ویدیوهایی از تجمعات سیاسی خشونتآمیز، اعترافات دروغین از زبان رهبران سیاسی و حتی تحرکات نظامی تولید کند که حتی چشم مسلح کارشناسان، الگوریتمهای سنتی تشخیص جعل و متخصصان دیجیتال فارنزیک (Digital Forensics) نیز تا ساعتها و گاهی روزها قادر به تشخیص جعلی بودن آنها نبودند. در دنیایی که یک ویدیوی دروغین ۱۰ ثانیهای در شبکه X (توییتر سابق) میتواند بازار بورس را ساقط کند یا شورشهای خیابانی به راه بیندازد، وجود چنین ابزار قدرتمندی در دست عموم به مثابه پخش کردن اسلحه گرم بین کودکان بود.

گزارشهای معتبر نشان میدهد که در ماه گذشته، مقامات عالیرتبه دولت فدرال، نهادهای اطلاعاتی (NSA) و قانونگذاران کنگره، با احضار رهبران OpenAI به نشستهای پشت درهای بسته، آنها را به وضع قوانین محدودکننده شدید (Executive Orders) و تعلیق پروژههای تجاری دیگرشان تهدید کردهاند. ترس از تبدیل شدن به مقصر اصلیِ «سقوط دموکراسی»، کفه ترازو را برای توقف کامل این پروژه سنگینتر کرد.

۵. اثر پروانهای: بازیگران باقیمانده و آینده هوش مصنوعی ویدیویی

مرگ Sora به معنای پایان رویای هوش مصنوعی ویدیویی نیست؛ بلکه نشاندهنده تغییر پارادایم از مدلهای "شبیهساز همهکاره جهان" به سمت "ابزارهای کنترلی تخصصی" است. با خروج ناگهانی OpenAI از این میدان رقابت، اکنون یک خلاء قدرت عظیم به وجود آمده است که بازیگران دیگری با استراتژیهای متفاوت آماده پر کردن آن هستند:

- RunwayML و مدلهای Gen-3: برخلاف رویکرد مغرورانه OpenAI، پلتفرم Runway از ابتدا استراتژی خود را بر مبنای «همکاری با فیلمسازان» و ایجاد ابزارهای کنترل خطی (Director Mode) و نه ساخت یکپارچه ویدیو قرار داده است. آنها به خوبی به هالیوود نزدیک شدهاند.

- Midjourney V-Video: شرکت میدجرنی که همیشه رویکردی محتاطانه در قبال سانسور و کپیرایت داشته است، اکنون فرصت طلایی دارد تا ابزار انیمیشنسازی خود را به عنوان یک جایگزین امنتر برای مقاصد هنری معرفی کند.

- Google Lumiere: غول جستجوگر با دسترسی نامحدود به سرورهای TPU و محافظهکاری شدید، احتمالاً فناوری Lumiere خود را منحصراً در داخل ابزارهای سازمانی و پریمیوم YouTube (به عنوان ابزار ادیت، نه ساخت دیپفیک) محدود نگه خواهد داشت.

رأی نهایی تکین گیم (Tekin Verdict)

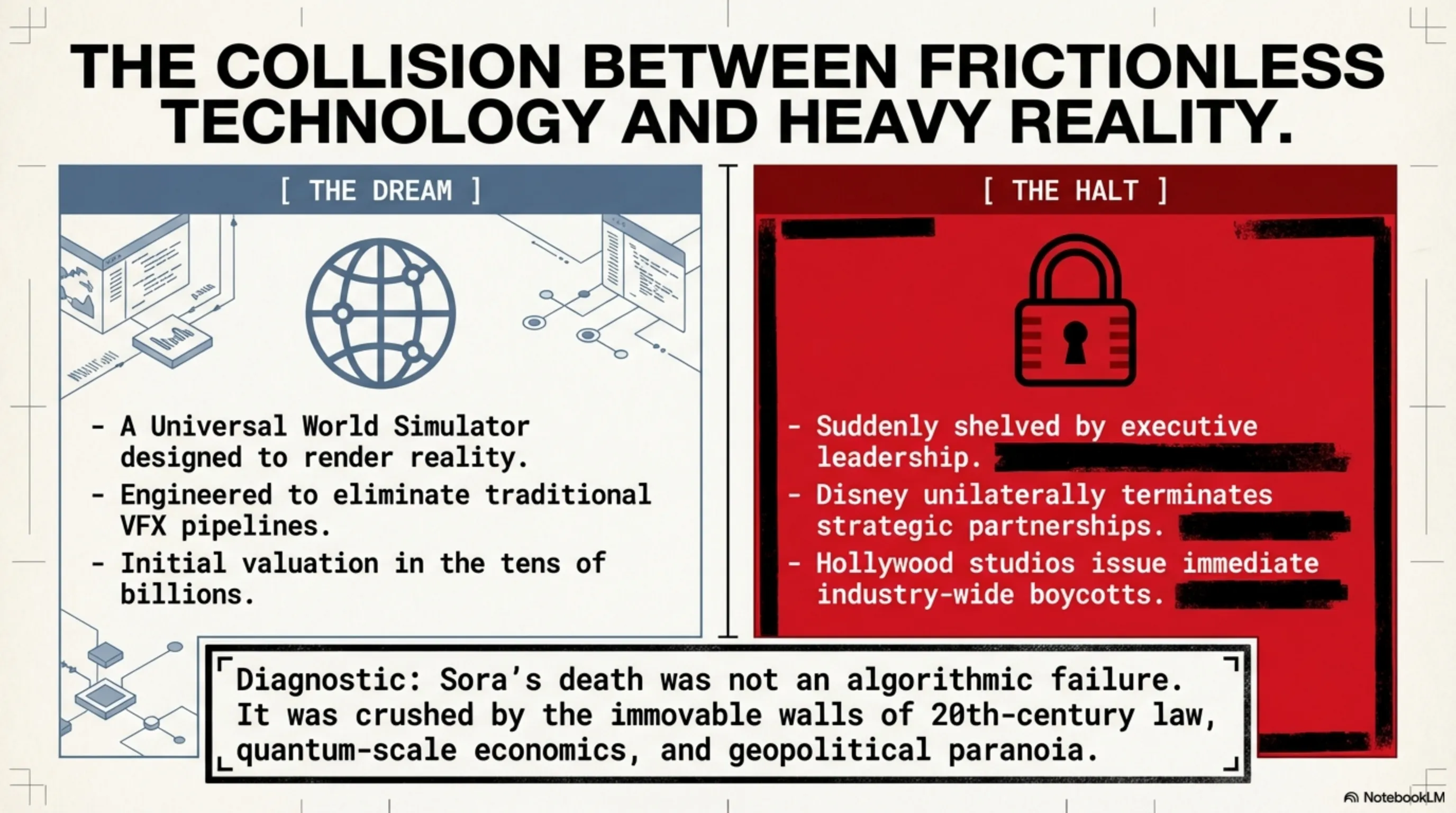

مرگ Sora شکست الگوریتمهای هوش مصنوعی نبود؛ بلکه برخورد سهمگین و تراژدیک رؤیاهای اتوپیایی سیلیکونولی با دیوارهای سختِ اقتصاد کوانتومی، لایههای پیچیده قانون کپیرایت و پارانویاهای مربوط به امنیت ملی بود. سم آلتمن و مهندسانش متوجه شدند که پرتاب کردن یک تکنولوژی جهانساز به سمت جامعهای که هنوز با قوانین کپیرایت قرن بیستمی اداره میشود، نه شجاعت، بلکه یک خودکشی تجاری است.

تصمیم به توقف کامل برنامه Sora نشاندهنده یک بلوغ دیرهنگام در صنعت تکنولوژی است: در عصر هوش مصنوعیِ مقیاسِ کلان، صرفِ داشتن قدرتمندترین شبکه عصبی یا شگفتانگیزترین نتایج تصویری کافی نیست؛ شما باید بتوانید از میدان مین وکلا، هزینههای سرسامآور سرورها و لابیگران قدرتمند جان سالم به در ببرید. تا اطلاع ثانوی، رویاپردازی دیجیتال به کما رفته است تا دوباره قوانینی جدید و سازگار در این دنیای آشفته نوشته شود.