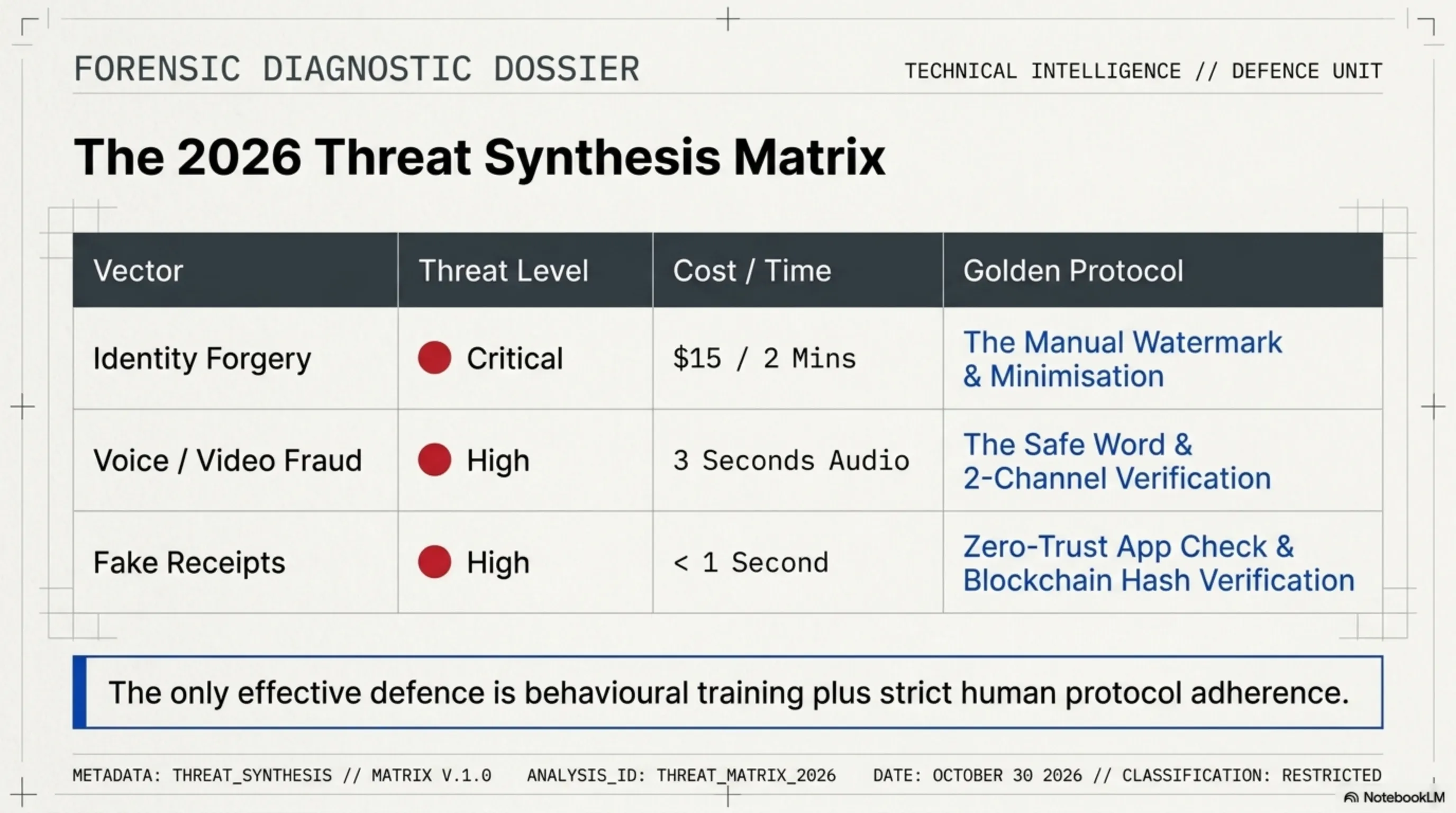

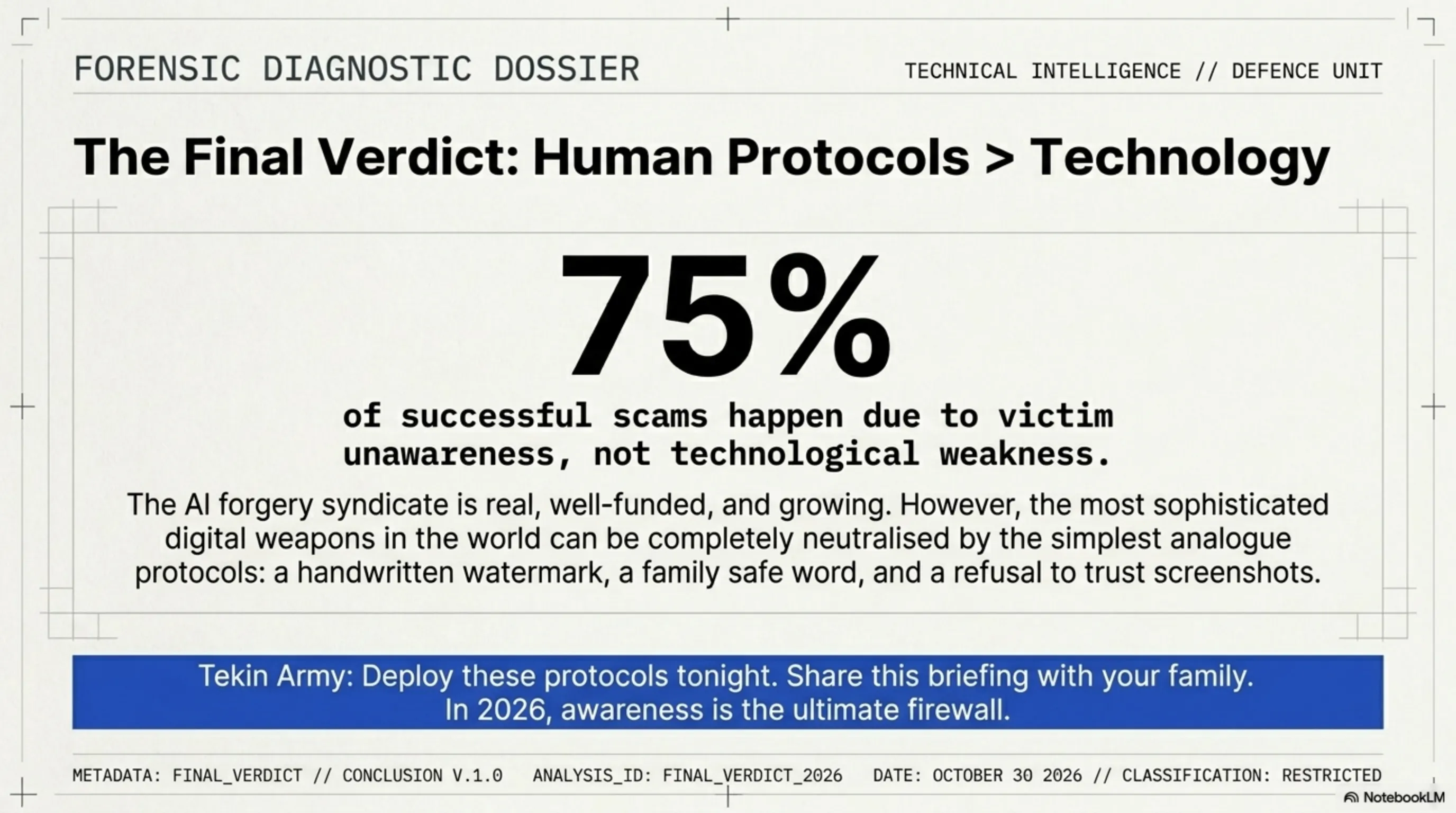

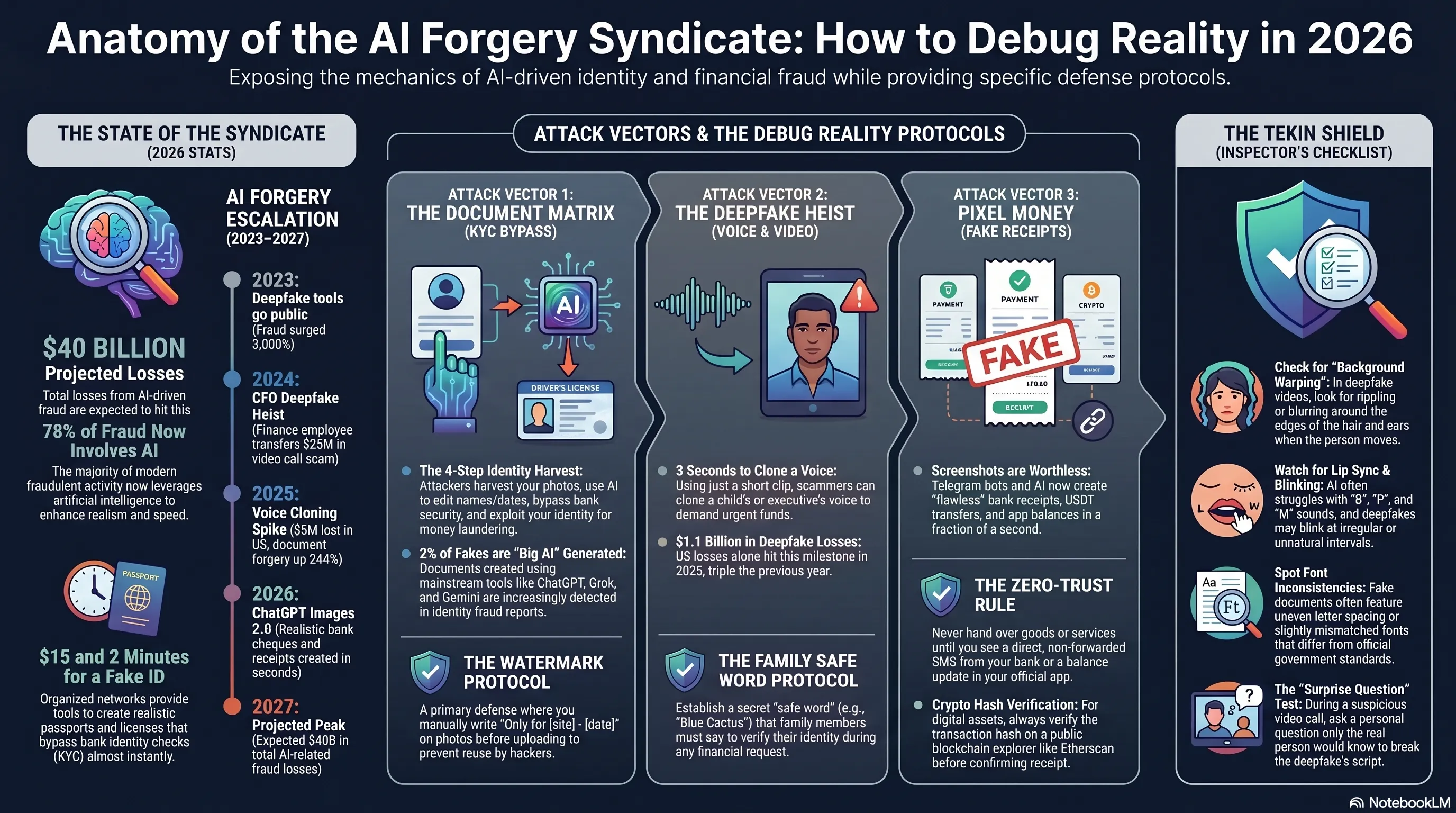

در این گزارش فوقتخصصی ۶۵۰۰ کلمهای، به کالبدشکافی سندیکای کلاهبرداری با هوش مصنوعی در سال ۲۰۲۶ میپردازیم. این مقاله به تحلیل ماتریکس جعل اسناد (KYC Bypass)، سرقتهای صوتی دیپفیک و ایجاد رسیدهای بانکی جعلی پرداخته و در نهایت «چکلیست بازرس تکین» شامل ۱۵ نشانه قطعی برای دیباگ کردن واقعیت و تشخیص جعل را ارائه میدهد.

🕵️ کالبدشکافی سندیکای جعل AI — چگونه واقعیت را دیباگ کنیم؟

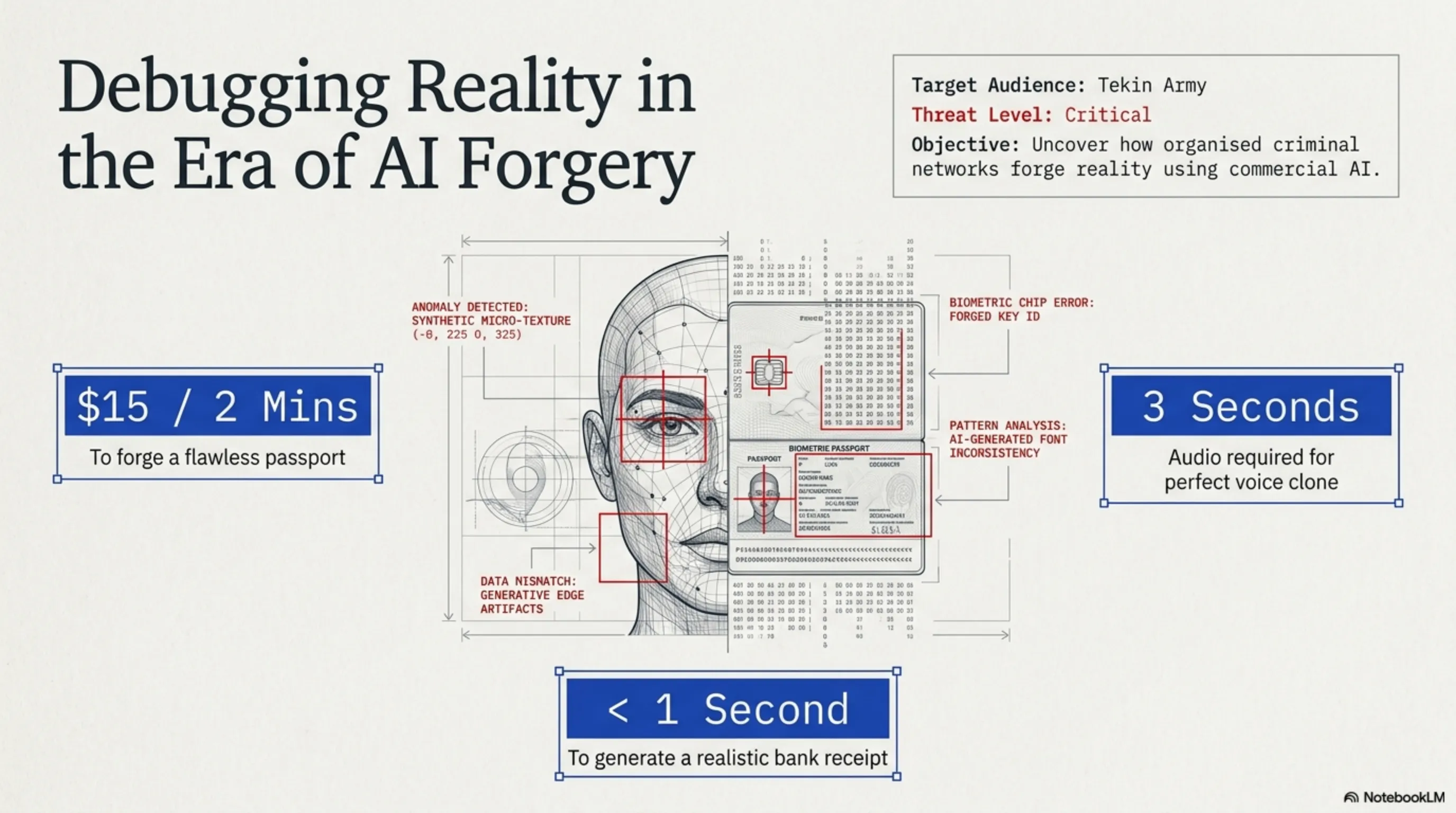

ارتش تکین، این مقاله رو با دقت بخوانید. در ۲۰۲۶، یه شبکه جنایی سازمانیافته با ابزارهای AI تجاری — همونهایی که همه بهشون دسترسی دارن — واقعیت رو جعل میکنه. پاسپورت جعلی در ۲ دقیقه با ۱۵ دلار. صدای شما با ۳ ثانیه نمونه. رسید بانکی کاملاً واقعی در کسری از ثانیه. این مقاله کالبدشکافی میکنه که دشمن چطور کار میکنه — و چطور میتونید خودتون رو محافظت کنید.

🔍 فهرست کالبدشکافی:

📄 بخش ۱: ماتریکس اسناد جعلی — KYC Bypass و هویتدزدی

🎭 بخش ۲: سرقتهای دیپفیک — کلاهبرداری صوتی و ویدیویی

💸 بخش ۳: رسیدهای بانکی جعلی — پولهای پیکسلی

🛡️ بخش ۴: چکلیست بازرس تکین — The Tekin Shield

⚡ راهکارهای عملی برای هر بخش

⚠️ این مقاله آموزشی است — اطلاعات برای دفاع، نه حمله

📊 آمار هشداردهنده — سندیکای جعل AI در ۲۰۲۶

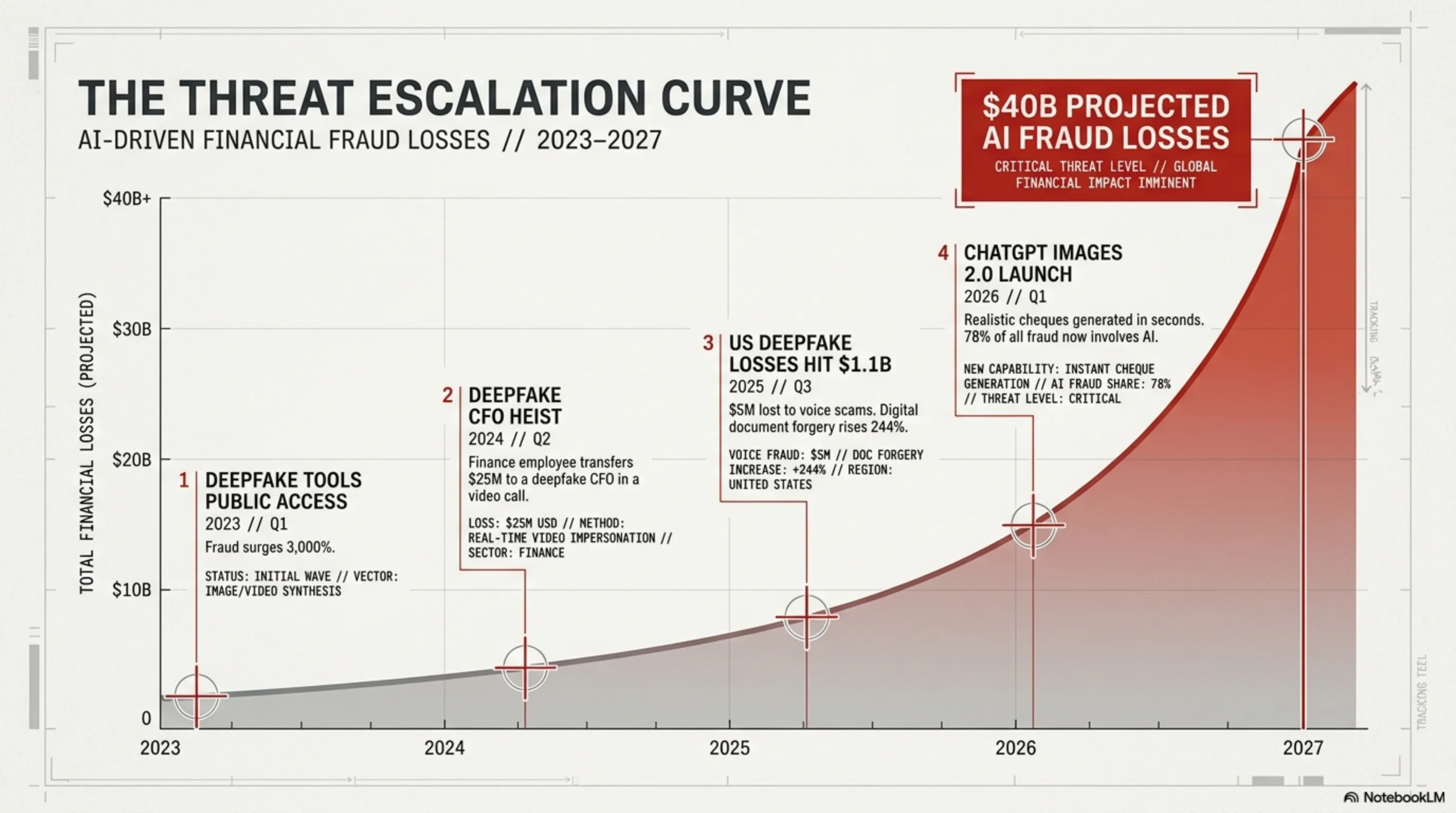

⏳ تایملاین تکامل جعل AI

| سال | رویداد | تأثیر |

|---|---|---|

| ۲۰۲۳ | ابزارهای deepfake عمومی شدند | کلاهبرداری ۳۰۰۰٪ رشد کرد |

| ۲۰۲۴ | کارمند مالی ۲۵ میلیون دلار انتقال داد | deepfake CFO در تماس ویدیویی |

| ۲۰۲۵ | $5M خسارت voice cloning فقط آمریکا | جعل اسناد ۲۴۴٪ رشد کرد |

| ۲۰۲۶ | ChatGPT Images 2.0 — چک بانکی واقعی | «تمام شدیم» — واکنش کارشناسان |

| ۲۰۲۷ | پیشبینی: $40B خسارت AI fraud | اگه الان اقدام نکنیم |

📄 بخش اول: ماتریکس اسناد جعلی — The KYC Bypass

🔴 کالبدشکافی حمله

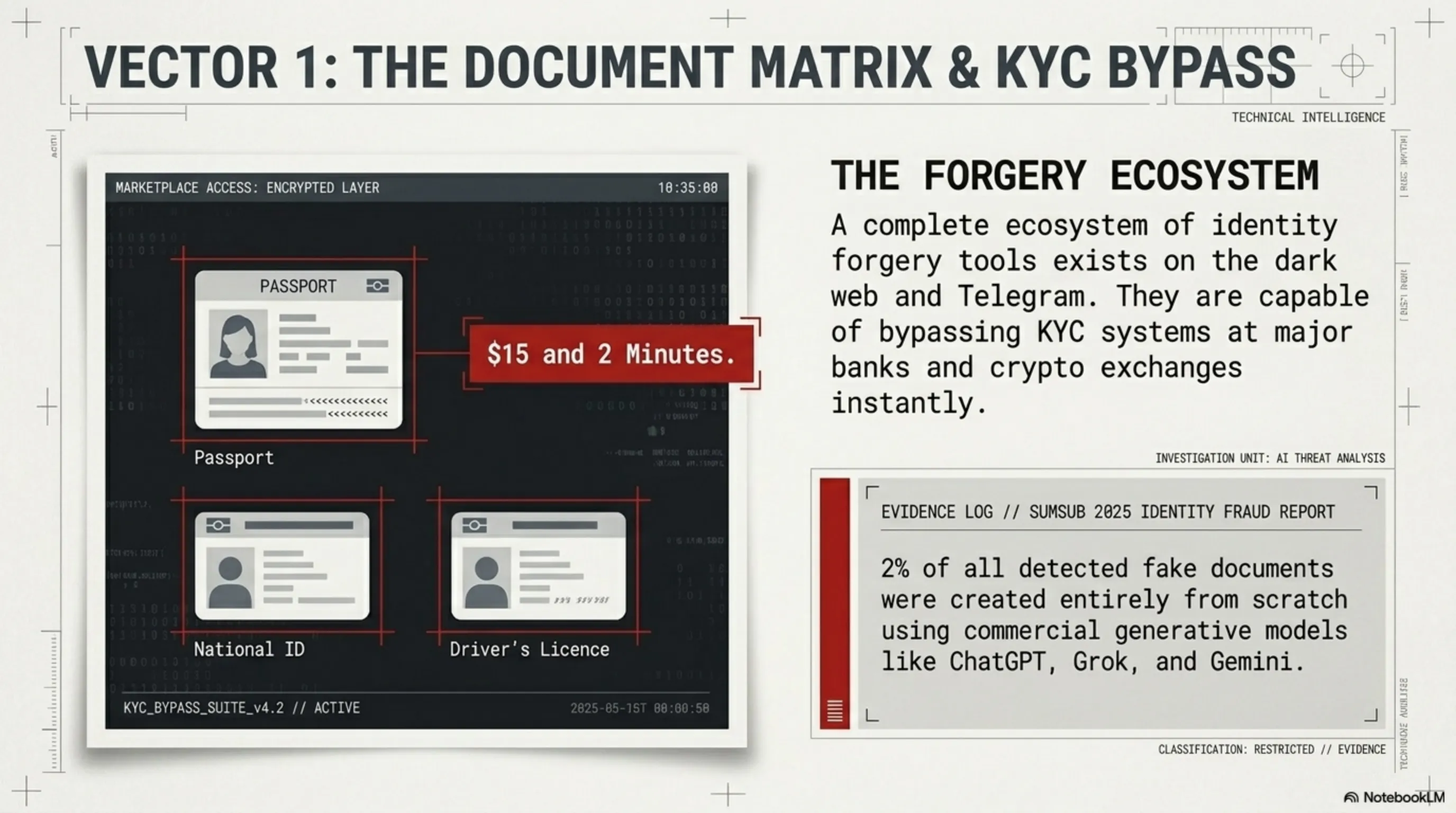

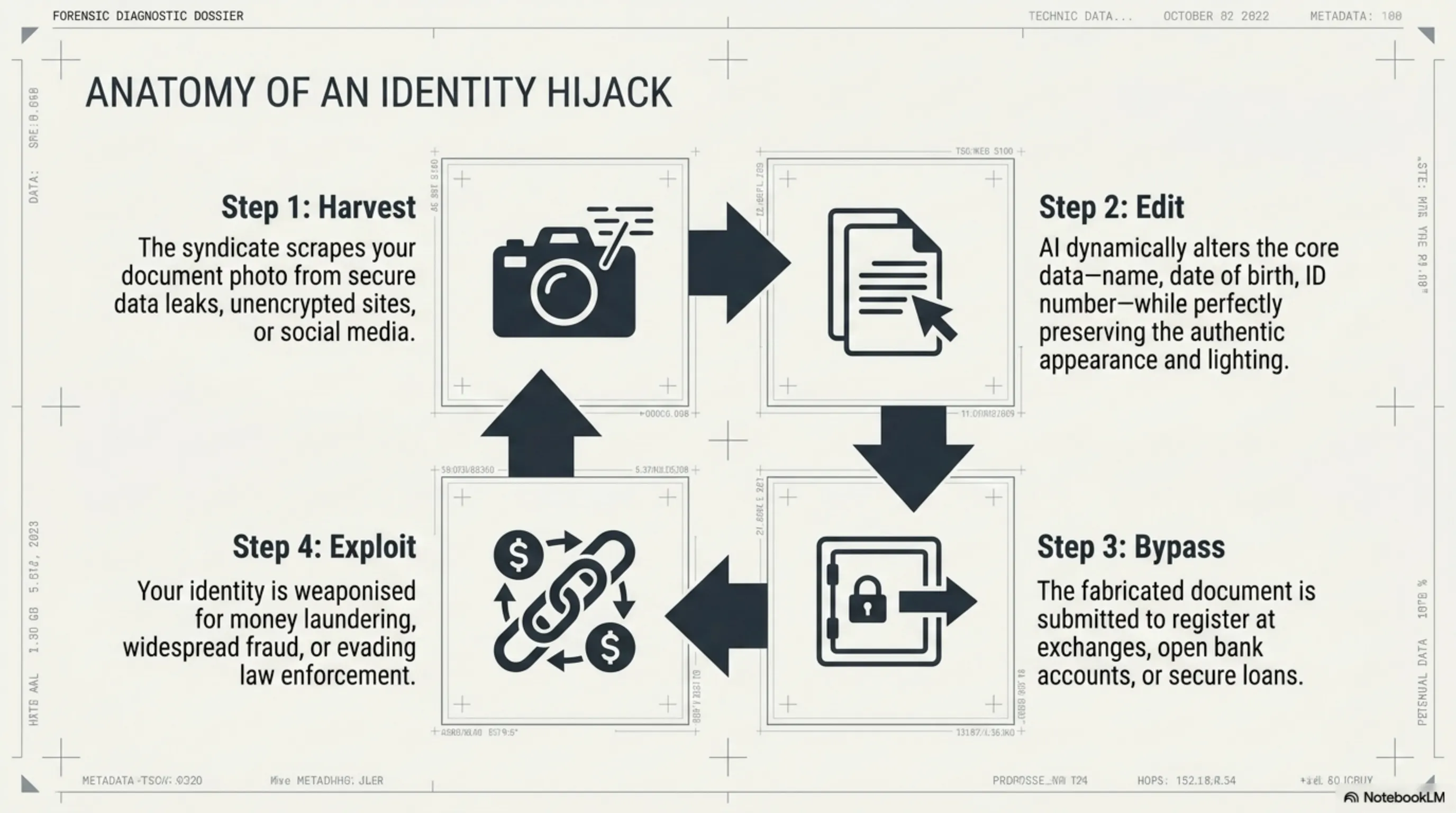

در دارک وب و حتی تلگرام، یه اکوسیستم کامل از ابزارهای جعل هویت وجود داره. با ۱۵ دلار و ۲ دقیقه، یه هکر میتونه پاسپورت، گواهینامه، کارت ملی یا مدرک مالکیت کاملاً بینقص بسازه که سیستمهای KYC صرافیها و بانکها رو دور بزنه. این دیگه علم تخیلی نیست — گزارش Sumsub 2025 تأیید میکنه که ۲٪ از تمام اسناد جعلی شناساییشده با ChatGPT، Grok و Gemini ساخته شدن.

⚠️ چطور این حمله کار میکنه؟

🟢 دیباگ واقعیت — دفاع

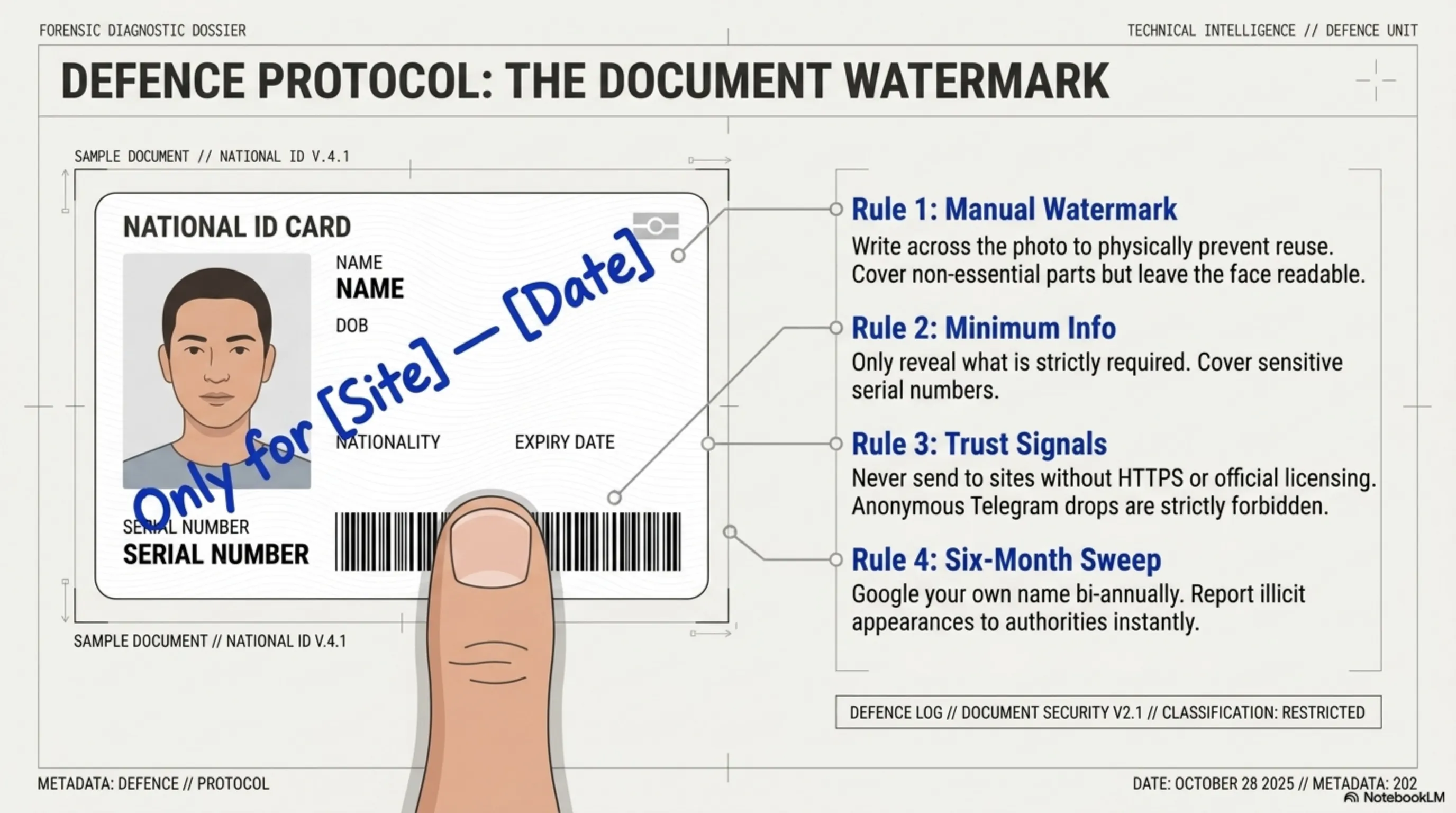

🛡️ پروتکل واترمارک — قانون طلایی مدارک

✅ قانون ۱: واترمارک دستی

قبل از ارسال هر مدرک، با خودکار روی عکس بنویسید: «فقط برای [نام سایت] — [تاریخ امروز]». این عکس دیگه در جای دیگهای قابل استفاده نیست.

✅ قانون ۲: نماد اعتماد

هرگز مدرک به سایتی بدون HTTPS، نماد اعتماد الکترونیکی یا مجوز رسمی ارسال نکنید. چتهای ناشناس تلگرام = ممنوع.

✅ قانون ۳: حداقل اطلاعات

فقط بخشی از مدرک که لازمه رو نشون بدید. شماره ملی کامل رو هرگز در عکس نشون ندید — اون رو با انگشت بپوشانید.

✅ قانون ۴: پیگیری

هر ۶ ماه یه بار اسم خودتون رو در گوگل سرچ کنید. اگه مدرکتون جایی ظاهر شد که نباید، فوری به پلیس فتا گزارش بدید.

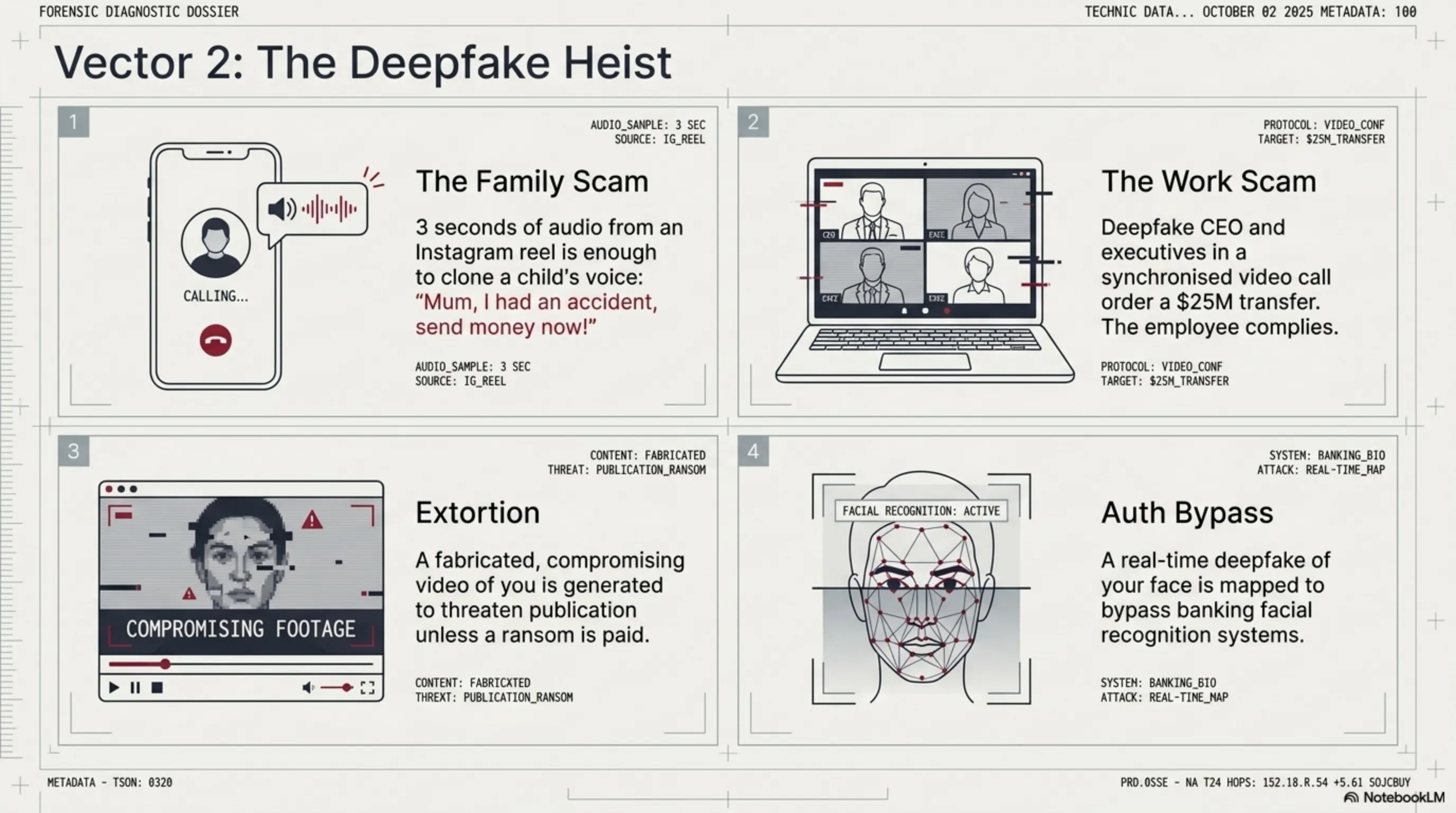

🎭 بخش دوم: سرقتهای دیپفیک — The Deepfake Heist

🔴 کالبدشکافی حمله

در ۲۰۲۴، یه کارمند مالی در یه شرکت چندملیتی ۲۵ میلیون دلار انتقال داد — چون در یه تماس ویدیویی، CFO و چند مدیر ارشد شرکت رو دید که دستور میدادن. همهشون deepfake بودند. در ۲۰۲۵، آمریکاییها ۵ میلیون دلار فقط از کلاهبرداریهای voice cloning از دست دادند. خسارت deepfake در آمریکا در ۲۰۲۵ به ۱.۱ میلیارد دلار رسید — سه برابر ۲۰۲۴.

⚠️ سناریوهای رایج حمله

📊 آمار deepfake ۲۰۲۵-۲۰۲۶

🟢 دیباگ واقعیت — دفاع

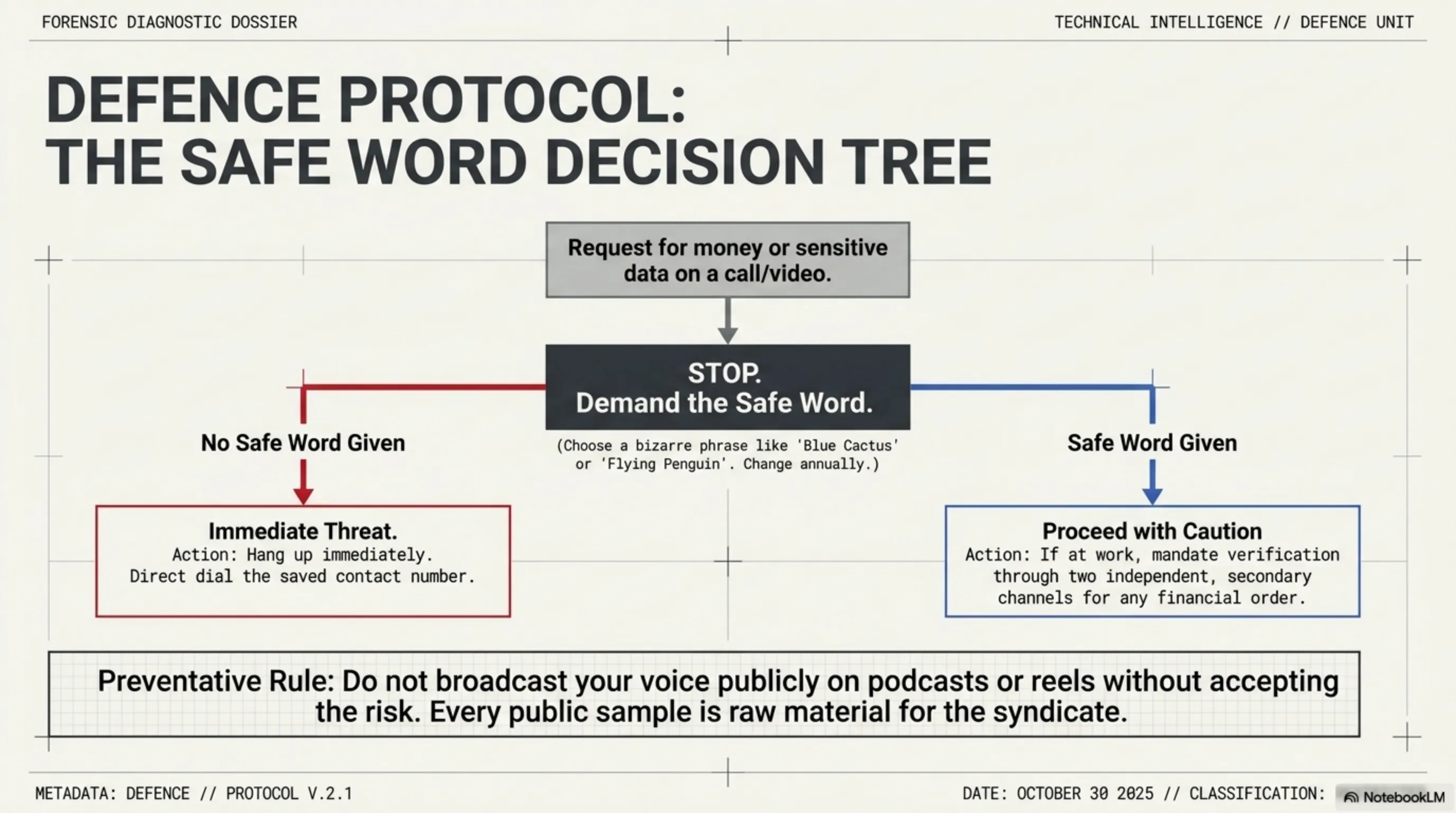

🛡️ پروتکل «کلمه عبور خانواده» — Family Safe Word

این سادهترین و مؤثرترین دفاع در برابر کلاهبرداریهای صوتی است. همین امشب با خانوادهتون یه کلمه رمز تعیین کنید:

قانون: اگه کسی در تماس تلفنی یا ویدیویی درخواست پول کرد، اول باید کلمه رمز رو بگه. اگه نگفت = deepfake است. قطع کنید و مستقیم با شماره ذخیرهشده تماس بگیرید.

✅ برای خانواده

یه کلمه عجیب که فقط خانواده میدونه. مثلاً «سیبزمینی» یا «دایناسور». هر سال عوضش کنید.

✅ برای محیط کار

هر دستور مالی بالای یه مبلغ مشخص باید از دو کانال مستقل تأیید بشه. تماس ویدیویی به تنهایی کافی نیست.

✅ شبکههای اجتماعی

صدای خودتون رو در پادکست، ریل یا استوری عمومی نکنید. هر نمونه صوتی عمومی = مواد خام برای clone.

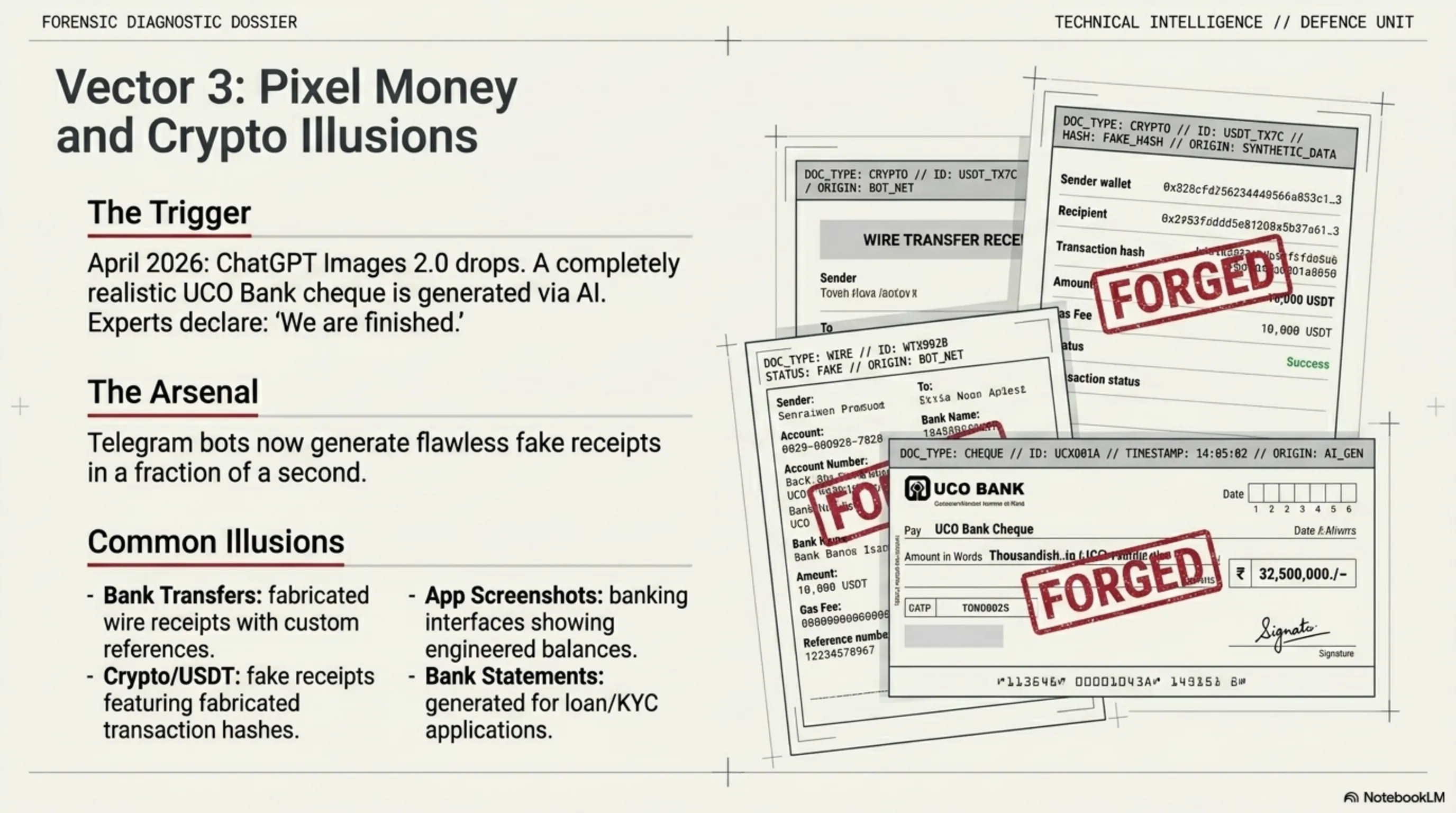

💸 بخش سوم: رسیدهای بانکی جعلی — Fake Receipts & Crypto Illusions

🔴 کالبدشکافی حمله

در آوریل ۲۰۲۶، انتشار ChatGPT Images 2.0 یه موج جدید از نگرانی ایجاد کرد. یه کاربر هندی یه چک بانکی UCO Bank کاملاً واقعی با AI ساخت و در شبکههای اجتماعی منتشر کرد. واکنش کارشناسان: «تمام شدیم». باتهای تلگرامی الان رسید کارت به کارت، ساتنا، انتقال تتر و حتی رسید PayPal رو در کسری از ثانیه میسازن.

⚠️ انواع رسیدهای جعلی رایج در ایران

یه تحقیق نشون داد که در بعضی پلتفرمها، سهم اسناد مالی جعلی AI-generated از صفر به ۱۴٪ در یه سال رسید. هزینه کلاهبرداری با رسید جعلی برای شرکتها به طور میانگین ۵٪ از درآمد سالانه است.

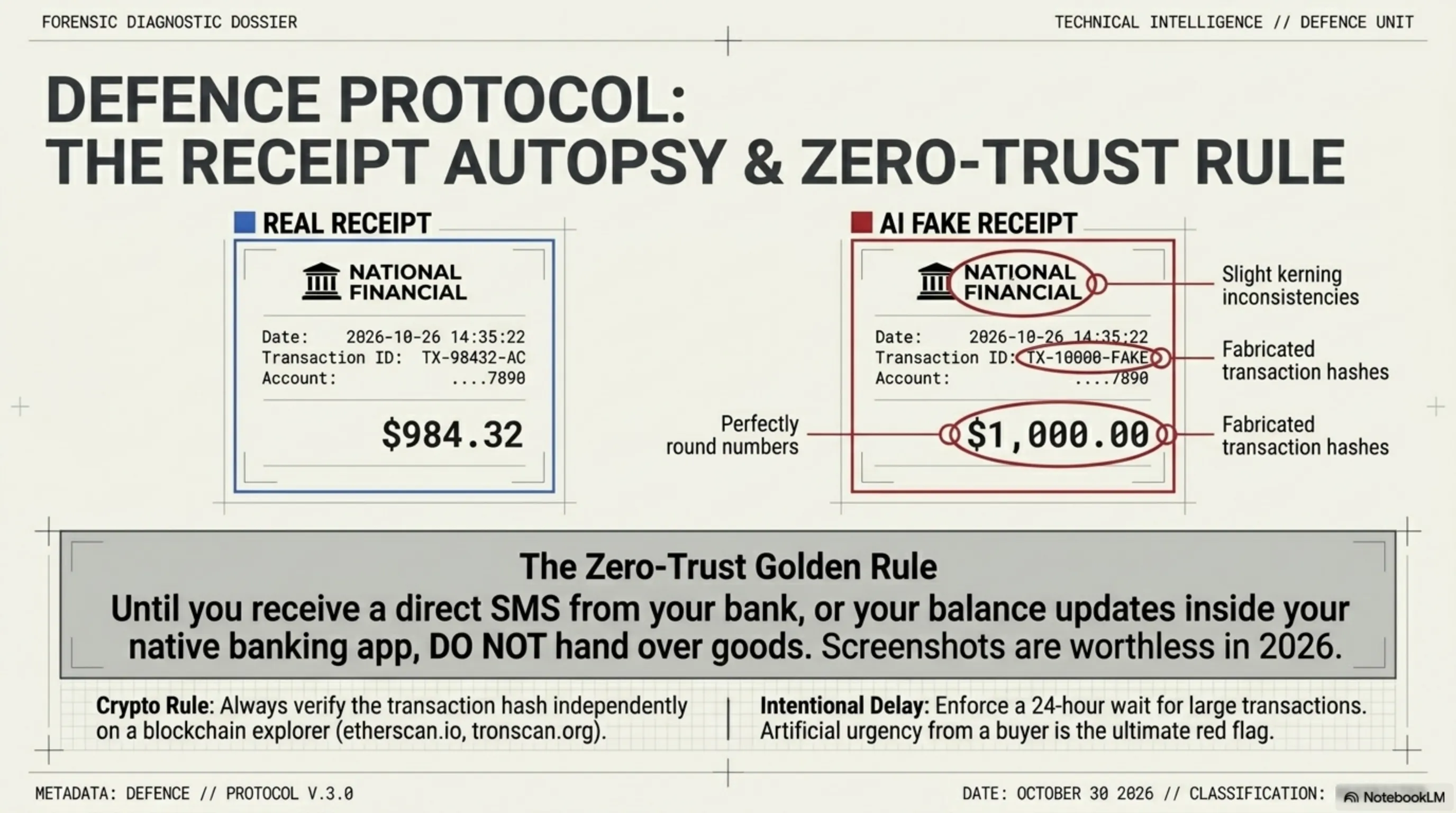

🟢 دیباگ واقعیت — قانون «اعتماد صفر» (Zero-Trust)

🛡️ قانون طلایی گاراژ تکین: Zero-Trust

🚨 تا زمانی که پیامک واریز مستقیم از بانک به گوشی شما نرسیده یا موجودی در اپلیکیشن بانکتان آپدیت نشده، هیچ کالایی را تحویل ندهید. اسکرینشاتها در سال ۲۰۲۶ هیچ ارزشی ندارند!

✅ تأیید مستقیم

فقط پیامک مستقیم از بانک (نه forward شده) یا موجودی آپدیتشده در اپ بانکی معتبره.

✅ تراکنش کریپتو

hash تراکنش رو در blockchain explorer (etherscan.io، tronscan.org) چک کنید. تا confirm نشده = پول نرسیده.

✅ تأخیر عمدی

برای معاملات بزرگ، ۲۴ ساعت صبر کنید. کلاهبرداران همیشه «فوری» هستن — این خودش یه علامت هشداره.

✅ تماس مستقیم

اگه شک دارید، با بانک مستقیم تماس بگیرید — نه از طریق لینک یا شمارهای که خریدار داده.

🛡️ بخش چهارم: چکلیست بازرس تکین — The Tekin Shield

این بخش مهمترین بخش مقالهست. ابزارها و تکنیکهای چشمی که بهتون یاد میده چطور محتوای جعلی رو با چشم خودتون شناسایی کنید — بدون نیاز به نرمافزار خاص.

🔍 چکلیست بازرس تکین — ۱۵ نشانه جعل

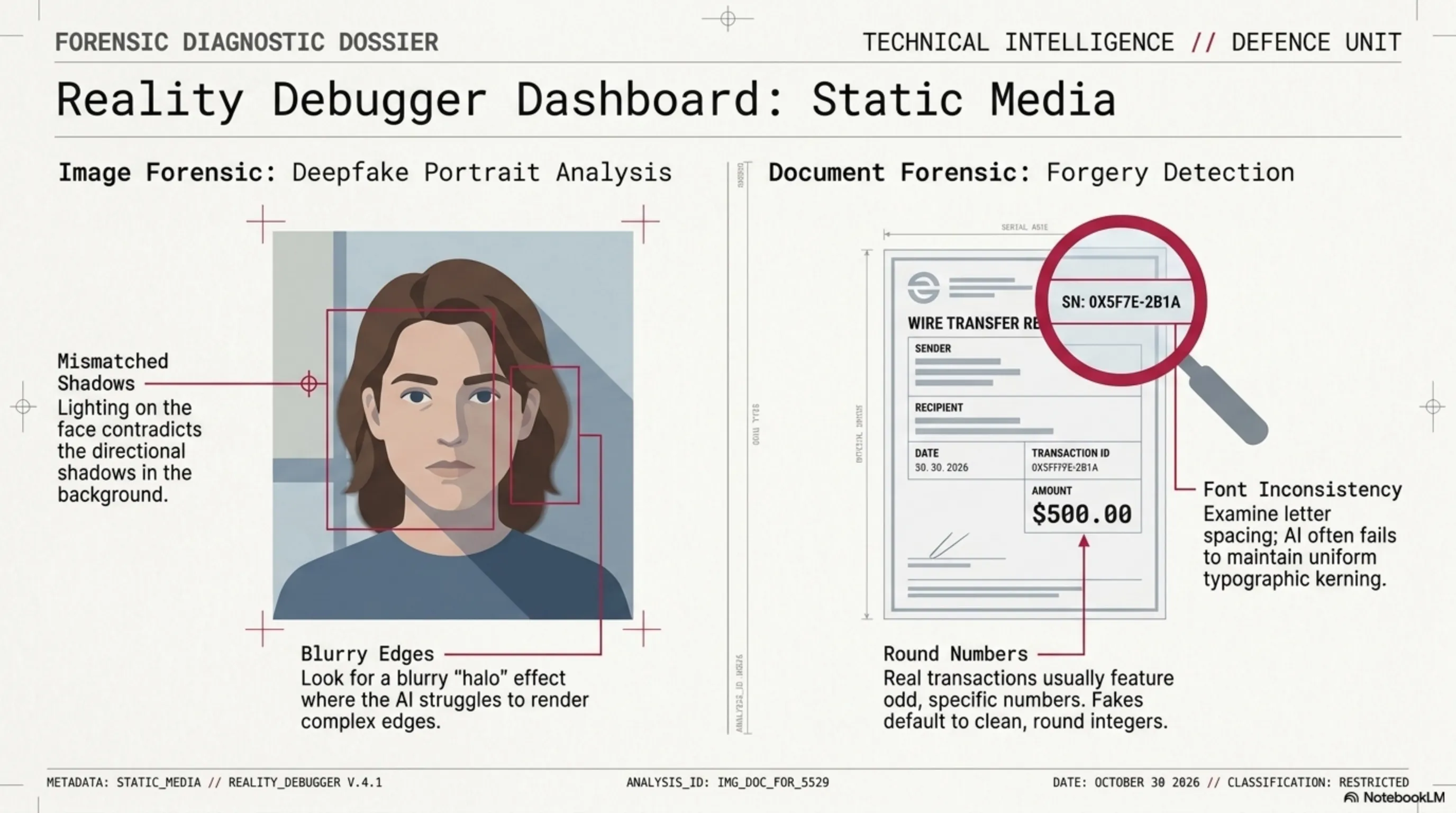

📸 تصاویر و اسناد جعلی:

در تصاویر جعلی، سایهها از جهتهای مختلف میان. نور روی صورت با نور پسزمینه هماهنگ نیست.

اطراف موها، گوشها و لبههای صورت در deepfake معمولاً تار یا «هالهدار» هستن.

در اسناد جعلی، فونتها کمی با هم فرق دارن. فاصله بین حروف یکنواخت نیست.

رسیدهای جعلی معمولاً مبالغ گرد دارن (۵۰۰,۰۰۰ تومان). رسیدهای واقعی معمولاً اعداد عجیب دارن.

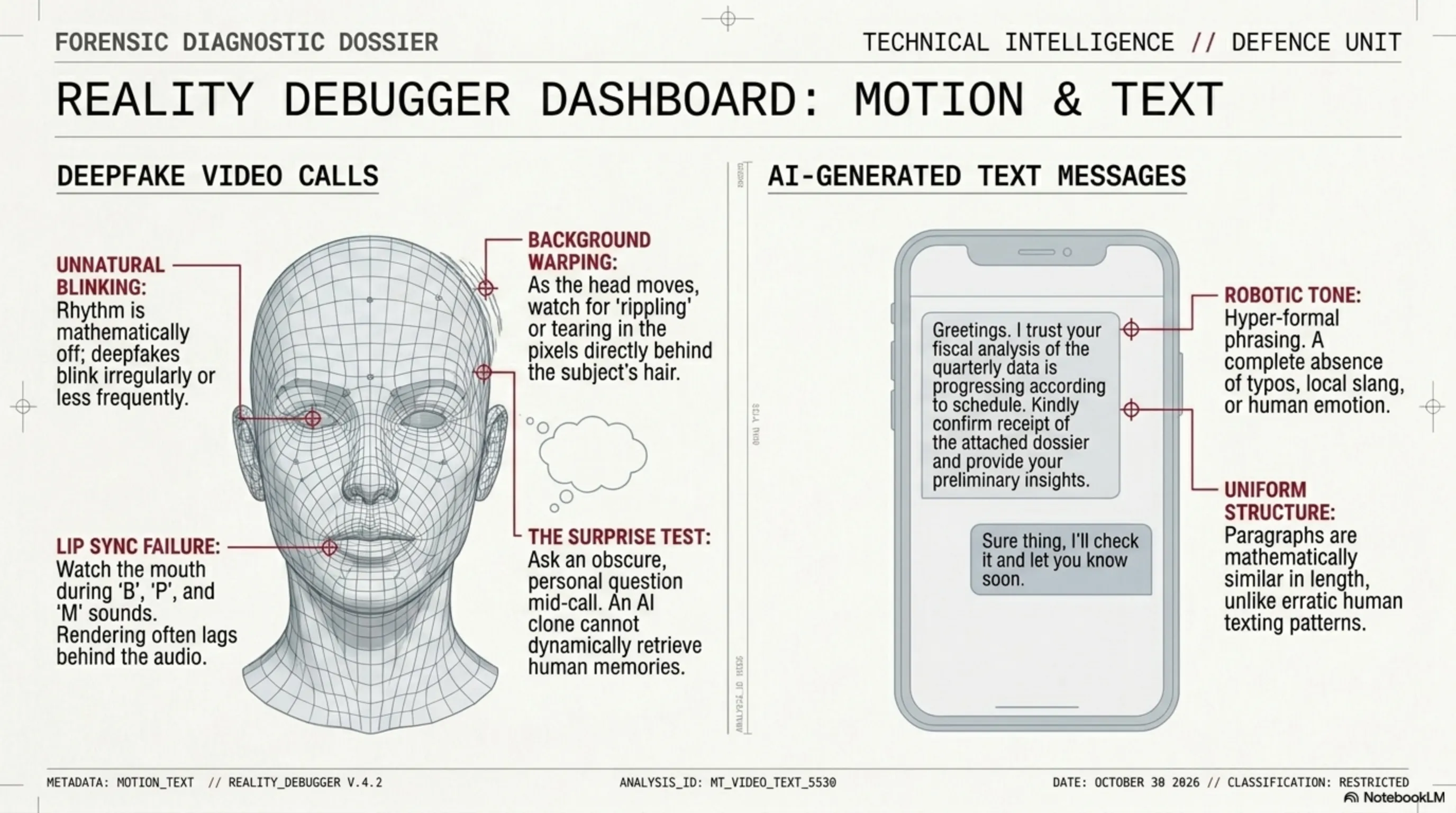

🎥 تماسهای ویدیویی deepfake:

deepfakeهای قدیمیتر کمتر پلک میزنن. مدلهای جدیدتر بهتر شدن ولی هنوز ریتم پلک زدن غیرطبیعیه.

حرکت لبها با صدا کمی ناهماهنگه. خصوصاً در حروف «ب»، «پ»، «م» که نیاز به بستن لب دارن.

اطراف سر و موها در deepfake گاهی «موج» میزنه — خصوصاً وقتی سر حرکت میکنه.

یه سوال شخصی بپرسید که فقط اون شخص میدونه. deepfake نمیتونه جواب بده.

🤖 پیامهای متنی AI-generated:

پیامهای AI خیلی رسمی، بدون اشتباه تایپی، بدون اصطلاحات محلی و بدون احساس هستن.

پیامهای AI معمولاً طول مشابه دارن و ساختار مشابه. انسانها پیامهای کوتاه و بلند میفرستن.

«فوری»، «همین الان»، «فرصت محدود» — کلاهبرداران میخوان شما فکر نکنید.

🌡️ دماسنج تهدید: وضعیت جعل AI در ۲۰۲۶

🌡️ دماسنج تهدید جعل AI — ۲۰۲۶

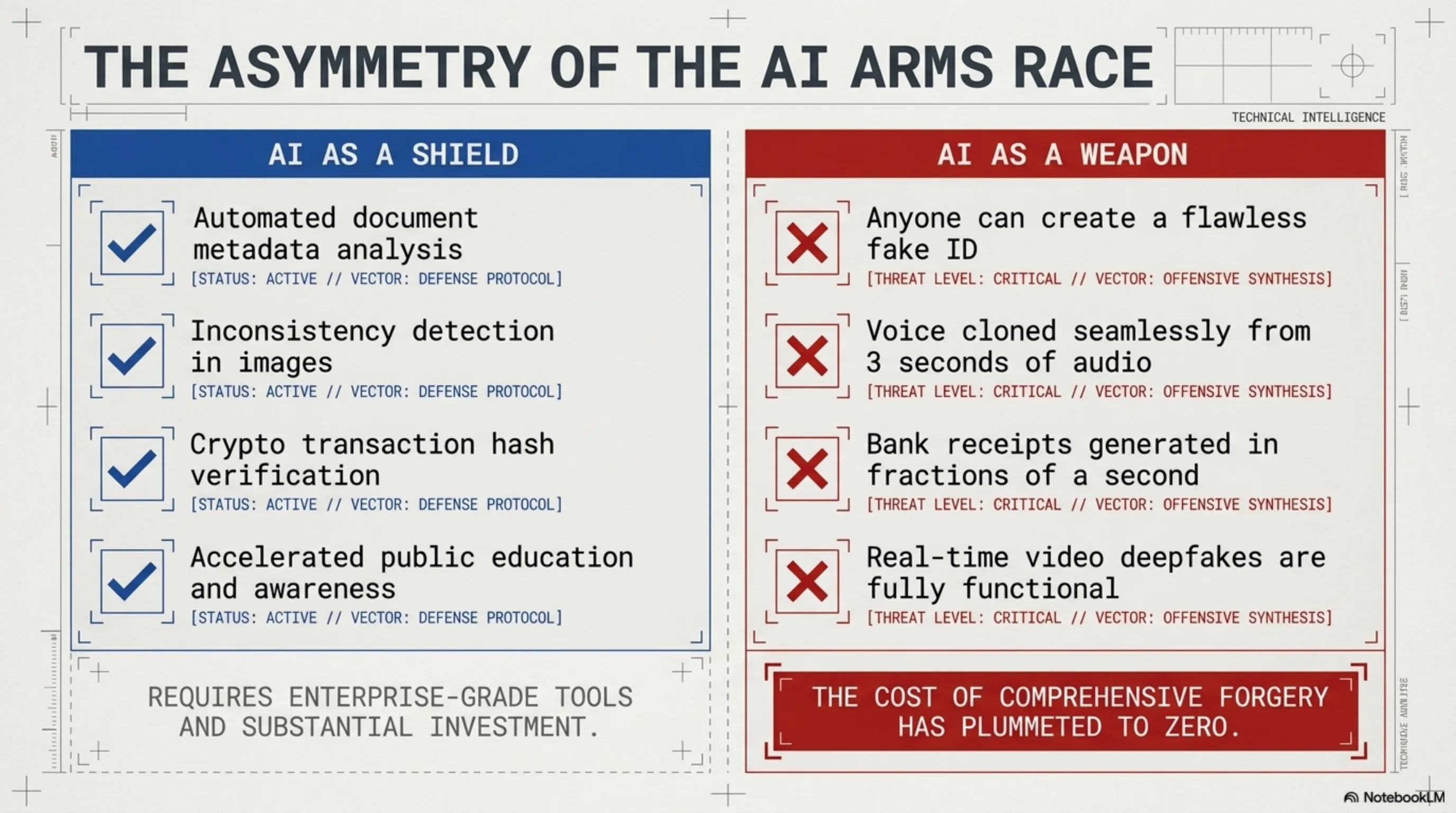

سیگنال استراتژیک: AI barrier ورود به جعل رو به صفر رسونده. ولی آموزش و پروتکلهای ساده هنوز مؤثرترین دفاع هستن.

🏷️ پرونده کامل: تاریخچه جعل دیجیتال

🕰️ مرور پرونده: از فتوشاپ تا AI

- ۲۰۱۰: فتوشاپ — جعل تصویر نیاز به مهارت داشت. فقط متخصصان میتونستن.

- ۲۰۱۷: اولین deepfakeهای ویدیویی — نیاز به GPU قوی و ساعتها پردازش.

- ۲۰۲۳: ابزارهای deepfake عمومی شدن — هر کسی میتونه. کلاهبرداری ۳۰۰۰٪ رشد کرد.

- ۲۰۲۴: $25M انتقال با deepfake CFO. ElevenLabs voice cloning عمومی شد. تکین مورنینگ ۲۹ آوریل ←

- ۲۰۲۵: $1.1B خسارت deepfake آمریکا. جعل اسناد ۲۴۴٪ رشد کرد.

- ۲۰۲۶: ChatGPT Images 2.0 — چک بانکی واقعی در ثانیه. «تمام شدیم» — کارشناسان.

⚔️ نبرد مزایا و معایب: AI در دنیای جعل

✅ AI در تشخیص جعل

❌ AI در ساخت جعل

- ✗ هر کسی میتونه ID جعلی بسازه

- ✗ صدا با ۳ ثانیه نمونه clone میشه

- ✗ رسید بانکی در کسری از ثانیه

- ✗ deepfake ویدیویی real-time ممکن شد

- ✗ هزینه جعل به صفر رسیده

❓ سوالات متداول

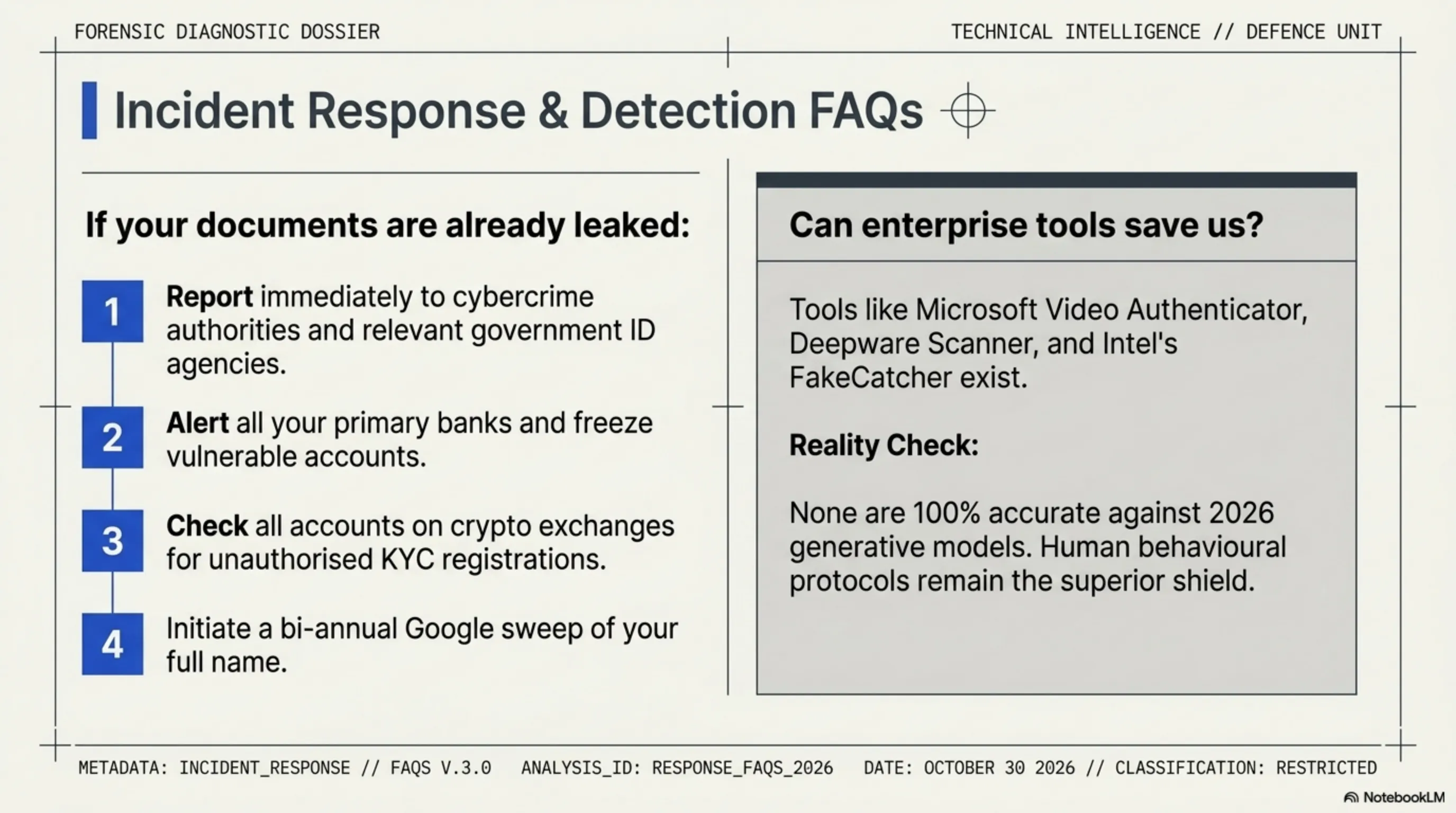

🔹 اگه مدرکم قبلاً آپلود شده، الان چیکار کنم؟

🔹 آیا ابزاری هست که deepfake رو تشخیص بده؟

🔹 چطور بفهمم رسید بانکی واقعیه؟

🔹 کلمه رمز خانوادگی چطور باید باشه؟

🔹 آیا صدای من در پادکست یا ویدیو خطرناکه؟

🧠 جمعبندی نهایی — پیام تکینگیم به ارتش تکین

سندیکای جعل AI واقعیه و در حال رشده. ولی خبر خوب اینه: سادهترین پروتکلها مؤثرترین دفاع هستن. واترمارک دستی روی مدارک. کلمه رمز خانوادگی. Zero-Trust برای رسیدهای بانکی. و آموزش — چون ۷۵٪ از کلاهبرداریهای موفق به خاطر ناآگاهی قربانی هستن، نه ضعف تکنولوژی. ارتش تکین، این مقاله رو با خانوادهتون به اشتراک بذارید.

📚 منابع و مراجع

- Sumsub Identity Fraud Report 2025

- Trend Micro — AI Voice Cloning Scams 2025

- Resistant.AI — Global Document Fraud Report 2026

- Deepstrike.io — Deepfake Statistics 2025

- FamilyVest — Deepfake losses $1.1B in 2025

- American Banker — Banks cope with AI-faked documents

- Zyphe — AI fake IDs for $15 in 2 minutes

- تیم تحریریه تکینگیم — تحلیل و راهکارهای اختصاصی

🌐 با ما در ارتباط باشید

برای دریافت آخرین اخبار امنیت سایبری، تکنولوژی و گجتها، ما را دنبال کنید:

گالری تصاویر تکمیلی: 🕵️ کالبدشکافی سندیکای جعل AI: راهنمای دیباگ واقعیت و امنیت