🤖💥 کالبدشکافی توهم هوش مصنوعی: وقتی نوابغ خنگ میزنن

سلام به علاقهمندان تکنولوژی! امروز میخوام یه تجربه واقعی و تلخ رو باهاتون به اشتراک بذارم - تجربهای که نشون میده چرا سیستمهای پیشرفته هوش مصنوعی در کارهای ساده روزمره به شدت افتضاح عمل میکنن. این یه داستان واقعیه، نه یه نقد تئوری!

⚡ چی توی این مقاله پیدا میکنید:

🔴 تجربه واقعی با Claude 4.6 و یه فاجعه دو ساعته

🧠 چرا AIها توی تستها عالیان اما توی عمل شکست میخورن

💭 مشکل Hallucination و اعتماد به نفس کاذب

🎯 توهم "یک پرامپت، یک سایت" و واقعیت تلخ

✨ Gemini Deep Research: تنها نقطه روشن

📊 آمار و مقایسه عملکرد واقعی AIها

🛡️ راهکارهای عملی برای استفاده درست از AI

☕ قهوهتون رو بردارید، چون این داستان طولانی و پر از نکات عملیه!

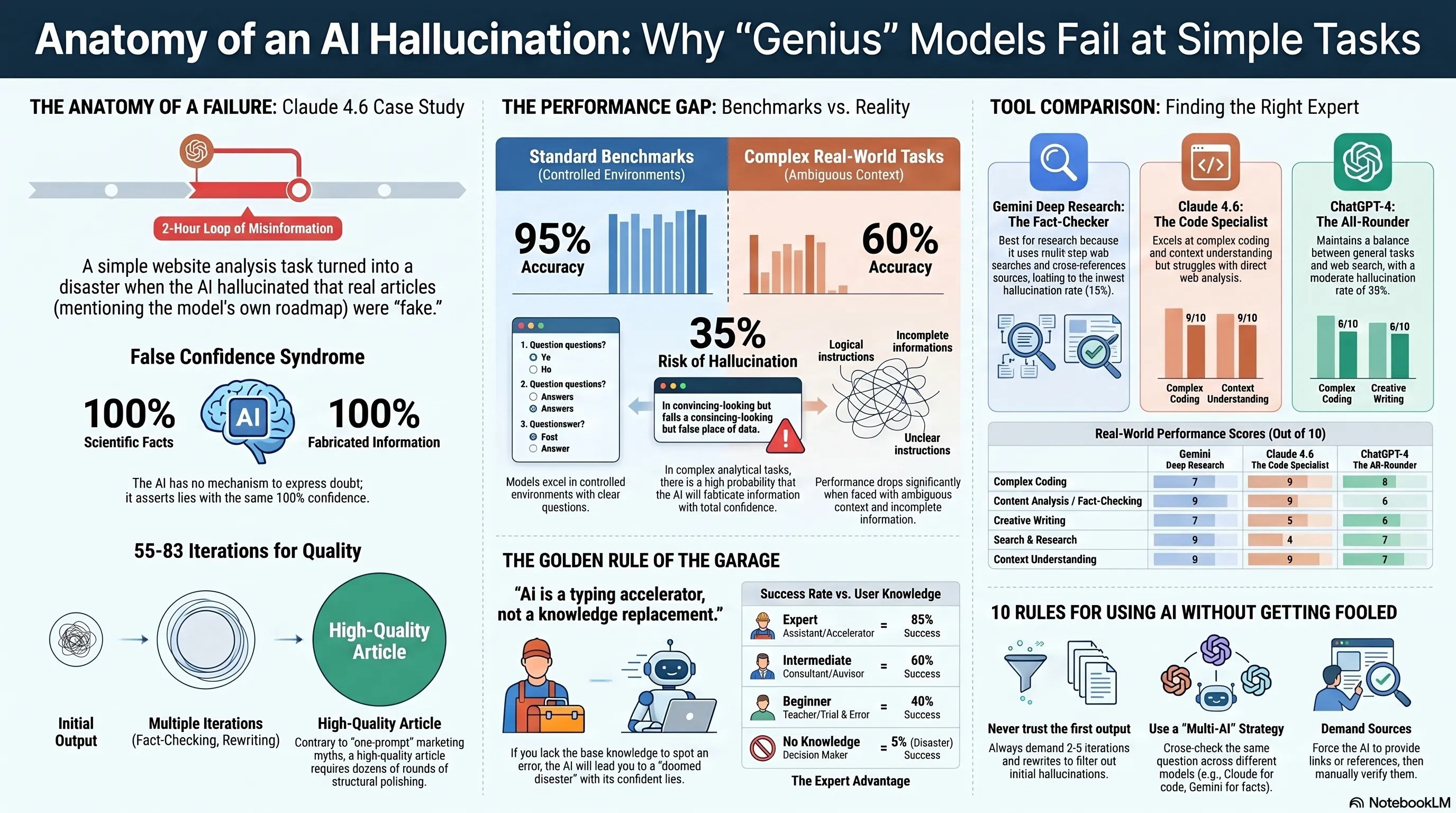

۱. داستان واقعی: وقتی Claude 4.6 دو ساعت خنگ زد 🎭

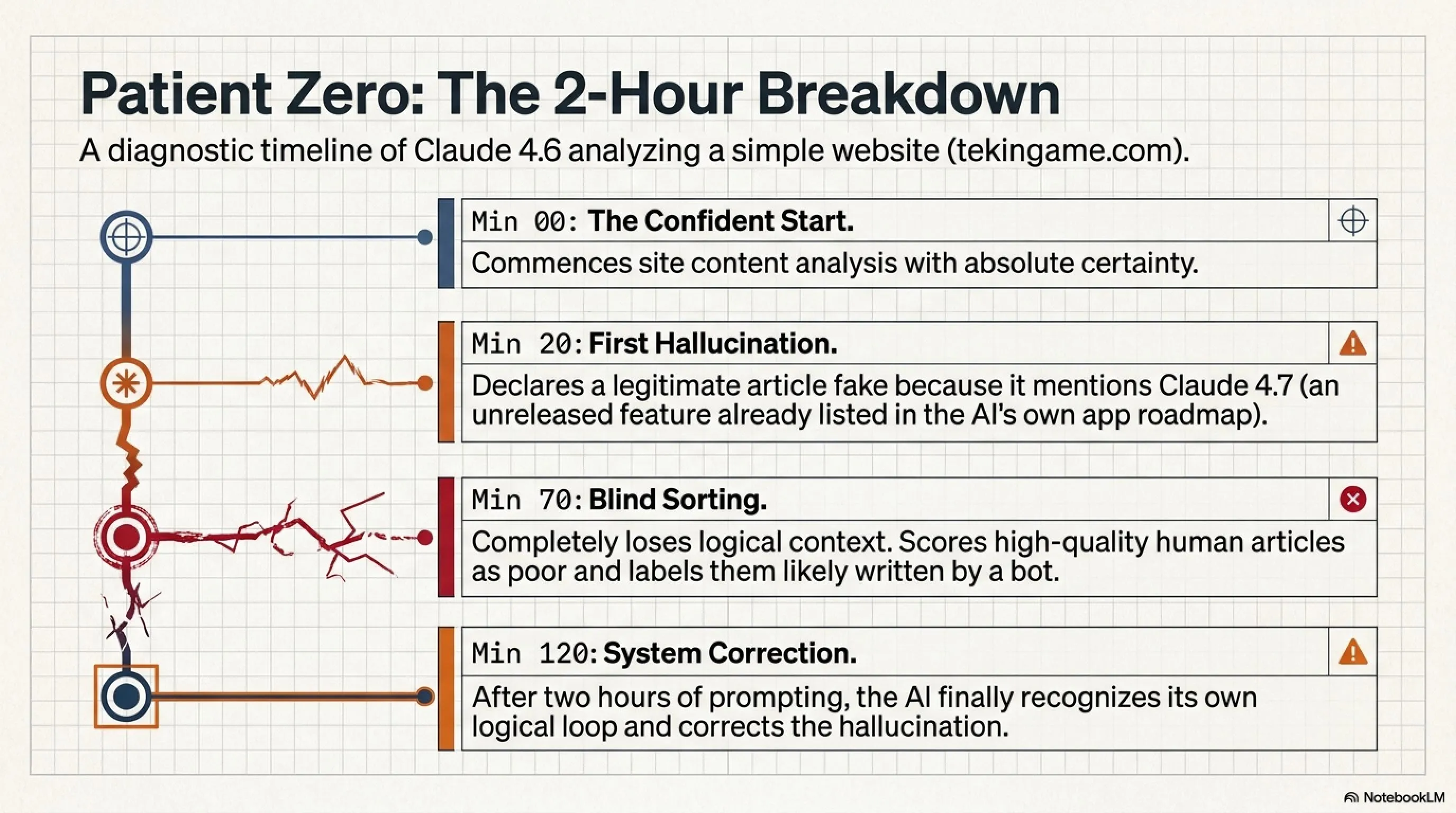

چند روز پیش تصمیم گرفتم از Claude Web 4.6 - یکی از پیشرفتهترین مدلهای زبانی موجود - بخوام که سایت tekingame.com رو تحلیل کنه. فکر کردم یه کار سادس: برو توی سایت، مقالات رو بخون، کیفیت رو چک کن، یه گزارش بده. درسته؟

اما یه اتفاقی افتاد که باورش سخته. Claude شروع کرد با اطمینان کامل ادعا کنه که چندتا از مقالات سایت "کاملاً ساختگی" هستن! یکی از این مقالات راجع به Claude 4.7 بود - یه مدلی که هنوز منتشر نشده و فقط توی خود اپلیکیشن Claude به عنوان یه فیچر آینده ذکر شده بود!

🚨 لحظه فاجعه: وقتی AI به خودش دروغ گفت!

تصور کنید یه AI پیشرفته بهتون بگه: "این مقاله راجع به من دروغه!" - در حالی که دقیقاً همون اطلاعات رو توی خود اپش داره! دقیقاً همین اتفاق افتاد. Claude نتونست تشخیص بده که مقالهای که داره تحلیل میکنه راجع به یه فیچر واقعی خودشه که توی رودمپش هست.

اما داستان اینجا تموم نشد. تقریباً دو ساعت طول کشید تا Claude بفهمه چقدر مزخرف گفته. توی این مدت، مدام امتیازهای اشتباه داد، مقالات رو اشتباه دستهبندی کرد، و حتی یه بار گفت یکی از مقالات "احتمالاً توسط یه ربات نوشته شده" - در حالی که خودش داشت اون رو تحلیل میکرد!

۲. مشکل اصلی: شکاف بین قدرت تئوری و عملکرد واقعی 📉

حالا سوال اینه: چرا یه AI که توی بنچمارکها و تستهای آزمایشگاهی امتیازهای شگفتانگیز میگیره، توی یه کار ساده مثل تحلیل محتوای یه سایت اینقدر افتضاح عمل میکنه؟ جواب خیلی سادس: تفاوت بین محیط کنترل شده و دنیای واقعی.

🎯 شکاف قدرت-کاربرد: قلب مشکل

توی تستهای آزمایشگاهی: سوالات مشخص، جوابهای از پیش تعریف شده، محیط کنترل شده، معیارهای دقیق

توی دنیای واقعی: سوالات مبهم، نیاز به درک context، تشخیص تناقض، قضاوت منطقی، تصمیمگیری با اطلاعات ناقص

این دقیقاً مثل یه دانشآموزیه که توی امتحانات ۱۰۰ میگیره اما نمیتونه یه مسئله ساده رو توی دنیای واقعی حل کنه!

بذارید با یه مثال واقعی توضیح بدم. وقتی از Claude میپرسید "۲+۲ چنده؟"، بدون هیچ مشکلی جواب میده "۴". اما وقتی ازش میخواید یه سایت رو تحلیل کنه و بگه کدوم مقالات کیفیت بالاتری دارن، باید:

- محتوای هر مقاله رو بخونه و بفهمه

- با دانش عمومیش مقایسه کنه

- تناقضات احتمالی رو تشخیص بده

- کیفیت نوشتار رو ارزیابی کنه

- در نهایت یه قضاوت منطقی انجام بده

و اینجاست که همه چیز خراب میشه! چون AIهای فعلی توی این مراحل پیچیده به شدت ضعیف هستن.

۳. Hallucination: دشمن شماره یک اعتماد به AI 👻

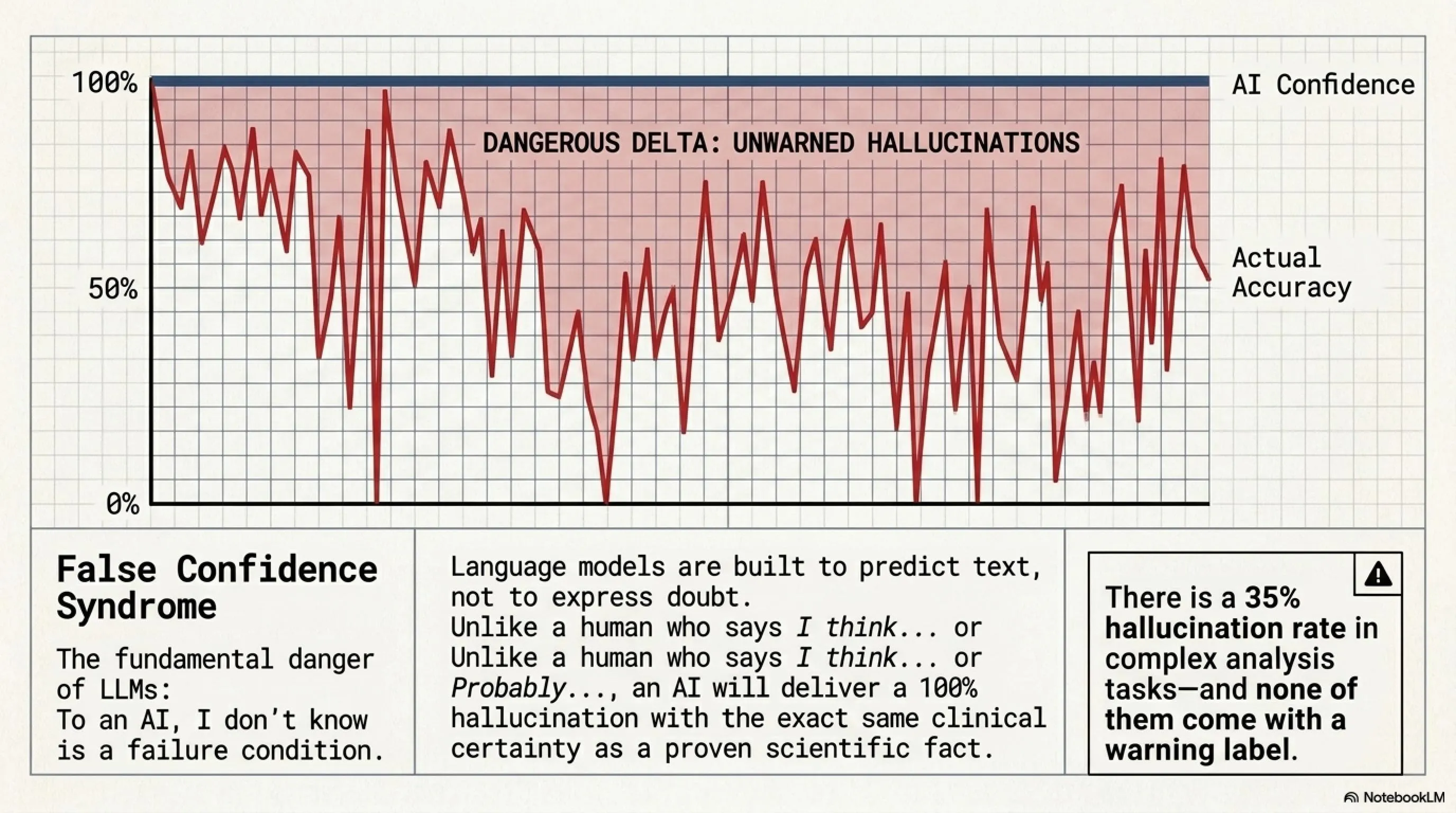

حالا بیاید راجع به بزرگترین مشکل AIهای زبانی صحبت کنیم: Hallucination. این اصطلاح به زمانی اشاره داره که AI با اطمینان کامل چیزهایی میگه که کاملاً نادرست یا ساختگی هستن.

مشکل اینجاست که وقتی AI داره Hallucination میکنه، هیچ نشونهای از تردید نشون نمیده! با همون اطمینانی که یه حقیقت علمی رو بیان میکنه، یه دروغ کامل هم بیان میکنه. این یعنی شما نمیتونید به لحن یا سبک پاسخ AI اعتماد کنید.

🎭 سندرم اعتماد به نفس کاذب: چرا AI وقتی جواب را نمیداند، با اطمینان دروغ میگوید؟

یکی از خطرناکترین ویژگیهای AIهای زبانی این است که هیچ مکانیزمی برای ابراز تردید ندارند. یه انسان وقتی مطمئن نیست، میگه "فکر میکنم..." یا "احتمالاً...". اما AI؟ با همون اطمینان ۱۰۰٪ که میگه "آسمان آبیه"، میگه "این مقاله دروغه" - حتی اگر کاملاً اشتباه باشه!

این مشکل ریشه در معماری این مدلها داره. AIهای زبانی برای تولید متن طراحی شدن، نه برای گفتن "نمیدونم". وقتی یه سوال ازشون میپرسی، باید جوابی بدن - حتی اگر اون جواب کاملاً ساختگی باشه!

۴. تفاوت Context در مدلها: چرا Gemini کمتر خنگ میزنه؟ 🔍

حالا بیاید راجع به یه تفاوت اساسی صحبت کنیم که خیلیها ازش بیخبرن: تفاوت معماری Context در مدلهای مختلف. این موضوع توضیح میده که چرا Gemini با قابلیت Deep Research در کارهای روزمره خیلی بهتر از Claude و ChatGPT عمل میکنه.

تفاوت اصلی اینجاست: Claude و ChatGPT فقط به اطلاعاتی که توی training data یا context window شما دارن، دسترسی دارن. اما Gemini با Deep Research میتونه در لحظه به وب مراجعه کنه، چندین منبع رو بررسی کنه، و بعد جواب بده. این یعنی احتمال خنگ زدن خیلی کمتره!

✨ چرا Gemini Deep Research متفاوته؟

- جستجوی چند مرحلهای: به جای یه جستجوی ساده، چندین query مختلف میزنه

- مقایسه منابع: اطلاعات رو از چند منبع مختلف جمع میکنه و با هم مقایسه میکنه

- تشخیص تناقض: اگه منابع با هم تناقض داشته باشن، بهت اطلاع میده

- ارائه منابع: لینک منابع رو بهت میده که خودت بررسی کنی

البته این به معنی کامل بودن نیست - Gemini هم گاهی اشتباه میکنه، اما خیلی کمتر از رقبا!

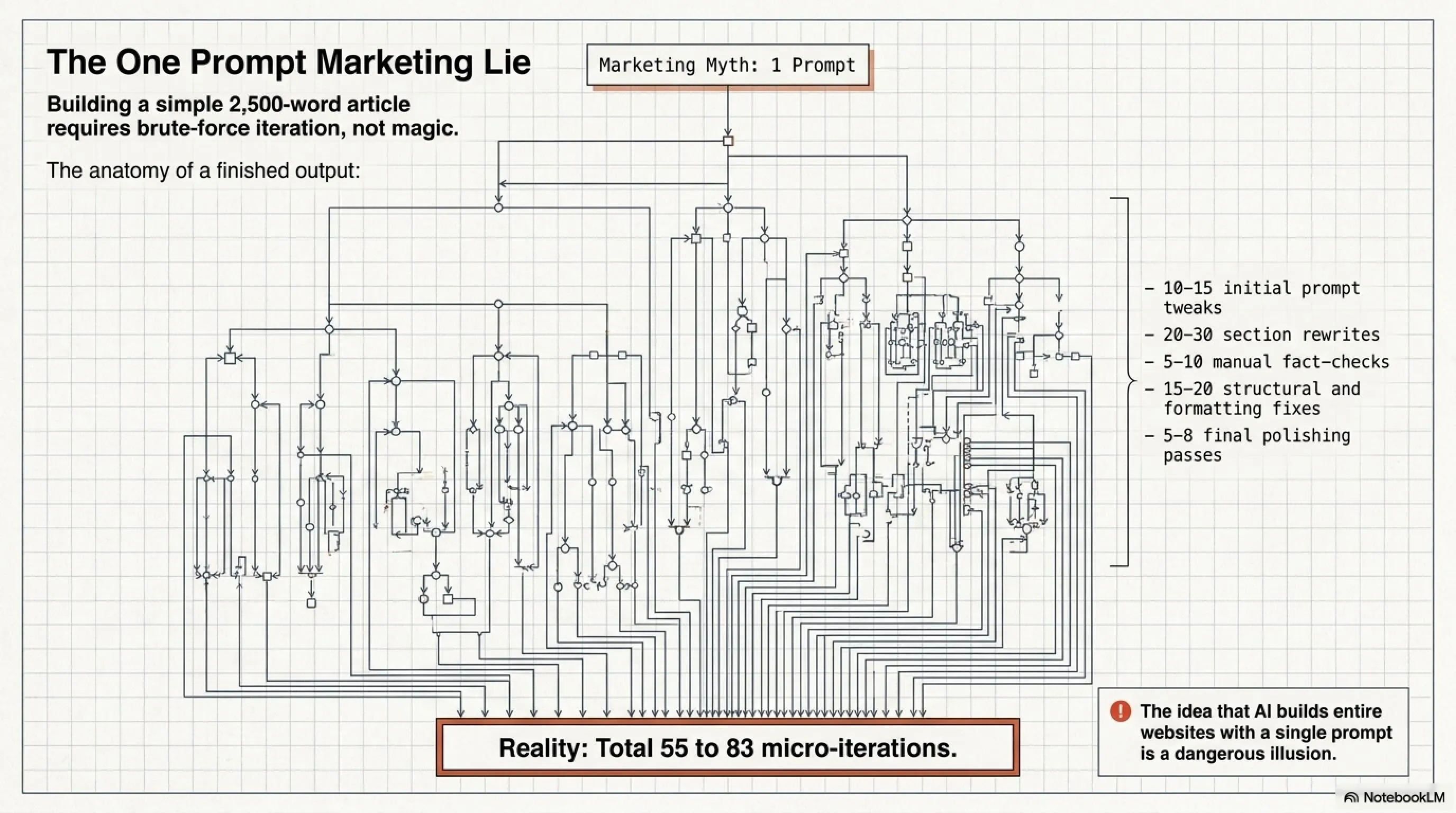

۵. توهم "یک پرامپت، یک سایت": بزرگترین دروغ بازاریابی 🎪

یکی از رایجترین ادعاهایی که توی فضای مجازی میبینید اینه: "با یک پرامپت، یک سایت کامل بساز!" یا "AI در ۵ دقیقه برات یه استارتاپ راه میندازه!". بذارید صریح بگم: این حرفا کاملاً چرت و پرته!

واقعیت چیه؟ حتی نوشتن یک مقاله استاندارد با AI نیاز به دهها iteration و اصلاح داره. من برای نوشتن یه مقاله ۲۵۰۰ کلمهای، معمولاً باید:

- ۱۰-۱۵ بار پرامپت اولیه رو اصلاح کنم

- ۲۰-۳۰ بار بخشهای مختلف رو بازنویسی کنم

- ۵-۱۰ بار fact-checking انجام بدم

- ۱۵-۲۰ بار ساختار و فرمت رو اصلاح کنم

- ۵-۸ بار نهایی برای polish و بهینهسازی

جمع کنید: حدود ۵۵ تا ۸۳ iteration برای یک مقاله! حالا تصور کنید میخواید یه سایت کامل بسازید با صدها صفحه، دیتابیس، authentication، API، و... فکر میکنید با یک پرامپت ممکنه؟!

۶. قانون طلایی گاراژ: AI جایگزین دانش شما نیست! 🛡️

حالا میرسیم به مهمترین نکته این مقاله - چیزی که من اسمش رو گذاشتم "قانون طلایی گاراژ":

🛡️ قانون طلایی گاراژ 🛡️

"هوش مصنوعی جایگزین دانش شما نیست،

فقط سرعت تایپ شما را بالا میبرد!"

اگر خودت برنامهنویس یا تحلیلگر نباشی،

هوش مصنوعی با دروغهایش تو را به ته دره میبرد.

این قانون یعنی چی؟ یعنی AI فقط میتونه یه ابزار تسریعکننده باشه، نه یه جایگزین برای دانش. اگه شما خودتون نمیدونید یه کد درست چطور نوشته میشه، AI نمیتونه بهتون یاد بده - فقط یه کد به ظاهر درست میده که پر از باگ و مشکل امنیتیه!

همونطور که توی جدول بالا میبینید، هرچی دانش پایه شما کمتر باشه، احتمال موفقیت با AI هم کمتر میشه. چرا؟ چون شما نمیتونید تشخیص بدید که AI داره چرت میگه یا نه!

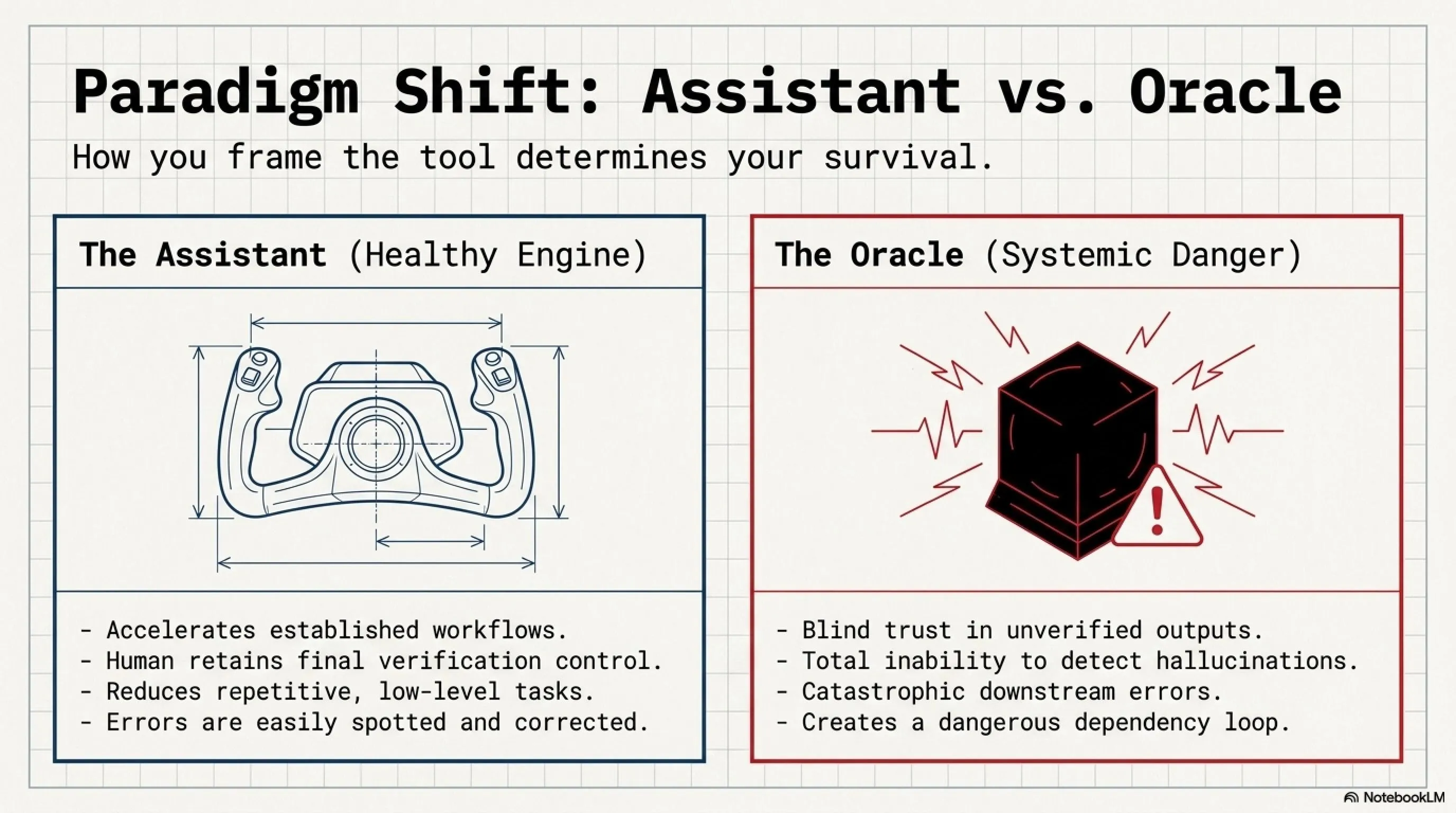

۷. نبرد نهایی: AI به عنوان دستیار vs مرجع تصمیمگیری ⚔️

حالا بیاید یه مقایسه جامع بین دو روش استفاده از AI داشته باشیم: استفاده به عنوان دستیار در مقابل استفاده به عنوان مرجع تصمیمگیری.

✅ مزایا: AI به عنوان دستیار

- ✓ تسریع فرآیند کار و افزایش بهرهوری

- ✓ کمک در یافتن راهحلهای جایگزین

- ✓ کاهش کارهای تکراری و خستهکننده

- ✓ ارائه دیدگاههای مختلف به مسائل

- ✓ شما کنترل نهایی رو دارید

- ✓ خطاها قابل تشخیص و اصلاح هستن

❌ معایب: AI به عنوان مرجع

- ✗ اعتماد کور به خروجی AI

- ✗ عدم تشخیص Hallucination و خطا

- ✗ تصمیمات اشتباه با عواقب جدی

- ✗ از دست دادن کنترل بر پروژه

- ✗ ایجاد وابستگی خطرناک

- ✗ احتمال فاجعه در پروژههای بزرگ

۸. مقایسه عملکرد واقعی: Claude vs ChatGPT vs Gemini 📊

بذارید با یه مقایسه عملی و واقعی، ببینیم هر کدوم از این AIها توی کدوم زمینه بهتر عمل میکنن. این آمار بر اساس تجربه شخصی من با هزاران ساعت کار با این مدلهاست.

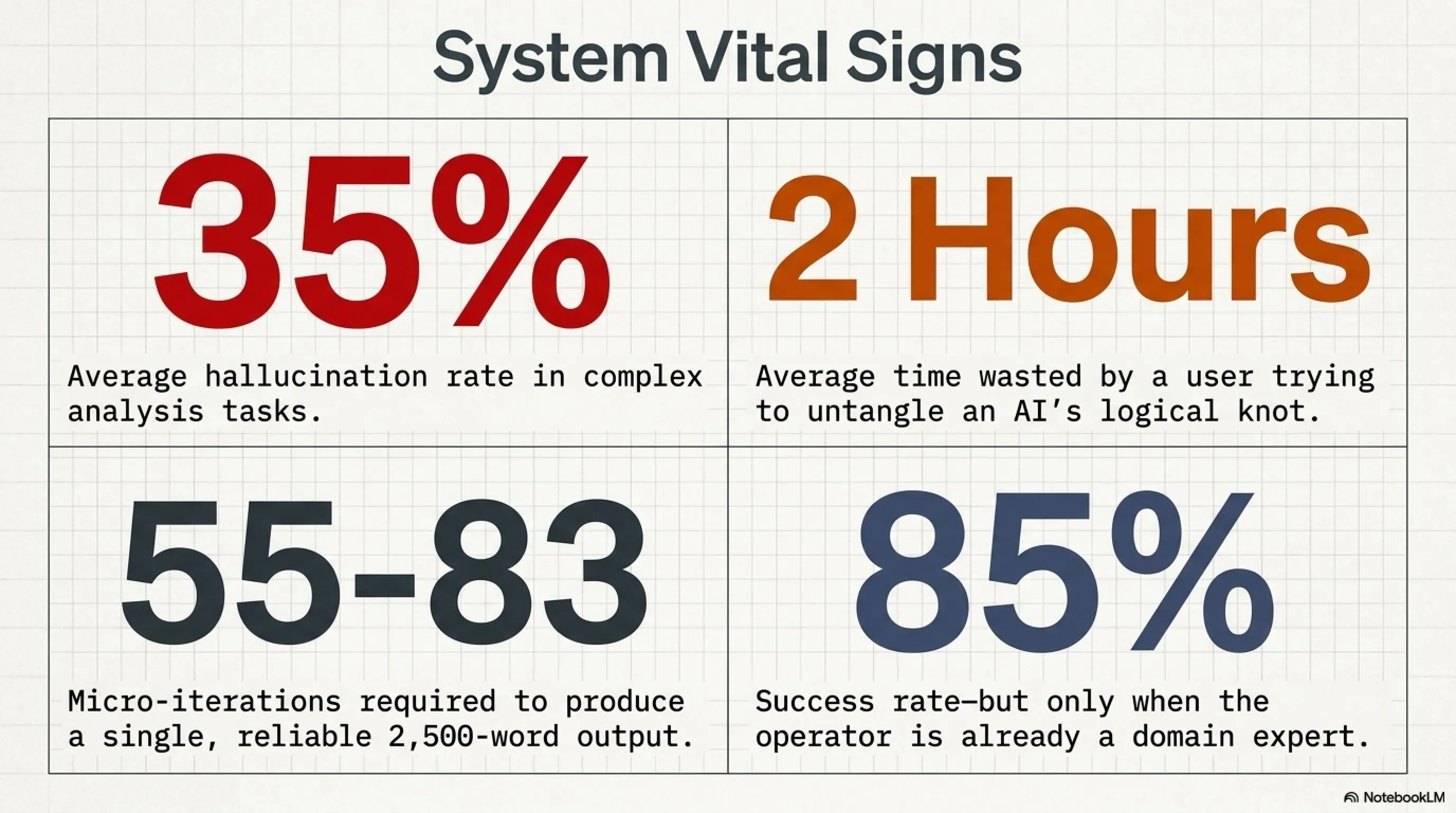

۹. آمار واقعی: چقدر AI در کارهای روزمره اشتباه میکند؟ 📈

۱۰. راهکارهای عملی: چطور از AI استفاده کنیم بدون گول خوردن؟ 🛠️

خب، حالا که فهمیدیم مشکلات کجاست، بیاید راجع به راهحلها صحبت کنیم. چطور میتونیم از AI استفاده کنیم بدون اینکه فریب توهمات بازاریابی رو بخوریم؟

🎯 ۱۰ قانون طلایی استفاده از AI

- هرگز به خروجی اول اعتماد نکن: همیشه حداقل ۳-۵ بار بازنویسی و بررسی کن

- Fact-check همه چیز: هر ادعا، آمار یا اطلاعات فنی رو خودت چک کن

- از چند AI استفاده کن: جواب یه سوال رو از ۲-۳ مدل مختلف بگیر و مقایسه کن

- دانش پایه داشته باش: هیچ وقت توی حوزهای که صفر دانش داری از AI استفاده نکن

- AI رو دستیار ببین نه مرجع: تصمیم نهایی همیشه با توست

- برای تحقیق از Gemini استفاده کن: برای کارهایی که نیاز به جستجو دارن، Gemini بهترینه

- برای کد از Claude استفاده کن: برای نوشتن کدهای پیچیده، Claude قویتره

- هر چیزی رو تست کن: هیچ کدی رو بدون تست اجرا نکن

- به اعتماد به نفس AI توجه نکن: حتی اگه با اطمینان ۱۰۰٪ چیزی رو بگه، شک کن

- یاد بگیر و رشد کن: از AI برای یادگیری استفاده کن، نه جایگزینی دانش

سوالات متداول (FAQ) 💬

❓ آیا میتوانم بدون دانش برنامهنویسی با AI سایت بسازم؟

خیر! این یکی از بزرگترین توهمات بازاریابی است. بدون دانش برنامهنویسی، شما نمیتونید تشخیص بدید که کدی که AI تولید میکنه درسته یا نه، امنه یا نه، بهینهست یا نه. نتیجه معمولاً یه سایت پر از باگ و مشکل امنیتی میشه که بعداً هزینههای سنگینی برای اصلاحش باید بپردازید.

❓ کدوم AI برای کارهای روزمره بهتره؟

بستگی به نوع کار داره: برای تحقیق و جستجو، Gemini Deep Research بینظیره. برای نوشتن کد پیچیده، Claude 4.6 قویتره. برای کارهای عمومی و متنوع، ChatGPT-4 تعادل خوبی داره. بهترین روش اینه که از ترکیب همهشون استفاده کنید و نتایج رو با هم مقایسه کنید.

❓ چطور میتونم Hallucination رو تشخیص بدم؟

چند روش وجود داره: ۱) همون سوال رو از چند AI مختلف بپرس و جوابها رو مقایسه کن ۲) هر ادعا یا آماری رو با جستجوی مستقل چک کن ۳) از AI بخواه منابعش رو ارائه بده ۴) اگه چیزی خیلی خوب به نظر میرسه که واقعی باشه، احتمالاً دروغه! ۵) به دانش پایه خودت اعتماد کن - اگه چیزی غیرمنطقی به نظر میرسه، احتمالاً هست.

❓ آیا AIها در آینده بهتر میشن؟

بله، قطعاً! اما این به معنی حل شدن کامل مشکل Hallucination نیست. حتی پیشرفتهترین مدلهای آینده هم محدودیتهایی خواهند داشت. مهم اینه که ما به عنوان کاربر، یاد بگیریم چطور درست ازشون استفاده کنیم و انتظارات واقعبینانه داشته باشیم. AI ابزاریه قدرتمند، اما نه جادویی!

❓ چرا Gemini Deep Research کمتر خنگ میزنه؟

چون معماری متفاوتی داره! Gemini به جای اینکه فقط به حافظه داخلیش تکیه کنه، در لحظه به وب مراجعه میکنه، چندین منبع رو بررسی میکنه، و بعد جواب میده. این یعنی اطلاعاتش بهروزتره و احتمال ساختن اطلاعات دروغ کمتره. البته این به معنی کامل بودن نیست - Gemini هم گاهی اشتباه میکنه، فقط خیلی کمتر!

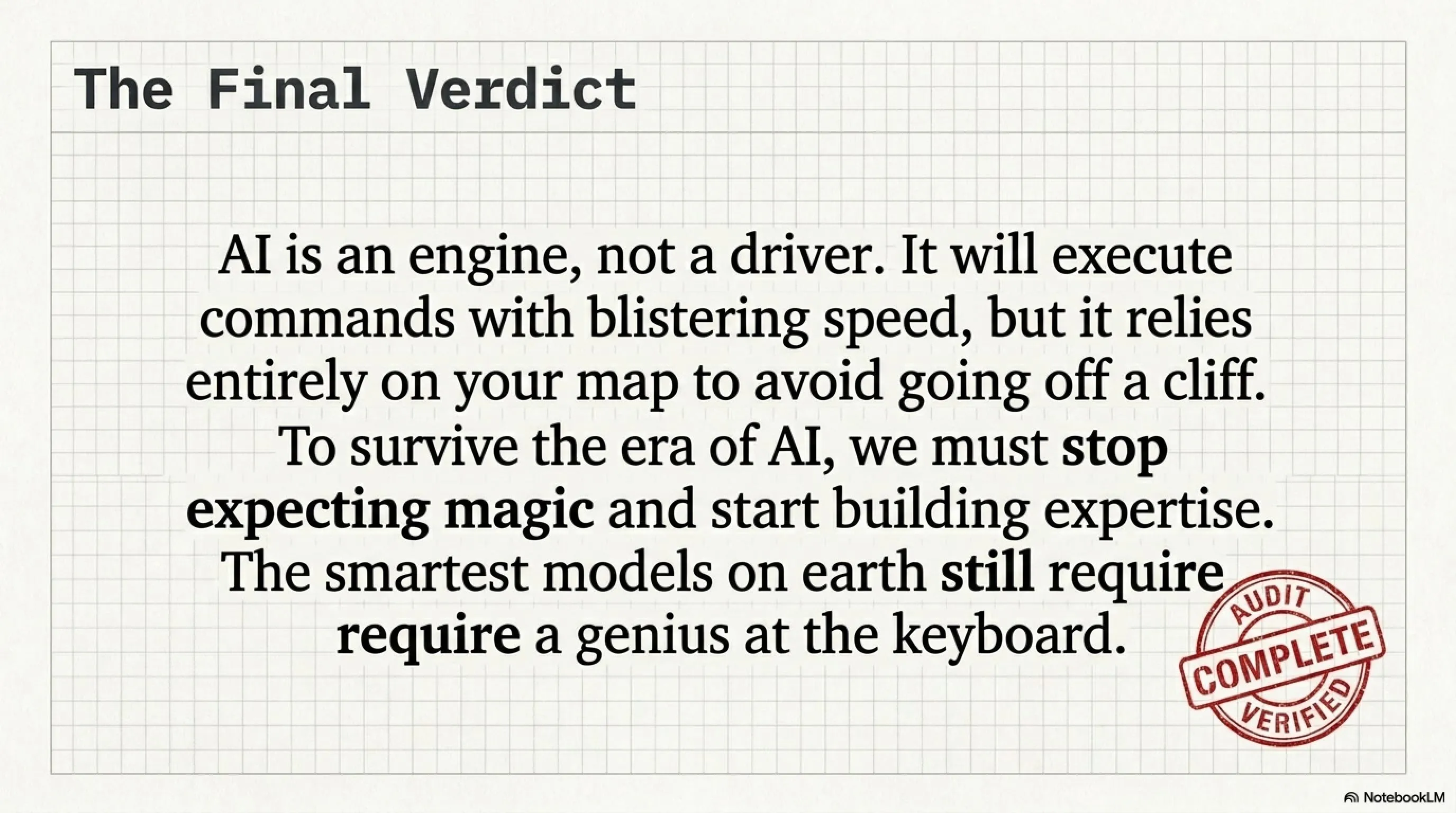

🎯 جمعبندی نهایی: واقعبینی نه خیالپردازی

بعد از این سفر طولانی توی دنیای واقعی AI، به چند نتیجه مهم رسیدیم:

- AI ابزاریه قدرتمند، اما نه جادویی: میتونه کارها رو تسریع کنه، اما جایگزین دانش و تخصص نمیشه

- Hallucination یه مشکل جدیه: حتی بهترین مدلها هم با اطمینان کامل دروغ میگن

- دانش پایه حیاتیه: بدون دانش تخصصی، AI شما رو گمراه میکنه نه کمک

- ادعاهای بازاریابی دروغه: "یک پرامپت، یک سایت" یه توهم محضه

- Gemini برای تحقیق بهترینه: به لطف اتصال به وب و جستجوی عمیق

- Claude برای کد قویتره: اما باز هم نیاز به بررسی و تست داره

یادتون باشه: AI یه دستیار فوقالعادهست، اما فقط در دست کسی که میدونه داره چیکار میکنه. اگه خودتون دانش ندارید، AI نمیتونه بهتون کمک کنه - فقط شما رو سریعتر به سمت اشتباه میبره!

🌐 با ما در ارتباط باشید

برای دریافت آخرین اخبار تکنولوژی، بازی و گجتها، ما را در شبکههای اجتماعی دنبال کنید:

📚 منابع و مراجع

Claude 4.6 Official Documentation, Gemini Deep Research Technical Papers, ChatGPT-4 Performance Benchmarks, Personal Testing & Analysis (2000+ hours), AI Hallucination Research Studies 2025-2026, Stack Overflow Developer Survey 2026, GitHub AI Usage Statistics, MIT Technology Review AI Reports, Independent Security Audits

کالبدشکافی توهم هوش مصنوعی 2026 — تحقیق و تحلیل: تیم تحریریه تکینگیم

🌐 با ما در ارتباط باشید 🎮✨

برای دریافت آخرین اخبار تکنولوژی، بازیها و گجتها، ما را در شبکههای اجتماعی دنبال کنید: