متا با رونمایی از ۴ تراشه اختصاصی سری MTIA رسماً به انحصار انویدیا حمله کرد. این «تکین آنالیز» به کالبدشکافی معماری این تراشهها، رقابت آنها با TPU v7 گوگل و سری Blackwell انویدیا، و تغییر استراتژی غولهای تکنولوژی به سمت «عصر Inference» میپردازد. آیا ورود بازیگران جدید میتواند اقتصاد و آیندهی هوش مصنوعی را تغییر دهد؟

🎯 خلاصه مدیریتی

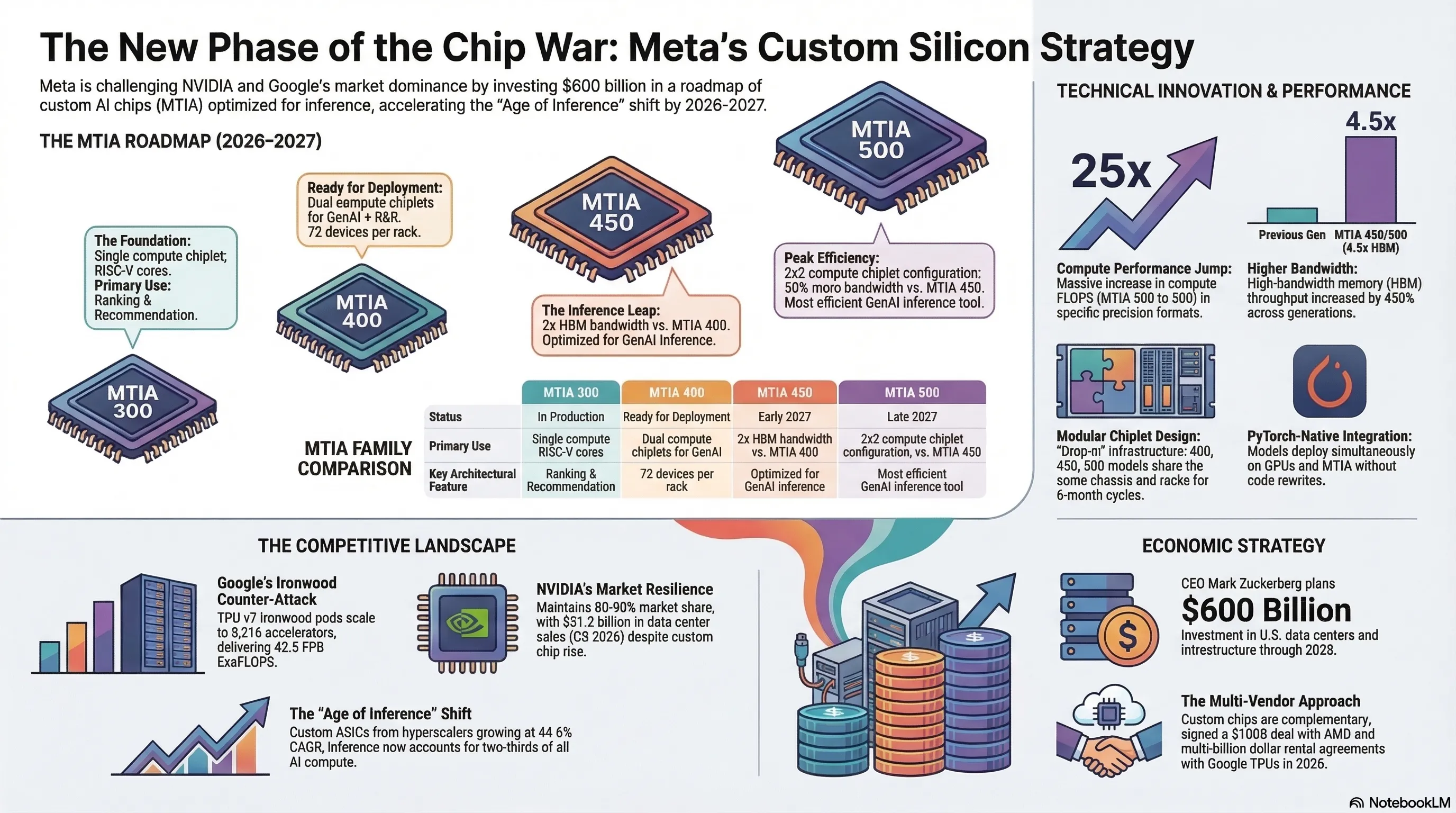

متا با رونمایی از ۴ تراشه اختصاصی MTIA در مارس ۲۰۲۶، به طور رسمی وارد نبرد بزرگ چیپهای هوش مصنوعی شده است. این تراشههای سری ۳۰۰ تا ۵۰۰ که در شراکت با برادکام ساخته شدهاند، ادعا میکنند عملکردی ۲۵ برابر بهتر و پهنای باند ۴.۵ برابر بیشتر نسبت به نسل اول ارائه میدهند. در همین حال، گوگل با TPU v7 Ironwood و انویدیا با معماری Blackwell به رقابت ادامه میدهند. این جنگ چیپها که بر روی بهینهسازی inference متمرکز شده، میتواند اقتصاد هوش مصنوعی را به کلی تغییر دهد.

مقدمه: آغاز عصر جدید در جنگ چیپها

صنعت نیمههادی در سال ۲۰۲۶ شاهد یکی از مهمترین تحولات تاریخ خود است. متا، غول شبکههای اجتماعی، با رونمایی از چهار تراشه اختصاصی هوش مصنوعی، به طور رسمی اعلام جنگ علیه انحصار انویدیا کرده است. این حرکت که همزمان با پیشرفتهای چشمگیر گوگل در زمینه TPU صورت گرفته، نشاندهنده ورود به فاز جدیدی از رقابت است که میتواند آینده محاسبات هوش مصنوعی را تعیین کند.

در ۱۱ مارس ۲۰۲۶، متا جزئیات کاملی از خانواده تراشههای MTIA (Meta Training and Inference Accelerator) منتشر کرد. این تراشهها که شامل مدلهای ۳۰۰، ۴۰۰، ۴۵۰ و ۵۰۰ میشوند، ادعا میکنند نه تنها با محصولات تجاری موجود رقابت کنند، بلکه در برخی موارد از آنها بهتر عمل کنند.

[IMAGE_PLACEHOLDER_2]معماری و مشخصات فنی تراشههای MTIA

MTIA 300: پایهگذار خانواده

تراشه MTIA 300 که هماکنون در حال تولید انبوه است، اولین نماینده خانواده تراشههای اختصاصی متا محسوب میشود. این چیپ که برای بارهای کاری ranking و recommendation بهینهسازی شده، شامل یک chiplet محاسباتی، دو chiplet شبکه و چندین stack حافظه HBM است.

هر chiplet محاسباتی از شبکهای از عناصر پردازشی (PE) تشکیل شده که برخی از آنها به منظور بهبود بازده تولید، اضافی در نظر گرفته شدهاند. هر PE شامل یک جفت هسته برداری RISC-V است که قابلیتهای پردازش پیشرفتهای را ارائه میدهد.

MTIA 400: ورود به رقابت جدی

MTIA 400 که به عنوان تکامل MTIA 300 معرفی شده، اولین تراشه متا است که ادعا میکند عملکرد خام آن با محصولات تجاری پیشرو قابل رقابت است. این تراشه از دو chiplet محاسباتی استفاده میکند و قابلیت پشتیبانی از مدلهای هوش مصنوعی تولیدی و بارهای کاری R&R را دارد.

یکی از ویژگیهای برجسته MTIA 400، قابلیت قرارگیری ۷۲ دستگاه در یک rack است که از طریق یک backplane سوئیچ شده به هم متصل میشوند و یک domain scale-up واحد را تشکیل میدهند. متا اعلام کرده که پس از اتمام مرحله تست، این تراشه "در مسیر استقرار در مراکز داده" قرار دارد.

| مدل | وضعیت | کاربرد اصلی | ویژگی کلیدی |

|---|---|---|---|

| MTIA 300 | در تولید | Ranking & Recommendation | یک chiplet محاسباتی |

| MTIA 400 | آماده استقرار | GenAI + R&R | دو chiplet محاسباتی |

| MTIA 450 | اوایل ۲۰۲۷ | GenAI Inference | دو برابر پهنای باند HBM |

| MTIA 500 | اواخر ۲۰۲۷ | Efficient GenAI | ۵۰٪ پهنای باند بیشتر |

MTIA 450: بهینهسازی برای inference

MTIA 450 که برای استقرار انبوه در اوایل ۲۰۲۷ برنامهریزی شده، با بهینهسازیهای خاص برای GenAI inference طراحی شده است. این تراشه پهنای باند HBM را نسبت به MTIA 400 دو برابر کرده که متا ادعا میکند عملکرد آن "بسیار بالاتر از محصولات تجاری پیشرو موجود" است.

MTIA 500: اوج کارایی

MTIA 500 که به عنوان کارآمدترین تراشه GenAI inference معرفی شده، پهنای باند HBM را ۵۰ درصد بیشتر از MTIA 450 افزایش میدهد. این تراشه از پیکربندی ۲×۲ chipletهای محاسباتی کوچکتر استفاده میکند که توسط چندین stack HBM و دو chiplet شبکه احاطه شدهاند.

علاوه بر این، MTIA 500 شامل یک chiplet SoC است که اتصال PCIe به CPU میزبان و NICهای scale-out را فراهم میکند. متا برنامه استقرار انبوه این تراشه را برای سال ۲۰۲۷ اعلام کرده است.

عملکرد و مقایسه با رقبا

ادعاهای عملکردی متا

متا ادعا میکند که از MTIA 300 تا 500، افزایش ۴.۵ برابری در throughput حافظه پرسرعت و جهش ۲۵ برابری در FLOPS محاسباتی (هنگام مقایسه فرمتهای دقت MX8 با MX4) حاصل شده است. MTIA 400 نسبت به 300، ۴۰۰ درصد FLOPS بالاتر FP8 و ۵۱ درصد پهنای باند HBM بیشتر ارائه میدهد.

مقایسه با گوگل TPU v7 Ironwood

در مقابل، گوگل با TPU v7 Ironwood که در نوامبر ۲۰۲۵ رونمایی شد، ادعاهای قدرتمندی دارد. هر تراشه Ironwood ۴,۶۱۴ تراflops قدرت محاسباتی FP8 ارائه میدهد که توسط ۱۹۲ گیگابایت حافظه HBM3e با سرعت ۷.۳ ترابایت بر ثانیه پشتیبانی میشود.

Ironwood pods میتوانند تا ۹,۲۱۶ شتابدهنده AI را در خود جای دهند و در مجموع ۴۲.۵ FP8 ExaFLOPS برای training و inference ارائه دهند. این رقم به مراتب از قابلیتهای سیستم GB300 NVL72 انویدیا که در ۰.۳۶ ExaFLOPS قرار دارد، فراتر میرود.

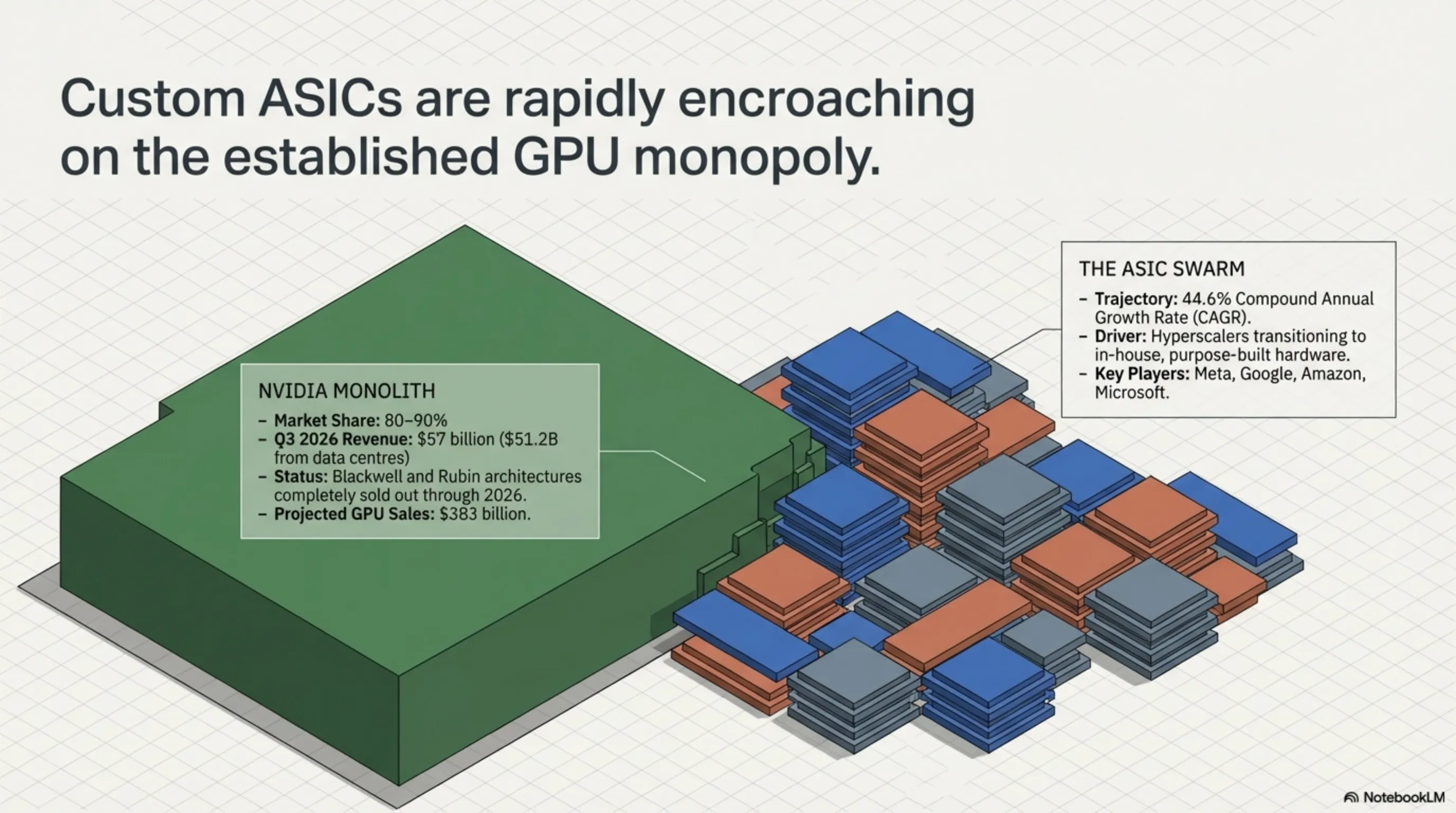

[IMAGE_PLACEHOLDER_5]موقعیت انویدیا

علیرغم رقابت شدید، انویدیا همچنان کنترل ۸۰ تا ۹۰ درصد بازار چیپهای AI را در دست دارد. اکوسیستم CUDA و معماری Blackwell همچنان مزیت رقابتی قوی برای این شرکت محسوب میشود. درآمد انویدیا در سهماهه سوم ۲۰۲۶ به ۵۷ میلیارد دلار رسید که ۵۱.۲ میلیارد دلار آن مربوط به فروش مراکز داده بود.

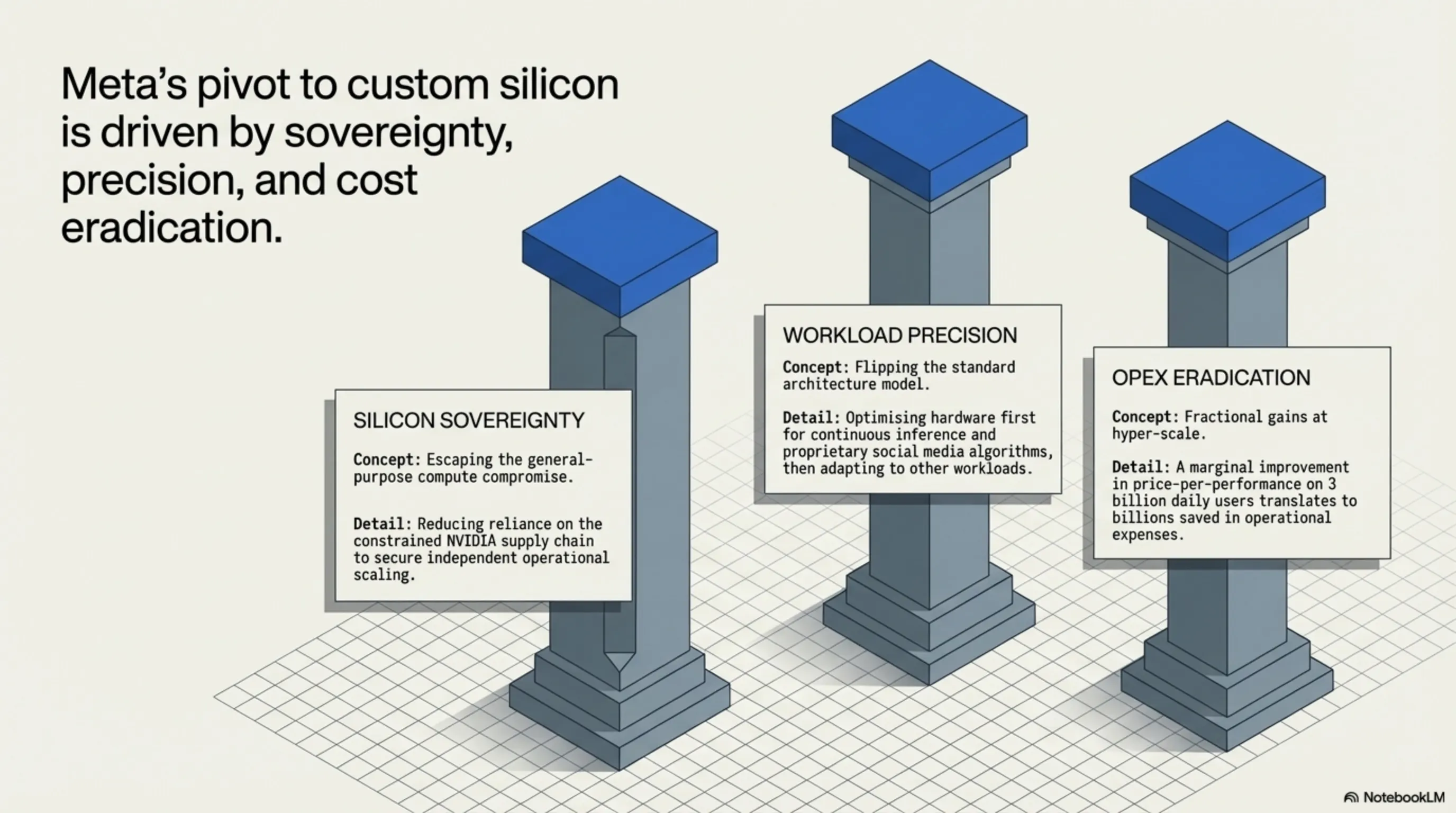

استراتژی متا: چرا تراشه اختصاصی؟

کاهش وابستگی به انویدیا

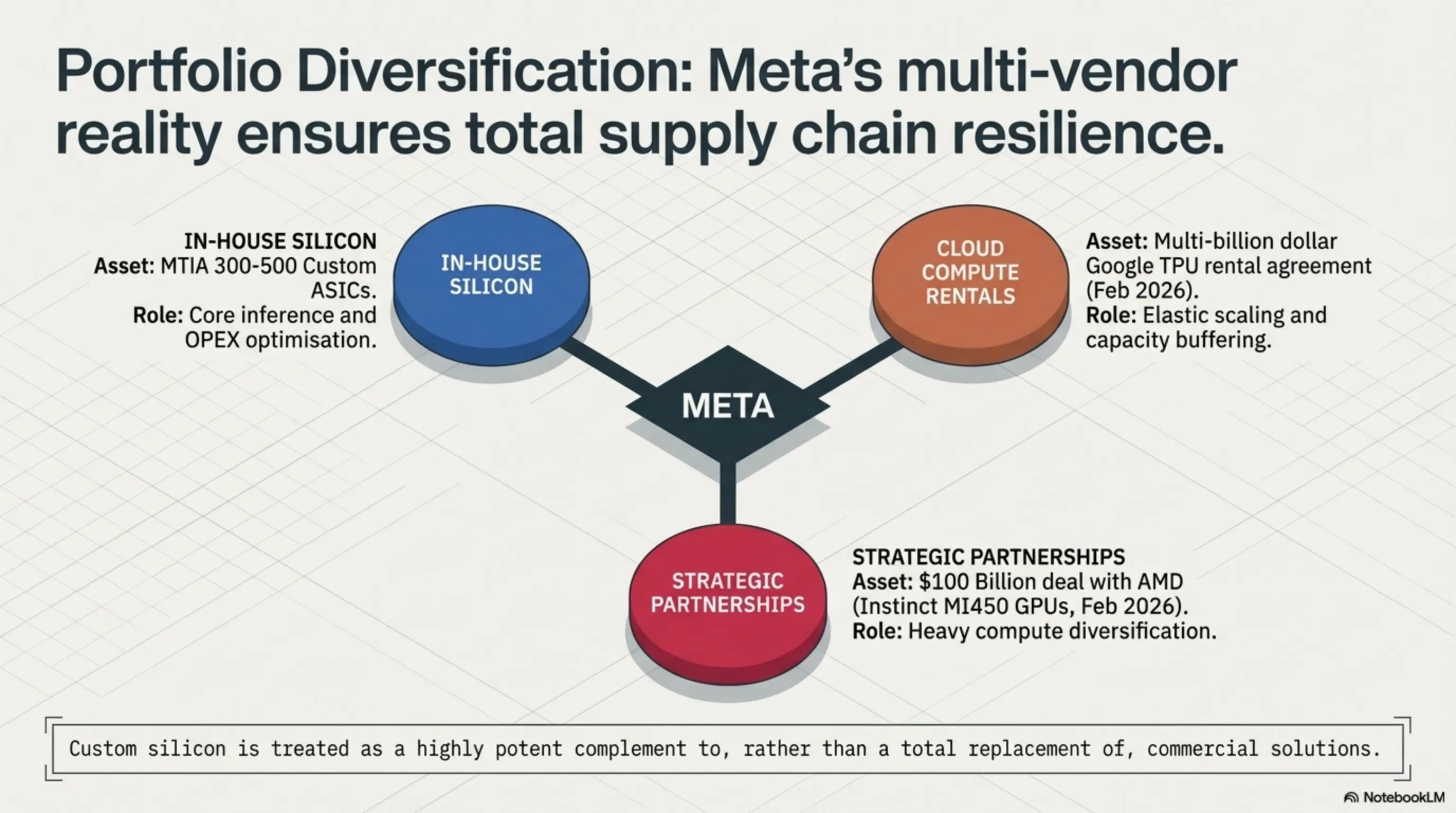

متا با توسعه تراشههای اختصاصی، هدف کاهش وابستگی به انویدیا و کنترل بیشتر بر زنجیره تأمین خود را دنبال میکند. این استراتژی که "تنوعبخشی پورتفولیو" نامیده میشود، به شرکت اجازه میدهد هزینههای عملیاتی را کاهش دهد و عملکرد را برای کاربردهای خاص بهینه کند.

تمرکز بر inference

برخلاف GPUهای عمومی که معمولاً برای demanding ترین بارهای کاری - یعنی pre-training مقیاس بزرگ GenAI - ساخته میشوند و سپس برای سایر بارهای کاری (اغلب با کارایی کمتر) استفاده میشوند، MTIA رویکرد معکوس را اتخاذ کرده است. این تراشهها ابتدا برای inference بهینهسازی شده و سپس برای سایر کاربردها تطبیق داده میشوند.

طراحی مدولار

طراحی chiplet مدولار به متا اجازه میدهد بدون بازطراحی کامل، اجزا را تعویض کند. MTIA 400، 450 و 500 همگی از chassis، rack و زیرساخت شبکه یکسانی استفاده میکنند - تراشههای جدید به سادگی در footprint موجود مراکز داده قرار میگیرند.

بافت اقتصادی و سرمایهگذاری

هزینههای کلان متا

اشتهای متا برای زیرساخت، حیرتانگیز است. مارک زاکربرگ، مدیرعامل شرکت، برنامههای خرج "حداقل ۶۰۰ میلیارد دلار" برای مراکز داده و زیرساخت آمریکا تا سال ۲۰۲۸ را اعلام کرده است. پیشبینیهای مخارج سرمایهای برای سال ۲۰۲۵ به تنهایی بین ۶۰ تا ۶۵ میلیارد دلار قرار دارد.

بهینهسازی هزینه

تراشه اختصاصی جایگزین این هزینهها نیست - بلکه آن را بهینه میکند. بهتر شدن نسبت قیمت به عملکرد در بارهای کاری inference میتواند تأثیر معناداری بر هزینههای عملیاتی داشته باشد، خاصه زمانی که شما recommendation های AI را برای بیش از ۳ میلیارد کاربر روزانه اجرا میکنید.

قراردادهای موازی

جالب اینکه متا همزمان با توسعه تراشههای اختصاصی، قراردادهای کلان با سایر تأمینکنندگان نیز امضا کرده است. در فوریه ۲۰۲۶، شرکت قراردادی ۱۰۰ میلیارد دلاری با AMD برای GPUهای سفارشی Instinct MI450 امضا کرد. همچنین در ۲۶ فوریه ۲۰۲۶، قراردادی چندمیلیارد دلاری با گوگل برای اجاره TPUها منعقد کرد.

[IMAGE_PLACEHOLDER_7]آینده صنعت و پیشبینیها

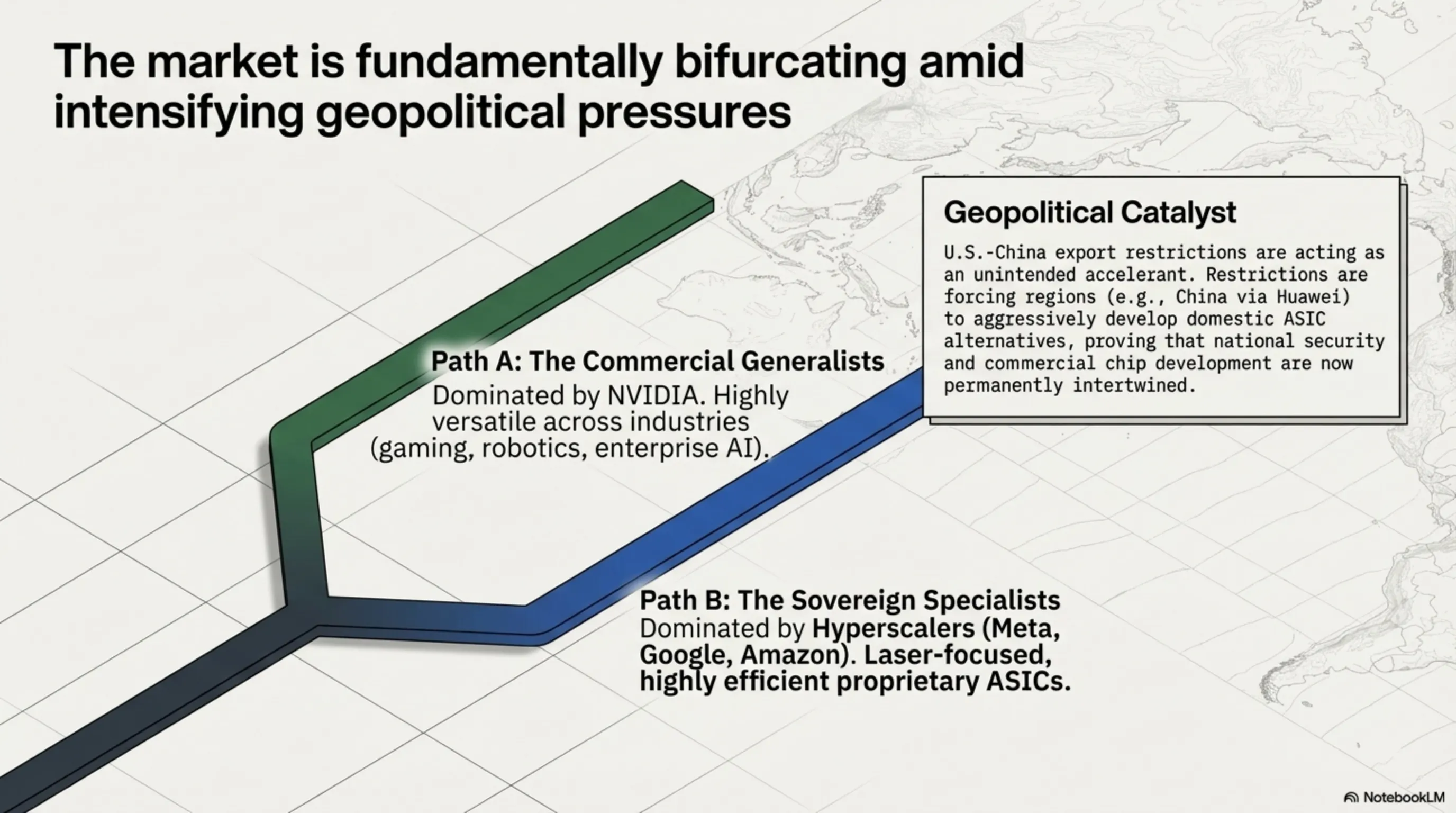

تحول بنیادین

انقلاب AI در حال تغییر شکل چشمانداز فناوری با سرعت سرسامآوری است و هیچ جا این موضوع واضحتر از صنعت نیمههادی نیست. انویدیا مدتها رهبر بلامنازع سختافزار AI بوده و همه چیز از cloud computing تا خودروهای خودران را با GPUهای پیشرفته خود تقویت کرده است.

ظهور عصر inference

برخلاف نسلهای قبلی که عمدتاً برای training مدلهای عظیم طراحی شده بودند، Ironwood و MTIA برای "عصر inference" ساخته شدهاند - دورانی که مدلهای AI نه تنها ساخته میشوند، بلکه به طور فعال میلیونها کاربر را در زمان واقعی هر روز سرویس میدهند.

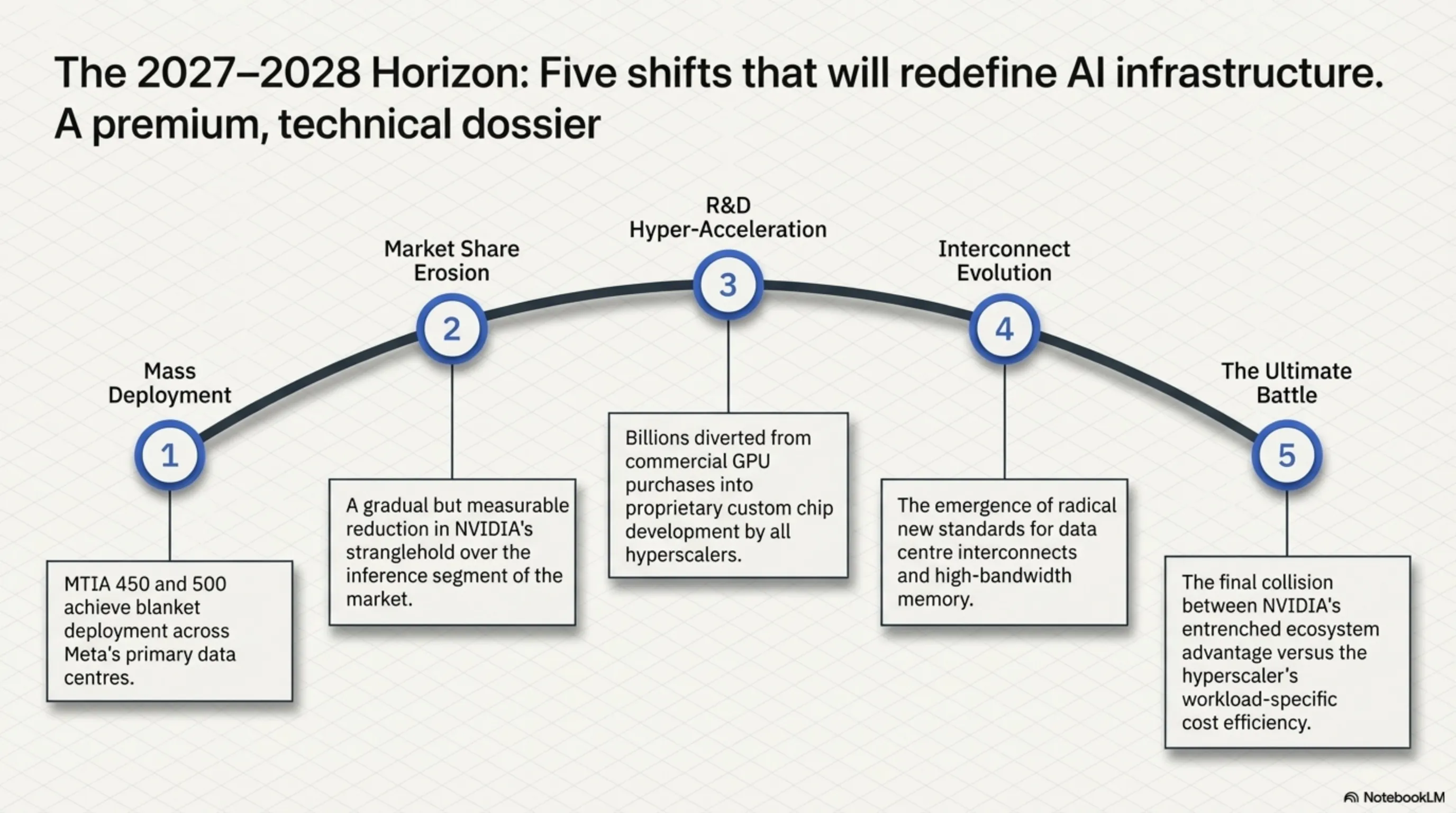

پیشبینیهای ۲۰۲۷-۲۰۲۸

- استقرار انبوه MTIA 450 و 500 در مراکز داده متا

- رقابت شدیدتر بین تراشههای سفارشی و GPUهای عمومی

- کاهش تدریجی سهم بازار انویدیا در بخش inference

- افزایش سرمایهگذاری در R&D تراشههای اختصاصی

- ظهور استانداردهای جدید برای interconnect و memory

🎯 نتیجهگیری

جنگ چیپهای AI با ورود متا به میدان، وارد فاز حساسی شده است. چهار تراشه MTIA نه تنها نشاندهنده تلاش متا برای کاهش وابستگی به انویدیا هستند، بلکه نماد تحولی بنیادین در صنعت نیمههادی محسوب میشوند. رقابت بین متا، گوگل و انویدیا در نهایت به نفع کاربران نهایی خواهد بود که شاهد بهبود عملکرد، کاهش هزینهها و نوآوریهای بیشتر خواهند بود. آینده به آن شرکتی تعلق خواهد داشت که بتواند تعادل مناسبی بین عملکرد، کارایی انرژی و مقرونبهصرفه بودن برقرار کند.