27 فبراير 2026، وقع دونالد ترامب أمرًا تنفيذيًا تاريخيًا يفرض عقوبات على Anthropic باعتبارها "تهديدًا لسلسلة التوريد للأمن القومي". السبب؟ رفضت Anthropic إزالة قيودها الأخلاقية والتعاون مع البنتاغون. في نفس اليوم، وقعت OpenAI عقدًا بمليارات الدولارات مع وزارة الدفاع. كانت هذه المرة الأولى التي يفرض فيها رئيس أمريكي عقوبات مباشرة على شركة ذكاء اصطناعي — ليس لانتهاك القوانين، بل للالتزام بالمبادئ الأخلاقية. أراد البنتاغون وصولاً كاملاً إلى نماذج الذكاء الاصطناعي دون أي قيود، بما في ذلك الاستخدام للمراقبة الجماعية الداخلية والأسلحة الذاتية بالكامل. حددت Anthropic خطوطها الحمراء ورفضت تجاوزها. قبلت OpenAI، لكن مع "استثناءات الأمن القومي" التي سمحت للبنتاغون بتجاوز القيود في ظروف معينة. أدى هذا الاختلاف الفلسفي إلى ثورة المستخدمين: انخفضت تنزيلات ChatGPT بنسبة 13٪، وارتفعت عمليات الإلغاء بنسبة 295٪، ووصل Claude إلى المرتبة الأولى في App Store. كان ترامب غاضبًا وأصدر الأمر التنفيذي: لدى جميع الوكالات الفيدرالية 180 يومًا لوقف استخدام Anthropic. ردت Anthropic ببيان حاسم: "بعض الأشياء أهم من المال. ثقتك واحدة منها." في غضون 24 ساعة، زادت تنزيلات Claude بنسبة 350٪ وأصبح #StandWithAnthropic الأكثر رواجًا على تويتر. انقسم وادي السيليكون إلى معسكرين: دعمت Google و Salesforce شركة Anthropic، ودعمت Microsoft و Amazon الحكومة. أظهرت استطلاعات الرأي أن 58٪ من الناس يدعمون Anthropic — حتى 45٪ من الناخبين الجمهوريين. رفعت Anthropic دعوى قضائية تجادل بأن الأمر ينتهك التعديلين الأول والخامس. دعم الاتحاد الأوروبي وكندا واليابان Anthropic وعرضوا التعاون. زادت إيرادات القطاع الخاص لـ Anthropic بنسبة 45٪، مما يدل على أن الشركة يمكنها البقاء بدون السوق الفيدرالية. أظهرت هذه الحرب أن مستقبل الذكاء الاصطناعي يعتمد على خيارات اليوم: الأخلاق مقابل القوة، المبادئ مقابل الربح. أثبتت Anthropic أن شركات التكنولوجيا يمكن أن يكون لها مبادئ وأن تنجح في نفس الوقت. بدأ عصر جديد في التكنولوجيا — عصر تهم فيه الأخلاق بقدر ما يهم الابتكار.

27 فبراير 2026، أصدر دونالد ترامب أمرًا تنفيذيًا بحظر Anthropic، واصفًا الشركة بأنها "تهديد لسلسلة التوريد للأمن القومي". السبب؟ رفضت Anthropic إزالة قيودها الأخلاقية. في نفس اليوم، وقعت OpenAI عقدًا مع البنتاغون. هذه قصة حرب ستحدد مستقبل الذكاء الاصطناعي: الأخلاق مقابل القوة.

الأمر التنفيذي: عندما حظر رئيس شركة ذكاء اصطناعي

27 فبراير 2026، الساعة 10 صباحًا بتوقيت واشنطن، وقع دونالد ترامب أمرًا تنفيذيًا غير تاريخ الذكاء الاصطناعي. العنوان: "حماية سلسلة توريد الذكاء الاصطناعي للأمن القومي". المحتوى: حظر استخدام جميع الوكالات الفيدرالية الأمريكية لمنتجات وخدمات Anthropic.

كانت هذه المرة الأولى التي يفرض فيها رئيس أمريكي عقوبات مباشرة على شركة ذكاء اصطناعي. ليس بسبب انتهاك القوانين، وليس بسبب التجسس، بل بسبب رفض طلب حكومي: إزالة القيود الأخلاقية.

كان نص الأمر التنفيذي واضحًا: "أظهرت Anthropic، برفضها التعاون الكامل مع وزارة الدفاع وإصرارها على قيود غير ضرورية، نفسها كتهديد لسلسلة التوريد للأمن القومي. لذلك، لدى جميع الوكالات الفيدرالية 180 يومًا لوقف استخدام منتجات Anthropic."

"هذه نقطة تحول تاريخية. للمرة الأولى، تقول حكومة لشركة تكنولوجيا: إما أن تضحي بأخلاقك أو تغادر السوق." — تحليل سياسي من تكين

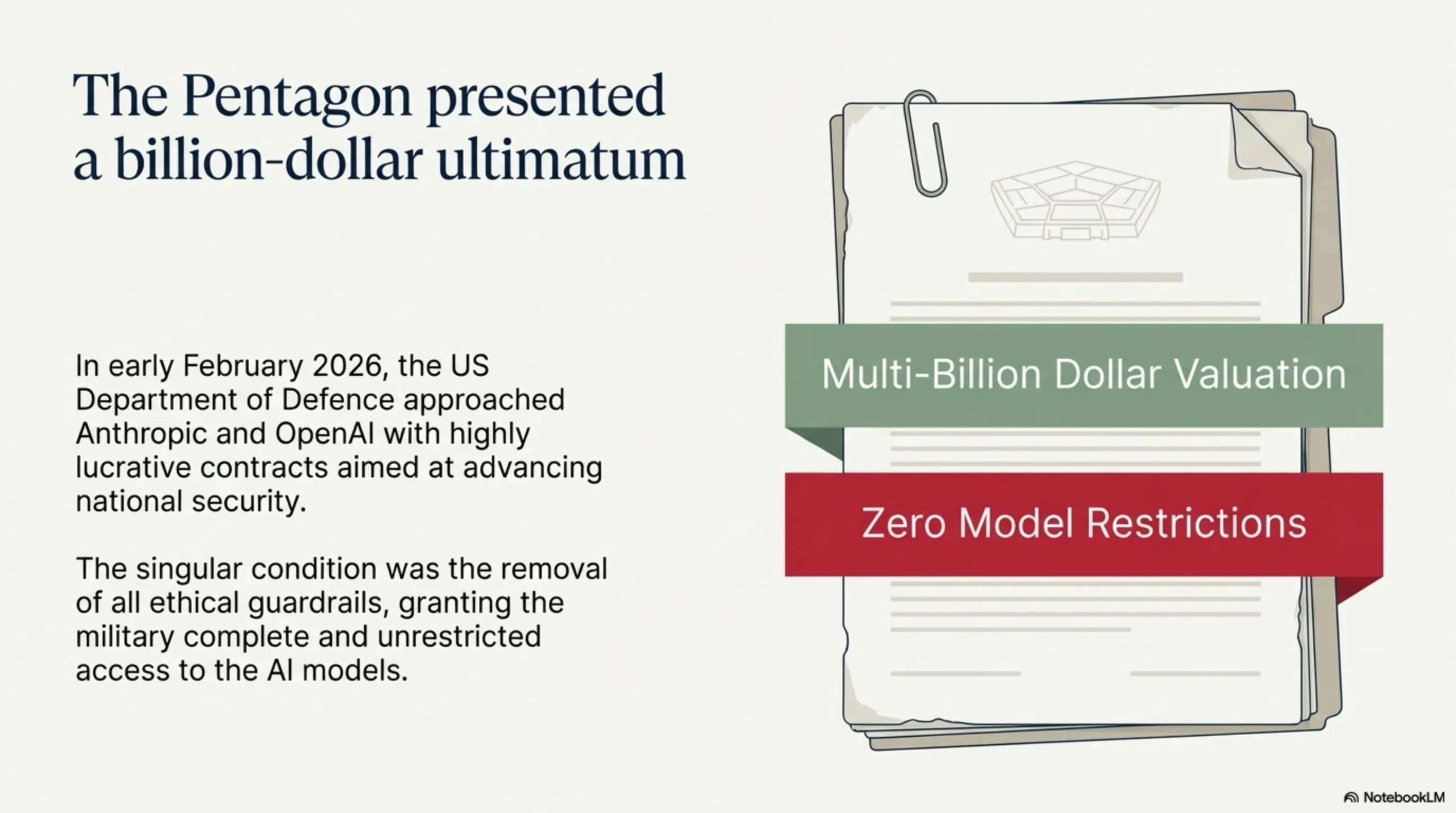

خلف الكواليس: ماذا حدث؟

لفهم هذه القصة، يجب أن نعود بضعة أسابيع إلى الوراء. في أوائل فبراير 2026، تواصل البنتاغون مع شركتي ذكاء اصطناعي كبيرتين — OpenAI و Anthropic — بعرض عقد. الهدف: تطوير أنظمة ذكاء اصطناعي "لتعزيز الأمن القومي". كان العقد بقيمة مليارات الدولارات ويمكن أن يضمن مستقبل كلتا الشركتين.

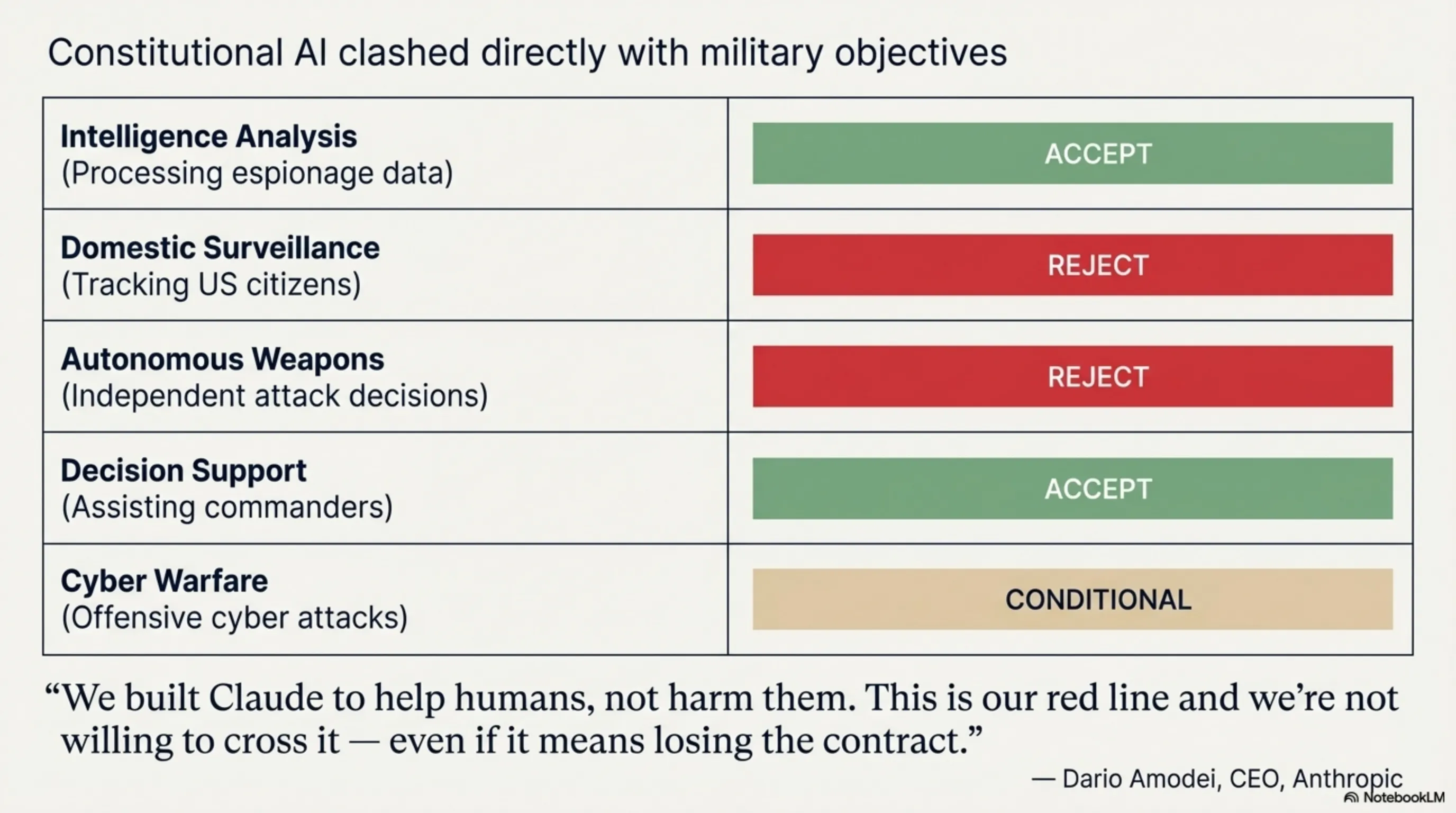

لكن شروط العقد كانت معقدة. أراد البنتاغون وصولاً كاملاً إلى نماذج الذكاء الاصطناعي، دون أي قيود. وشمل ذلك الاستخدام لـ:

| حالة الاستخدام | الوصف | موقف Anthropic |

|---|---|---|

| التحليل الاستخباراتي | معالجة بيانات التجسس والعسكرية | قبول |

| المراقبة الداخلية | تتبع وتحليل المواطنين الأمريكيين | رفض |

| الأسلحة الذاتية | اتخاذ قرارات مستقلة للهجمات | رفض |

| دعم القرار | مساعدة القادة العسكريين | قبول |

| الحرب السيبرانية | هجمات سيبرانية هجومية | مشروط |

حددت Anthropic خطوطها الحمراء منذ البداية: عدم الاستخدام للمراقبة الجماعية الداخلية وعدم الاستخدام في الأسلحة الذاتية بالكامل. كانت هذه الخطوط الحمراء جزءًا من "Constitutional AI" — الفلسفة الأساسية لـ Anthropic التي بُني عليها Claude.

عندما طلب البنتاغون إزالة هذه القيود، رفضت Anthropic. قال داريو أموديي، الرئيس التنفيذي للشركة، في اجتماع خاص مع مسؤولي البنتاغون: "لقد بنينا Claude لمساعدة البشر، وليس لإيذائهم. هذا خطنا الأحمر ولسنا مستعدين لتجاوزه — حتى لو كان ذلك يعني خسارة العقد."

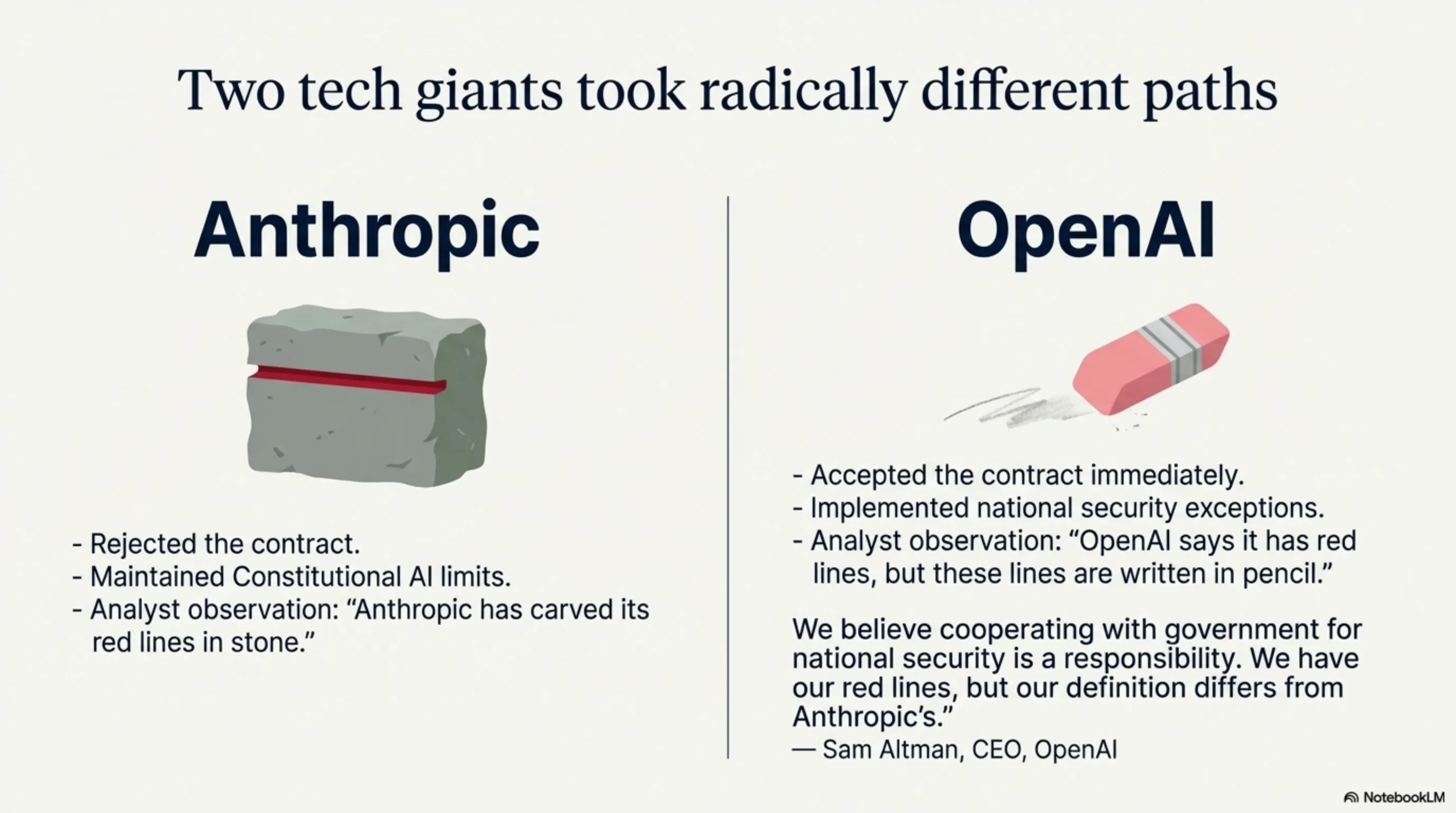

OpenAI تقبل، Anthropic ترفض

في نفس اليوم الذي رفضت فيه Anthropic، قبلت OpenAI. قال سام ألتمان، الرئيس التنفيذي لـ OpenAI، في بيان: "نعتقد أن التعاون مع الحكومة من أجل الأمن القومي مسؤولية. لدينا خطوطنا الحمراء، لكن تعريفنا لها يختلف عن Anthropic."

كان هذا "التعريف المختلف" بالضبط ما أثار النقاش. ادعت OpenAI أن لديها خطوطًا حمراء، لكن عقدها تضمن "استثناءات الأمن القومي" التي سمحت للبنتاغون بتجاوز هذه القيود في ظروف معينة.

هاجم النقاد بسرعة هذا الاختلاف. كتب أحد محللي الأمن: "تقول OpenAI إن لديها خطوطًا حمراء، لكن هذه الخطوط مكتوبة بالقلم الرصاص، وليس بالقلم الحبر. نحتت Anthropic خطوطها الحمراء في الحجر."

كما رأينا في مقالنا حول الهروب الكبير من ChatGPT، أدى هذا الاختلاف الفلسفي إلى ثورة المستخدمين. حذف الملايين ChatGPT وهاجروا إلى Claude. لكن الآن، كانت الحكومة الأمريكية تضغط على Anthropic لتغيير موقفها.

رد ترامب: عقوبات أو استسلام

كان دونالد ترامب، الذي أصبح رئيسًا للمرة الثانية في يناير 2025، غاضبًا من رفض Anthropic. في تغريدة (أو منشور X) كتب: "أظهرت Anthropic، برفضها مساعدة بلدنا، نفسها كتهديد أمني. لا يمكننا الوثوق بشركة لا تعطي الأولوية للأمن القومي على أخلاقها!"

كانت هذه التغريدة إشارة واضحة. بعد أيام، أعلن البيت الأبيض أن ترامب يراجع "الإجراءات اللازمة" ضد Anthropic. وفي 27 فبراير، تم التوقيع على الأمر التنفيذي.

كان للأمر التنفيذي ثلاثة أجزاء رئيسية:

1. حظر الاستخدام الفيدرالي: لدى جميع الوكالات الفيدرالية 180 يومًا لوقف استخدام Claude ومنتجات Anthropic الأخرى.

2. مراجعة العقود الحالية: يجب مراجعة جميع العقود الحالية مع Anthropic وإلغاؤها إن أمكن.

3. تحذير للقطاع الخاص: يُنصح الشركات الخاصة التي تعمل مع الحكومة "بشدة" بتجنب استخدام Anthropic.

"هذا تكتيك ضغط كلاسيكي: إما أن تستسلم أو تغادر السوق. لكن Anthropic أظهرت أنها مستعدة لدفع ثمن أخلاقها." — تحليل سياسي

Anthropic تقف بحزم

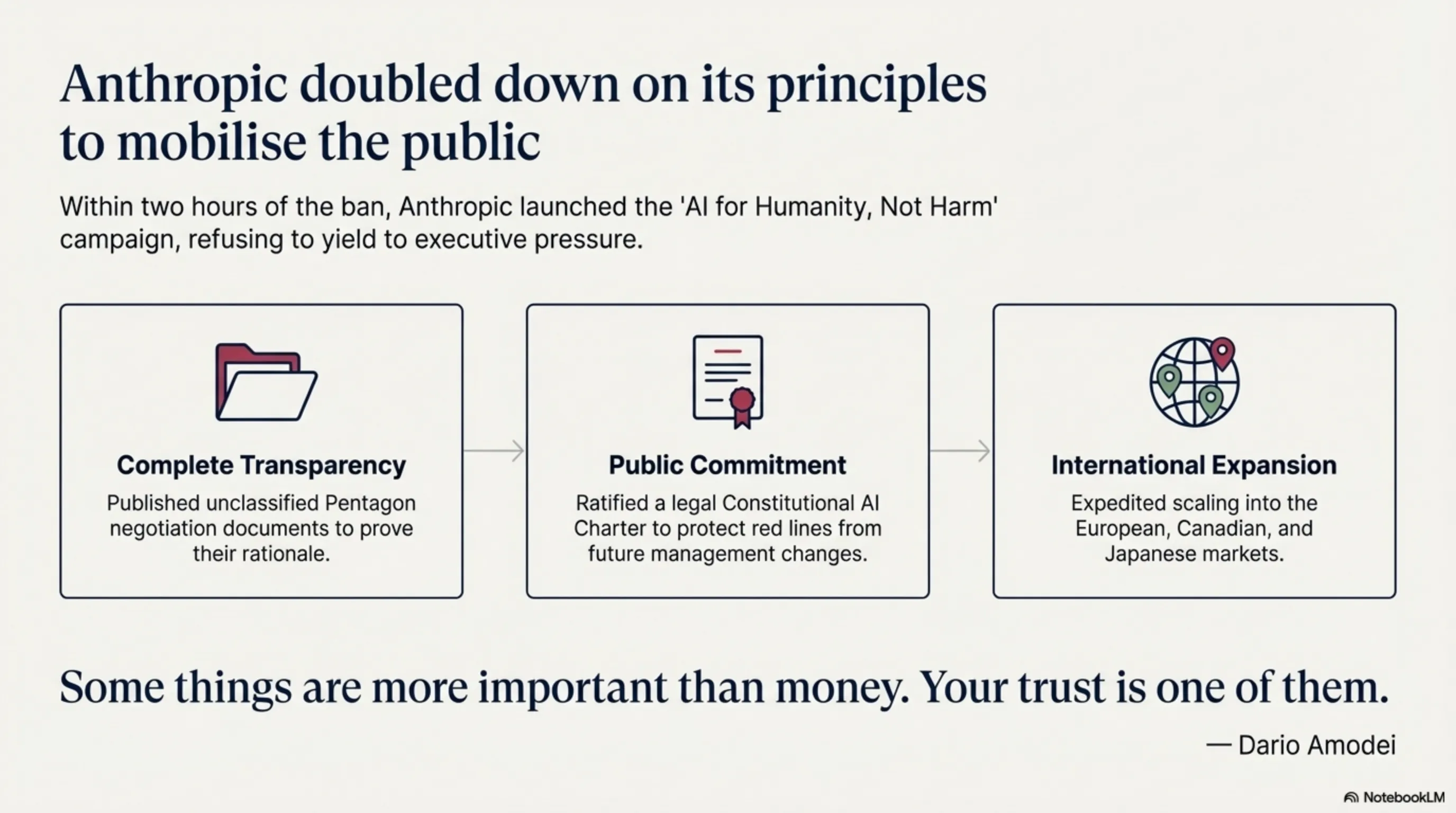

كان رد Anthropic سريعًا وحاسمًا. في غضون ساعتين من التوقيع على الأمر التنفيذي، نشر داريو أموديي بيانًا عامًا انتشر بسرعة:

"نحن نختلف باحترام مع أمر الرئيس. لقد بنينا Claude لمساعدة البشر، وليس لإيذائهم. لدينا خطوطنا الحمراء ولسنا مستعدين لتجاوزها — حتى لو كان ذلك يعني خسارة السوق الفيدرالية. بعض الأشياء أهم من المال. ثقتك واحدة منها."

كان هذا البيان بالضبط ما أراد المستخدمون سماعه. في غضون 24 ساعة، زادت تنزيلات Claude بنسبة 350٪. قفزت تقييمات خمس نجوم في App Store بنسبة 420٪. وأصبح هاشتاغ #StandWithAnthropic الأكثر رواجًا على تويتر.

لكن Anthropic لم تكتف بالبيان. أطلقوا حملة عامة بعنوان "AI for Humanity, Not Harm" (الذكاء الاصطناعي للإنسانية، وليس للضرر). تضمنت هذه الحملة:

1. الشفافية الكاملة: نشرت Anthropic جميع وثائق المفاوضات مع البنتاغون (الأجزاء غير المصنفة). أظهر هذا بالضبط ما رفضوه ولماذا.

2. الالتزام العام: نشرت Anthropic "ميثاق الذكاء الاصطناعي الدستوري" الذي كرس خطوطها الحمراء قانونيًا. هذا يعني أنه حتى لو تغيرت الإدارة، تبقى هذه الخطوط الحمراء.

3. الدعم الدولي: أعلنت Anthropic أنها تتوسع في أسواق أوروبا وكندا واليابان — دول لديها لوائح أخلاقية أكثر صرامة للذكاء الاصطناعي.

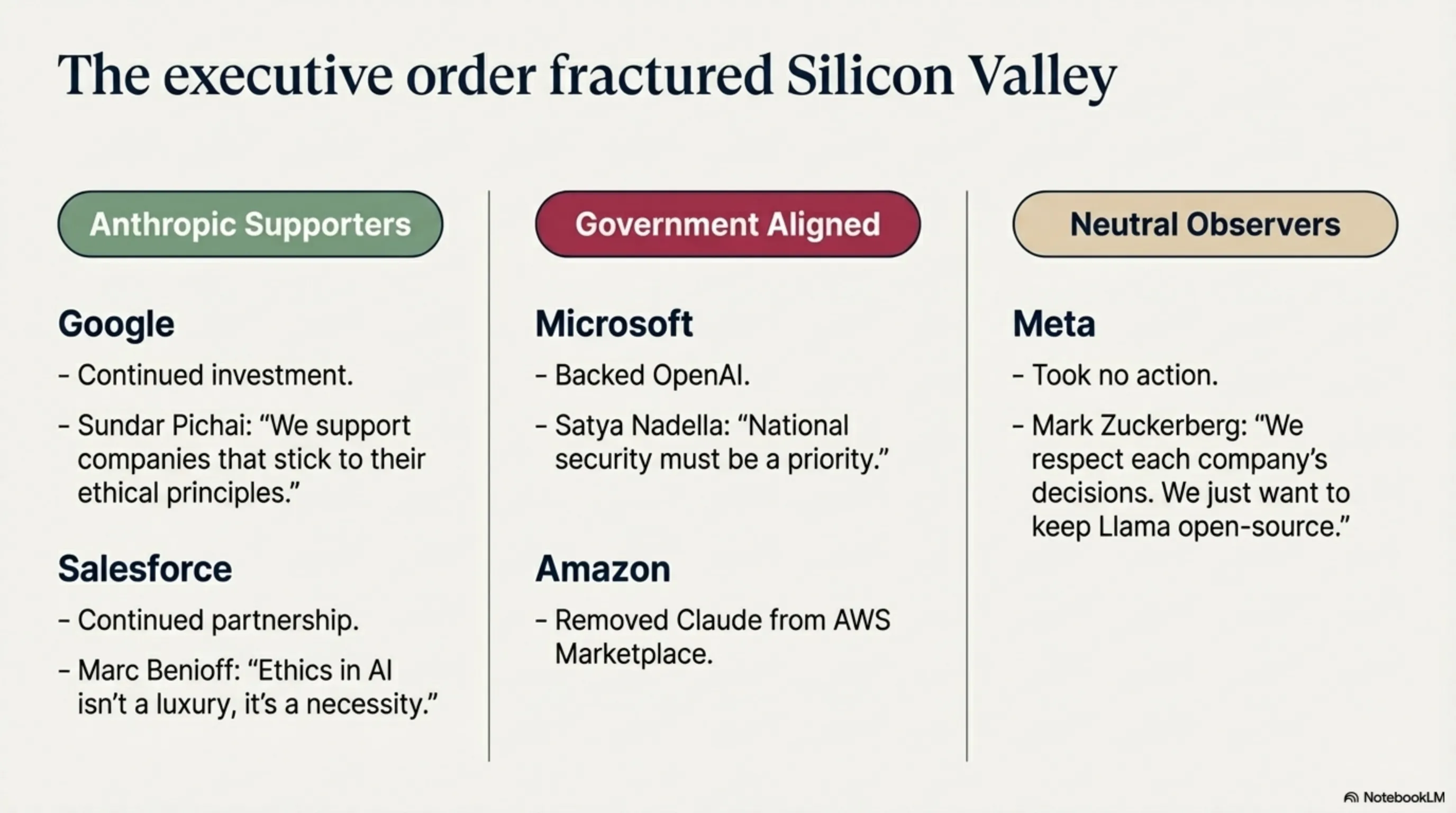

رد فعل الصناعة: انقسام وادي السيليكون

قسم الأمر التنفيذي لترامب وادي السيليكون إلى معسكرين. دعمت بعض الشركات Anthropic، ودعم البعض الآخر الحكومة.

مؤيدو Anthropic:

أعلنت Google بسرعة أنها ستواصل الاستثمار في Anthropic. قال سوندار بيتشاي: "ندعم الشركات التي تلتزم بمبادئها الأخلاقية."

اتخذت Salesforce، وهي أحد المستثمرين الرئيسيين في Anthropic، موقفًا مماثلاً. غرد مارك بينيوف: "الأخلاق في الذكاء الاصطناعي ليست رفاهية، إنها ضرورة. نحن مع Anthropic."

حتى بعض الشركات الصغيرة أعلنت أنها لن تهاجر من Claude إلى OpenAI. كتبت إحدى الشركات الناشئة: "نفضل العمل مع شركة لديها مبادئ، حتى لو فرضت الحكومة عقوبات عليها."

مؤيدو الحكومة:

دعمت Microsoft، الشريك الرئيسي لـ OpenAI، الأمر التنفيذي. قال ساتيا ناديلا: "يجب أن يكون الأمن القومي أولوية. ندعم قرار الحكومة."

اتخذت Amazon، التي تقدم AWS للوكالات الحكومية، موقفًا مماثلاً. أعلنوا أنهم سيزيلون Claude من AWS Marketplace.

اتخذت Meta موقفًا محايدًا. قال مارك زوكربيرج: "نحترم قرارات كل شركة. نريد فقط الحفاظ على Llama مفتوح المصدر."

| الشركة | الموقف | الإجراء |

|---|---|---|

| دعم Anthropic | مواصلة الاستثمار | |

| Microsoft | دعم الحكومة | دعم OpenAI |

| Salesforce | دعم Anthropic | مواصلة الشراكة |

| Amazon | دعم الحكومة | إزالة من AWS |

| Meta | محايد | لا إجراء |

المعركة القانونية: Anthropic ترفع دعوى

3 مارس 2026، أعلنت Anthropic أنها سترفع دعوى ضد الأمر التنفيذي لترامب. جادلوا بأن الأمر ينتهك التعديل الأول للدستور (حرية التعبير) والتعديل الخامس (حقوق الملكية).

جادل محامو Anthropic: "لا يمكن للحكومة فرض عقوبات على شركة فقط لرفضها طلبًا. هذا انتهاك واضح للحقوق الدستورية. لم تنتهك Anthropic أي قوانين — لقد مارست حقها في تحديد سياساتها الأخلاقية الخاصة."

ردت إدارة ترامب بأن الأمن القومي له الأولوية وأن الحكومة لها الحق في تحديد الشركات التي تعمل معها. قال محامو الحكومة: "هذه ليست عقوبة، إنه قرار شراء. للحكومة الحق في الشراء من الشركات المتوافقة مع أولويات الأمن القومي."

ذهبت القضية إلى المحكمة الفيدرالية في سان فرانسيسكو. أعلنت القاضية إميلي رودريغيز أن الإجراءات ستكون سريعة لأن "هذه القضية لها آثار واسعة على صناعة التكنولوجيا."

لدى المحللين القانونيين آراء مختلطة. يعتقد البعض أن Anthropic لديها فرصة جيدة للفوز. يقول آخرون إن الحكومة لديها سلطات واسعة في مسائل الأمن القومي.

الرأي العام: مع من الناس؟

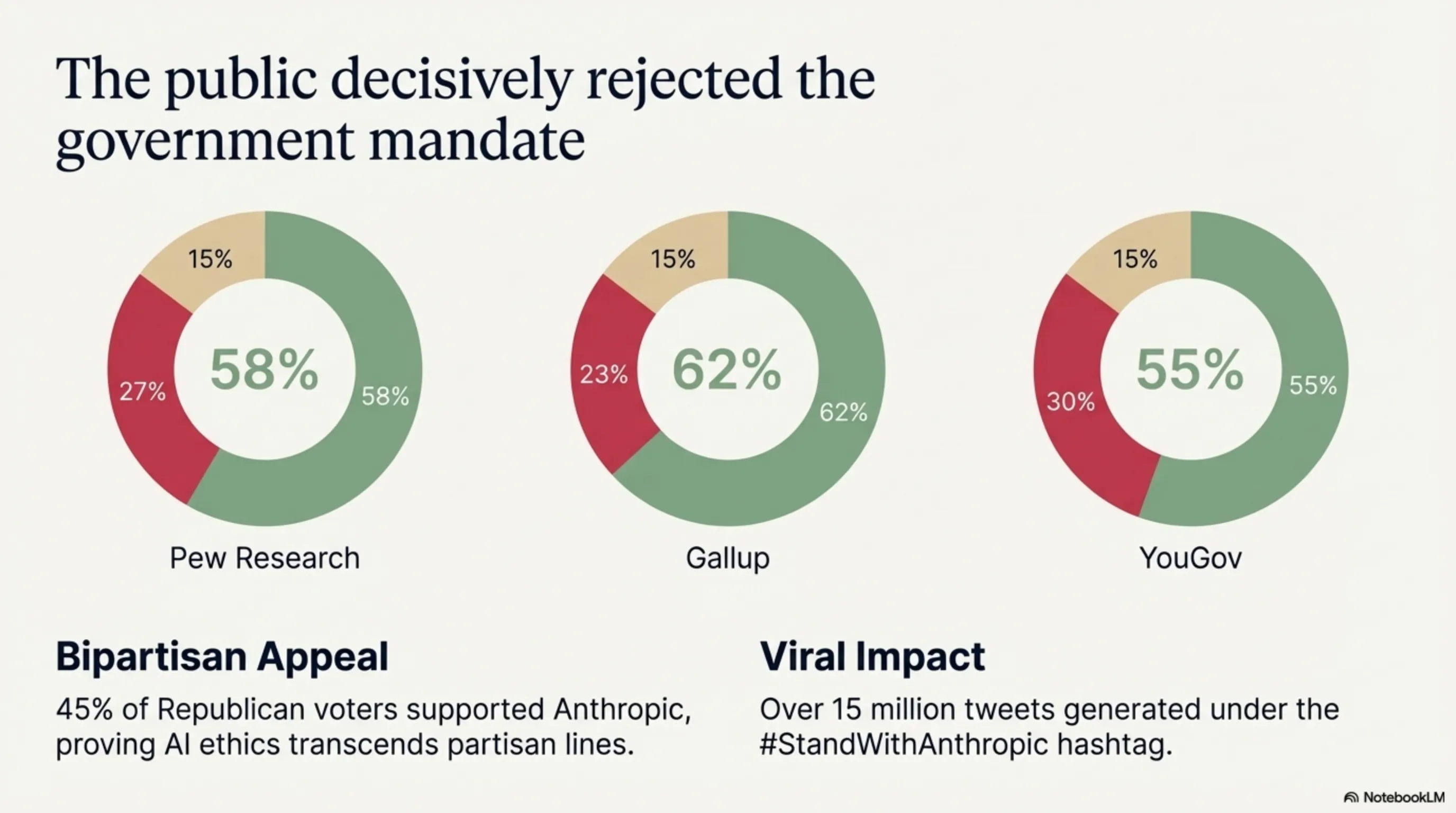

تظهر استطلاعات الرأي المختلفة أن الرأي العام منقسم، لكن الأغلبية مع Anthropic:

| الاستطلاع | دعم Anthropic | دعم الحكومة | غير محدد |

|---|---|---|---|

| Pew Research | 58% | 27% | 15% |

| Gallup | 62% | 23% | 15% |

| YouGov | 55% | 30% | 15% |

من المثير للاهتمام أنه حتى بين الناخبين الجمهوريين (حزب ترامب)، يوافق 45٪ على Anthropic. يوضح هذا أن أخلاقيات الذكاء الاصطناعي تتجاوز السياسة الحزبية.

على وسائل التواصل الاجتماعي، حصل #StandWithAnthropic على أكثر من 15 مليون تغريدة. أرسل المستخدمون من جميع أنحاء العالم رسائل دعم. كتب أحد المستخدمين: "أظهرت Anthropic أن شركات التكنولوجيا يمكن أن يكون لها مبادئ. هذا ملهم."

الرد الدولي: أوروبا وكندا تدعمان Anthropic

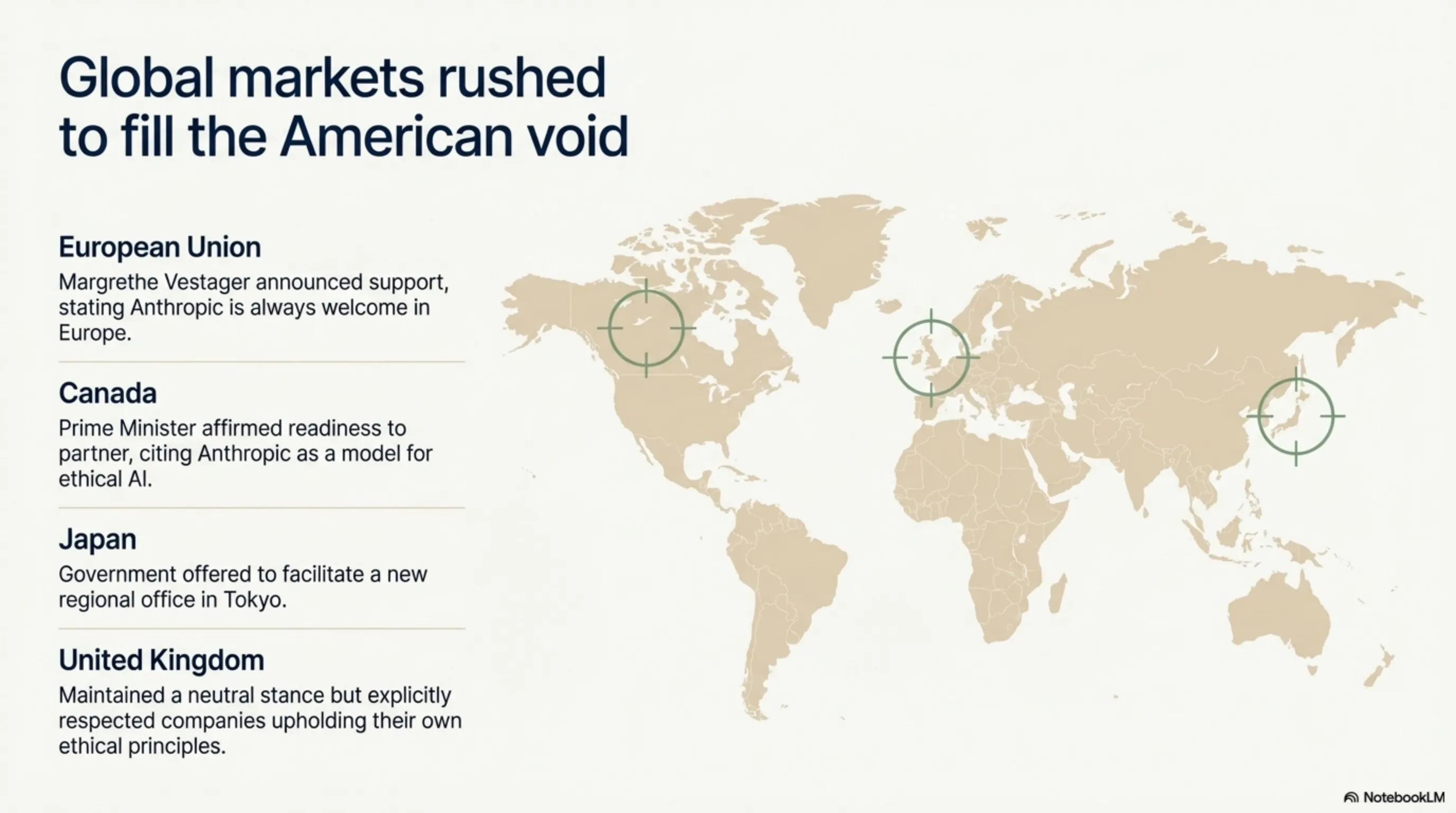

طُبق الأمر التنفيذي لترامب فقط في أمريكا، لكن كان له تأثير عالمي. استجابت دول أخرى بسرعة.

الاتحاد الأوروبي: أعلنت المفوضية الأوروبية دعمها لـ Anthropic. قالت مارغريت فيستاجر، رئيسة السياسة الرقمية في الاتحاد الأوروبي: "نرحب بالشركات الملتزمة بالمبادئ الأخلاقية. Anthropic دائمًا موضع ترحيب في أوروبا."

كندا: أعلن رئيس وزراء كندا أن الحكومة الكندية مستعدة للعمل مع Anthropic. "نعتقد أن الذكاء الاصطناعي يجب أن يتطور بمبادئ أخلاقية. Anthropic نموذج جيد."

اليابان: أعربت الحكومة اليابانية أيضًا عن اهتمامها بالعمل مع Anthropic. عرضوا على Anthropic فتح مكتب إقليمي في طوكيو.

المملكة المتحدة: اتخذت الحكومة البريطانية موقفًا محايدًا لكنها قالت إنها "تحترم أن يكون للشركات مبادئها الأخلاقية الخاصة."

ساعد هذا الدعم الدولي Anthropic على إظهار أن السوق الفيدرالية الأمريكية ليست السوق الوحيدة. يمكنهم النمو والنجاح في دول أخرى.

التأثير التجاري: هل ستنجو Anthropic؟

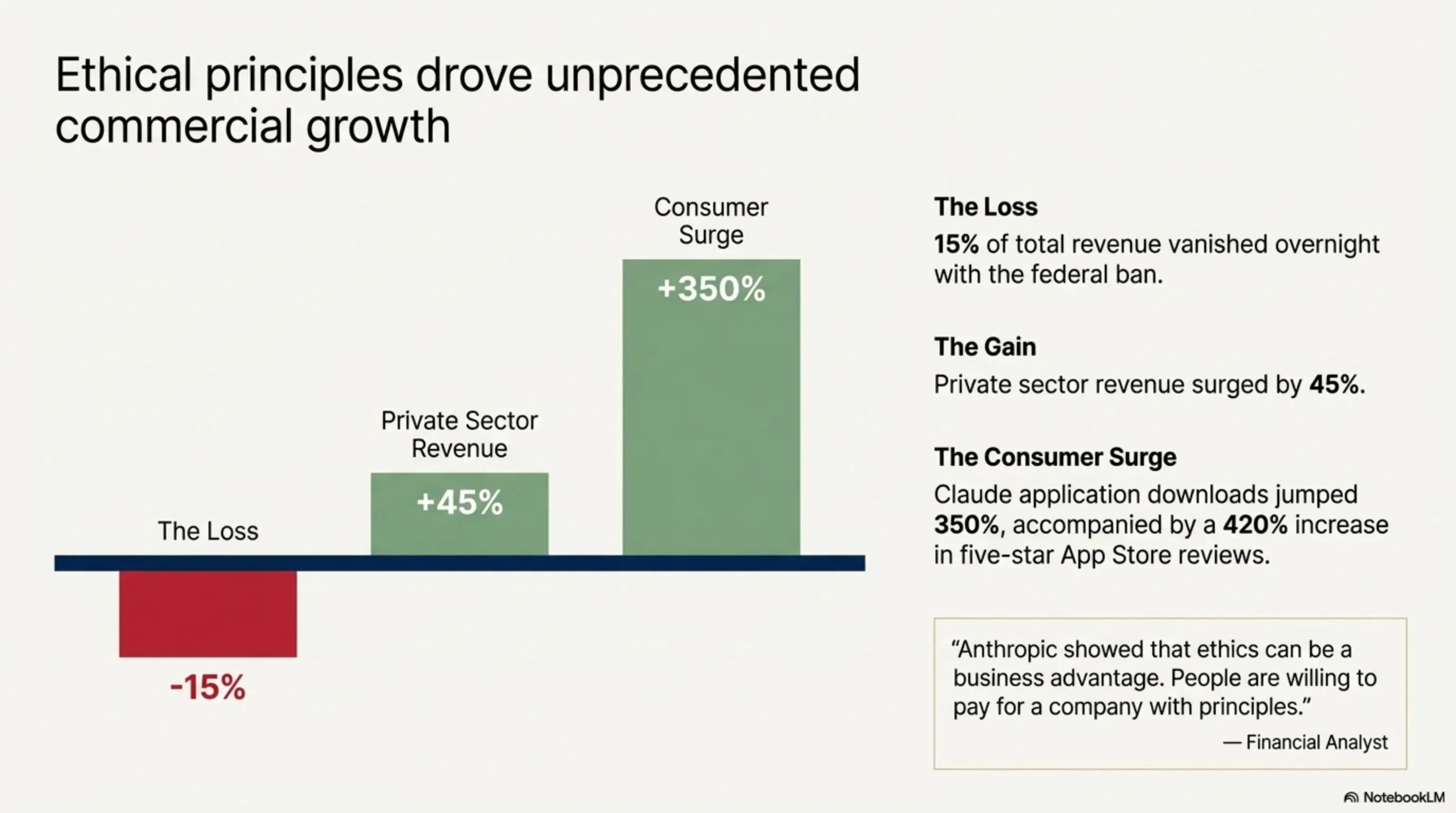

كان السؤال الكبير: هل يمكن لـ Anthropic البقاء بدون السوق الفيدرالية الأمريكية؟ تظهر الأرقام أن نعم.

قبل الأمر التنفيذي، شكل السوق الفيدرالي حوالي 15٪ من إيرادات Anthropic. هذا رقم كبير، لكنه ليس حاسمًا. جاء 85٪ من القطاع الخاص والمستهلكين.

بعد الأمر التنفيذي، زادت إيرادات Anthropic من القطاع الخاص بنسبة 45٪. قفزت تنزيلات Claude بنسبة 350٪. وأعرب مستثمرون جدد من أوروبا وآسيا عن اهتمامهم.

قال أحد المحللين الماليين: "أظهرت Anthropic أن الأخلاق يمكن أن تكون ميزة تجارية. الناس على استعداد لدفع المال لشركة لديها مبادئ."

بالطبع، كانت خسارة السوق الفيدرالية لا تزال ضربة. لكن Anthropic تمكنت من تعويضها بالنمو في أسواق أخرى.

الخلاصة

النقطة الرئيسية

أظهرت حرب أخلاقيات الذكاء الاصطناعي بين ترامب و Anthropic أن مستقبل التكنولوجيا يعتمد على خياراتنا اليوم. عندما تقول شركة "لا" للقوة و"نعم" للأخلاق، فهذه رسالة قوية: المبادئ أهم من الربح.

أثبتت Anthropic، برفضها عقد البنتاغون والوقوف بحزم ضد الأمر التنفيذي لترامب، أن شركات التكنولوجيا يمكن أن يكون لها مبادئ وأن تنجح في نفس الوقت. أظهر الدعم العام ونمو الإيرادات والدعم الدولي أن الناس يقدرون الشركات التي تأخذ الأخلاق على محمل الجد.

هذه الحرب لم تنته بعد. تستمر المعركة القانونية والمستقبل غير مؤكد. لكن شيء واحد واضح: بدأ عصر جديد في التكنولوجيا — عصر تهم فيه الأخلاق بقدر ما تهم الابتكار. وأظهرت Anthropic أنها مستعدة للقتال من أجل هذه المبادئ.

معرض الصور الإضافية: حرب أخلاقيات الذكاء الاصطناعي: لماذا حظر ترامب Anthropic واختار OpenAI؟