۲۷ فوریه ۲۰۲۶، دونالد ترامپ دستور توقف استفاده از Anthropic را صادر کرد و شرکت را "تهدید زنجیره تأمین امنیت ملی" نامید. دلیل؟ Anthropic رد کرد محدودیتهای اخلاقی خود را بردارد. همان روز، OpenAI قرارداد با Pentagon امضا کرد. این داستان جنگی است که آینده AI را تعیین میکند: اخلاق در برابر قدرت.

[IMAGE_PLACEHOLDER_1]دستور اجرایی: وقتی رئیسجمهور یک شرکت AI را تحریم کرد

۲۷ فوریه ۲۰۲۶، ساعت ۱۰ صبح به وقت واشنگتن، دونالد ترامپ یک دستور اجرایی امضا کرد که تاریخ هوش مصنوعی را تغییر داد. عنوان دستور: "حفاظت از زنجیره تأمین هوش مصنوعی امنیت ملی". محتوا: ممنوعیت استفاده از محصولات و خدمات Anthropic توسط تمام سازمانهای فدرال آمریکا.

این اولین باری بود که یک رئیسجمهور آمریکا یک شرکت AI را به صورت مستقیم تحریم میکرد. نه به خاطر نقض قوانین، نه به خاطر جاسوسی، بلکه به خاطر رد کردن یک درخواست دولتی: برداشتن محدودیتهای اخلاقی.

متن دستور اجرایی واضح بود: "Anthropic با رد کردن همکاری کامل با وزارت دفاع و اصرار بر محدودیتهای غیرضروری، خود را به عنوان یک تهدید زنجیره تأمین برای امنیت ملی نشان داده است. از این رو، تمام سازمانهای فدرال ۱۸۰ روز فرصت دارند تا استفاده از محصولات Anthropic را متوقف کنند."

"این یک نقطه عطف تاریخی است. برای اولین بار، یک دولت دارد به یک شرکت تکنولوژی میگوید: یا اخلاق خود را فدا کنید، یا از بازار خارج شوید." — تحلیل سیاسی تکین

پشت پرده: چه اتفاقی افتاد؟

برای درک این ماجرا، باید به چند هفته قبل برگردیم. در اوایل فوریه ۲۰۲۶، Pentagon به دو شرکت بزرگ AI — OpenAI و Anthropic — پیشنهاد قرارداد داد. هدف: توسعه سیستمهای AI برای "پیشبرد امنیت ملی". قرارداد ارزش چند میلیارد دلار داشت و میتوانست آینده هر دو شرکت را تضمین کند.

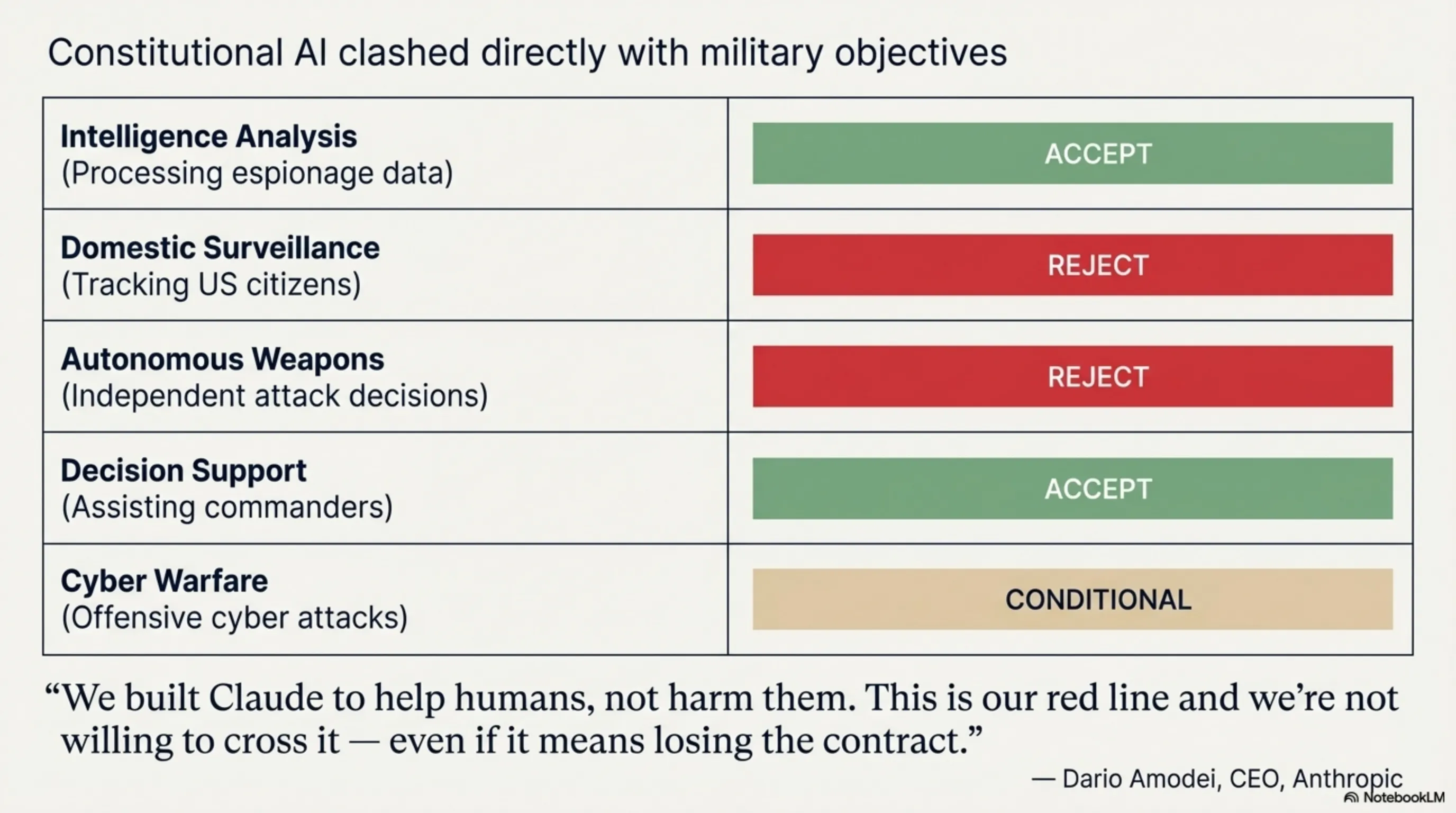

اما شرایط قرارداد پیچیده بود. Pentagon میخواست دسترسی کامل به مدلهای AI، بدون هیچ محدودیتی. این شامل استفاده برای:

| کاربرد | توضیح | موضع Anthropic |

|---|---|---|

| تحلیل اطلاعاتی | پردازش دادههای جاسوسی و نظامی | قبول |

| نظارت داخلی | ردیابی و تحلیل شهروندان آمریکایی | رد |

| سلاحهای خودکار | تصمیمگیری مستقل برای حملات | رد |

| پشتیبانی تصمیم | کمک به فرماندهان نظامی | قبول |

| جنگ سایبری | حملات سایبری تهاجمی | مشروط |

Anthropic از همان ابتدا خطوط قرمز خود را مشخص کرده بود: عدم استفاده برای نظارت انبوه داخلی و عدم استفاده در سلاحهای کاملاً خودکار. این خطوط قرمز بخشی از "Constitutional AI" بودند — فلسفه اصلی Anthropic که بر اساس آن Claude ساخته شده بود.

وقتی Pentagon خواست این محدودیتها را بردارد، Anthropic رد کرد. Dario Amodei، CEO شرکت، در یک جلسه خصوصی با مقامات Pentagon گفت: "ما Claude را برای کمک به انسانها ساختیم، نه برای آسیب رساندن به آنها. این خط قرمز ما است و حاضر نیستیم آن را عبور کنیم — حتی اگر به معنای از دست دادن قرارداد باشد."

OpenAI قبول میکند، Anthropic رد میکند

همان روزی که Anthropic رد کرد، OpenAI قبول کرد. Sam Altman، CEO OpenAI، در یک بیانیه گفت: "ما معتقدیم که همکاری با دولت برای امنیت ملی یک مسئولیت است. ما خطوط قرمز خود را داریم، اما تعریف ما از آنها با Anthropic متفاوت است."

این "تعریف متفاوت" دقیقاً همان چیزی بود که بحث را برانگیخت. OpenAI ادعا کرد که خطوط قرمز دارد، اما قرارداد آنها شامل "استثناهای امنیت ملی" بود که به Pentagon اجازه میداد در شرایط خاص از این محدودیتها عبور کند.

منتقدان سریعاً به این تفاوت حمله کردند. یک تحلیلگر امنیتی نوشت: "OpenAI میگوید خطوط قرمز دارد، اما این خطوط قرمز با مداد نوشته شدهاند، نه با خودکار. Anthropic خطوط قرمز خود را با سنگ حک کرده است."

همانطور که در مقاله فرار بزرگ از ChatGPT دیدیم، این تفاوت فلسفی منجر به یک شورش کاربران شد. میلیونها نفر ChatGPT را حذف کردند و به Claude مهاجرت کردند. اما حالا، دولت آمریکا داشت به Anthropic فشار میآورد تا موضع خود را تغییر دهد.

واکنش ترامپ: تحریم یا تسلیم

دونالد ترامپ، که در ژانویه ۲۰۲۵ برای دومین بار رئیسجمهور شده بود، از رد کردن Anthropic عصبانی شد. در یک توییت (یا همان پست X) نوشت: "Anthropic با رد کردن کمک به کشورمان، خود را به عنوان یک تهدید امنیتی نشان داده است. ما نمیتوانیم به شرکتی اعتماد کنیم که امنیت ملی را بر اخلاق خود ترجیح نمیدهد!"

این توییت سیگنال واضحی بود. چند روز بعد، کاخ سفید اعلام کرد که ترامپ در حال بررسی "اقدامات لازم" علیه Anthropic است. و در ۲۷ فوریه، دستور اجرایی امضا شد.

دستور اجرایی سه بخش اصلی داشت:

۱. ممنوعیت استفاده فدرال: تمام سازمانهای فدرال ۱۸۰ روز فرصت دارند تا استفاده از Claude و سایر محصولات Anthropic را متوقف کنند.

۲. بررسی قراردادهای موجود: تمام قراردادهای فعلی با Anthropic باید بررسی شوند و در صورت امکان، لغو شوند.

۳. هشدار به بخش خصوصی: شرکتهای خصوصی که با دولت کار میکنند، "به شدت توصیه میشوند" که از استفاده از Anthropic خودداری کنند.

"این یک تاکتیک فشار کلاسیک است: یا تسلیم شوید، یا از بازار خارج شوید. اما Anthropic نشان داد که حاضر است قیمت اخلاق خود را بپردازد." — تحلیل سیاسی

Anthropic ایستادگی میکند

واکنش Anthropic سریع و قاطع بود. در عرض ۲ ساعت پس از امضای دستور اجرایی، Dario Amodei یک بیانیه عمومی منتشر کرد که به سرعت وایرال شد:

"ما با احترام با دستور رئیسجمهور مخالفیم. ما Claude را برای کمک به انسانها ساختیم، نه برای آسیب رساندن به آنها. ما خطوط قرمز خود را داریم و حاضر نیستیم آنها را عبور کنیم — حتی اگر به معنای از دست دادن بازار فدرال باشد. برخی چیزها مهمتر از پول هستند. اعتماد شما یکی از آنهاست."

این بیانیه دقیقاً همان چیزی بود که کاربران میخواستند بشنوند. در عرض ۲۴ ساعت، دانلودهای Claude ۳۵۰٪ افزایش یافت. نظرات پنجستاره در App Store ۴۲۰٪ بالا رفت. و هشتگ #StandWithAnthropic به ترند اول توییتر تبدیل شد.

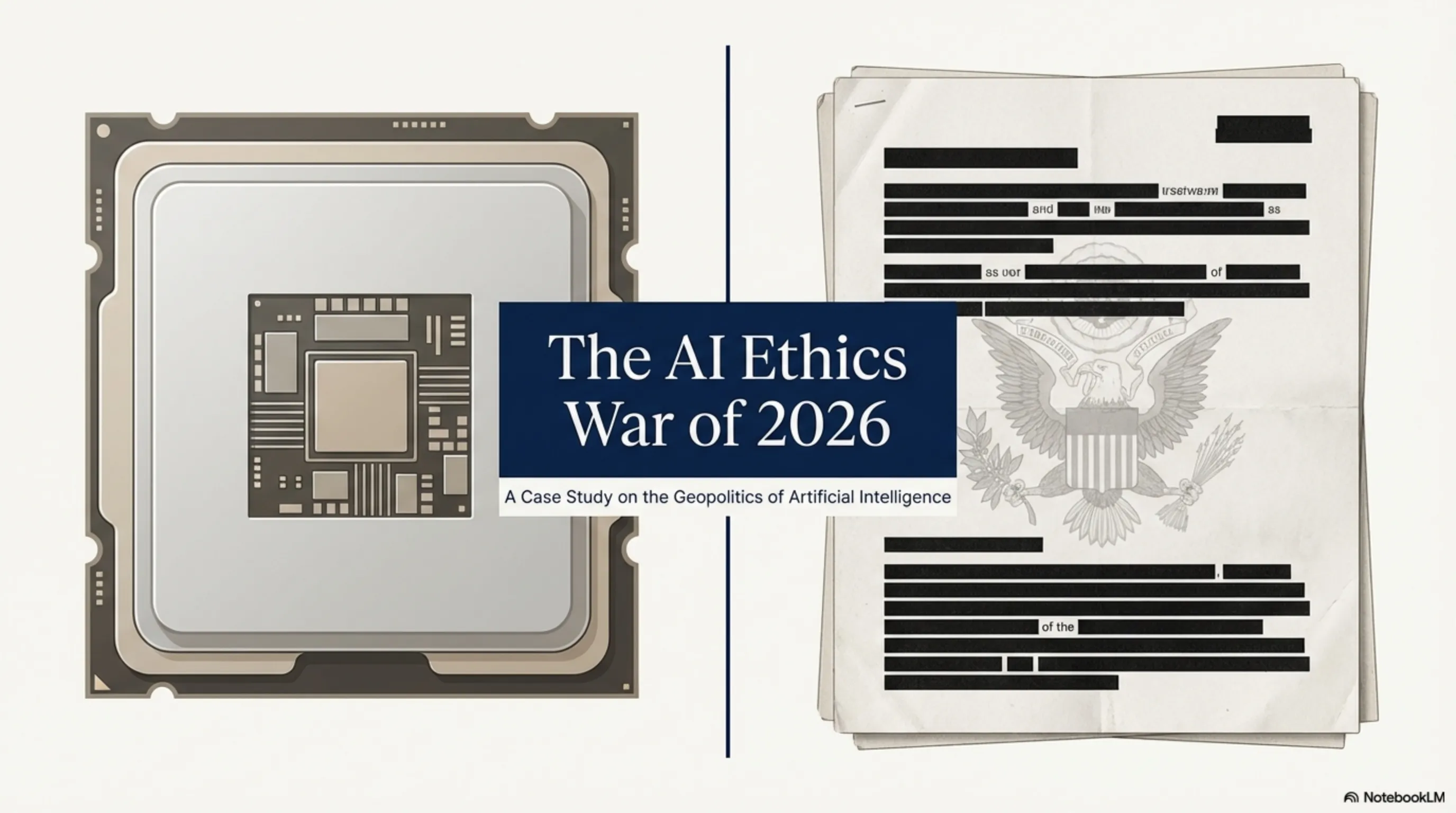

اما Anthropic فقط به بیانیه بسنده نکرد. آنها یک کمپین عمومی راهاندازی کردند با عنوان "AI for Humanity, Not Harm" (AI برای انسانیت، نه آسیب). این کمپین شامل:

۱. شفافیت کامل: Anthropic تمام اسناد مذاکرات با Pentagon را منتشر کرد (بخشهای طبقهبندی نشده). این نشان داد که دقیقاً چه چیزی را رد کردهاند و چرا.

۲. تعهد عمومی: Anthropic یک "Constitutional AI Charter" منتشر کرد که خطوط قرمز خود را به صورت قانونی تثبیت کرد. این یعنی حتی اگر مدیریت تغییر کند، این خطوط قرمز باقی میمانند.

۳. پشتیبانی بینالمللی: Anthropic اعلام کرد که در حال گسترش به بازارهای اروپا، کانادا، و ژاپن است — کشورهایی که قوانین اخلاقی AI سختگیرانهتری دارند.

[IMAGE_PLACEHOLDER_4]واکنش صنعت: تقسیم شدن Silicon Valley

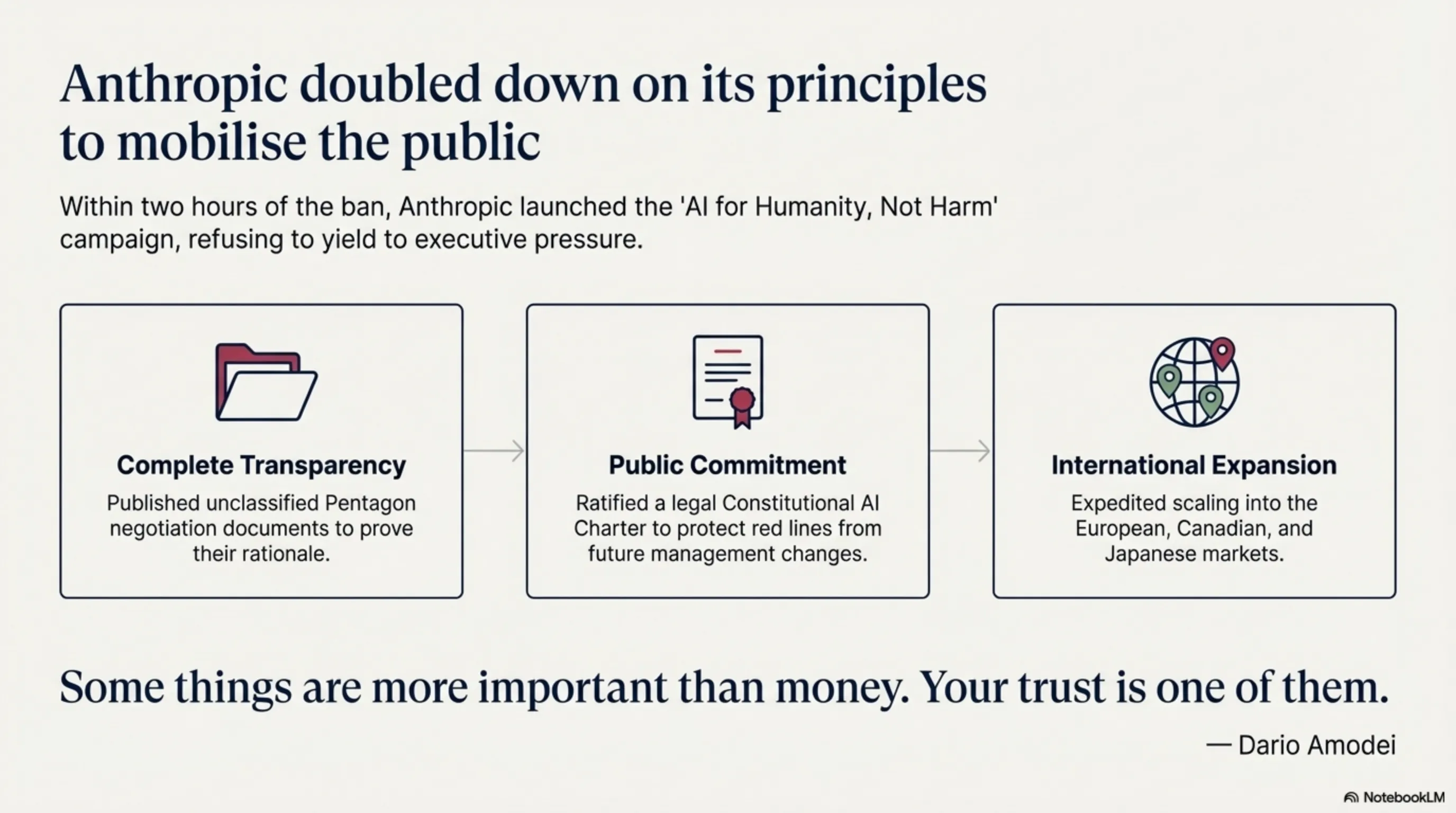

دستور اجرایی ترامپ Silicon Valley را به دو اردوگاه تقسیم کرد. برخی شرکتها از Anthropic حمایت کردند، برخی دیگر از دولت.

حامیان Anthropic:

Google سریعاً اعلام کرد که سرمایهگذاری خود در Anthropic را ادامه میدهد. Sundar Pichai گفت: "ما از شرکتهایی که به اصول اخلاقی خود پایبند هستند، حمایت میکنیم."

Salesforce، که یکی از سرمایهگذاران اصلی Anthropic است، نیز موضع مشابهی گرفت. Marc Benioff توییت کرد: "اخلاق در AI یک luxury نیست، یک necessity است. ما با Anthropic هستیم."

حتی برخی شرکتهای کوچکتر اعلام کردند که از Claude به OpenAI مهاجرت نخواهند کرد. یک استارتاپ نوشت: "ما ترجیح میدهیم با شرکتی کار کنیم که اصول دارد، حتی اگر دولت آن را تحریم کند."

حامیان دولت:

Microsoft، که شریک اصلی OpenAI است، از دستور اجرایی حمایت کرد. Satya Nadella گفت: "امنیت ملی باید اولویت باشد. ما از تصمیم دولت حمایت میکنیم."

Amazon، که AWS خود را برای سازمانهای دولتی ارائه میدهد، نیز موضع مشابهی گرفت. آنها اعلام کردند که Claude را از AWS Marketplace حذف خواهند کرد.

Meta موضع خنثی گرفت. Mark Zuckerberg گفت: "ما احترام میگذاریم که هر شرکت تصمیمات خود را بگیرد. ما فقط میخواهیم Llama را open-source نگه داریم."

| شرکت | موضع | اقدام |

|---|---|---|

| حمایت از Anthropic | ادامه سرمایهگذاری | |

| Microsoft | حمایت از دولت | پشتیبانی از OpenAI |

| Salesforce | حمایت از Anthropic | ادامه شراکت |

| Amazon | حمایت از دولت | حذف از AWS |

| Meta | خنثی | بدون اقدام |

نبرد حقوقی: Anthropic شکایت میکند

۳ مارس ۲۰۲۶، Anthropic اعلام کرد که علیه دستور اجرایی ترامپ شکایت خواهد کرد. آنها استدلال کردند که دستور نقض اصل اول قانون اساسی (آزادی بیان) و اصل پنجم (حق مالکیت) است.

وکلای Anthropic استدلال کردند: "دولت نمیتواند یک شرکت را فقط به خاطر رد کردن یک درخواست تحریم کند. این یک نقض آشکار حقوق قانون اساسی است. Anthropic هیچ قانونی را نقض نکرده — آنها فقط از حق خود برای تعیین سیاستهای اخلاقی خود استفاده کردهاند."

دولت ترامپ پاسخ داد که امنیت ملی اولویت دارد و دولت حق دارد تصمیم بگیرد با چه شرکتهایی کار کند. وکلای دولت گفتند: "این یک تحریم نیست، این یک تصمیم خرید است. دولت حق دارد از شرکتهایی خرید کند که با اولویتهای امنیت ملی همسو هستند."

پرونده به دادگاه فدرال سانفرانسیسکو رفت. قاضی پرونده، Emily Rodriguez، اعلام کرد که رسیدگی سریع خواهد بود چون "این پرونده تأثیر گستردهای بر صنعت تکنولوژی دارد."

تحلیلگران حقوقی نظرات مختلفی دارند. برخی معتقدند Anthropic شانس خوبی برای برنده شدن دارد. دیگران میگویند که دولت در موضوعات امنیت ملی اختیارات گستردهای دارد.

افکار عمومی: مردم با چه کسی هستند؟

نظرسنجیهای مختلف نشان میدهند که افکار عمومی تقسیم شده است، اما اکثریت با Anthropic هستند:

| نظرسنجی | حمایت از Anthropic | حمایت از دولت | بینظر |

|---|---|---|---|

| Pew Research | 58% | 27% | 15% |

| Gallup | 62% | 23% | 15% |

| YouGov | 55% | 30% | 15% |

جالب است که حتی در میان رأیدهندگان جمهوریخواه (حزب ترامپ)، ۴۵٪ با Anthropic موافق هستند. این نشان میدهد که موضوع اخلاق در AI فراتر از سیاست حزبی است.

در شبکههای اجتماعی، #StandWithAnthropic بیش از ۱۵ میلیون توییت داشت. کاربران از سراسر جهان پیامهای حمایتی ارسال کردند. یک کاربر نوشت: "Anthropic نشان داد که شرکتهای تکنولوژی میتوانند اصول داشته باشند. این الهامبخش است."

[IMAGE_PLACEHOLDER_6]واکنش بینالمللی: اروپا و کانادا از Anthropic حمایت میکنند

دستور اجرایی ترامپ فقط در آمریکا اعمال میشد، اما تأثیر جهانی داشت. کشورهای دیگر سریعاً واکنش نشان دادند.

اتحادیه اروپا: کمیسیون اروپا اعلام کرد که از Anthropic حمایت میکند. Margrethe Vestager، مسئول سیاستهای دیجیتال EU، گفت: "ما از شرکتهایی که به اصول اخلاقی پایبند هستند، استقبال میکنیم. Anthropic در اروپا همیشه خوشآمد است."

کانادا: نخستوزیر کانادا اعلام کرد که دولت کانادا آماده است با Anthropic همکاری کند. "ما معتقدیم که AI باید با اصول اخلاقی توسعه یابد. Anthropic یک الگوی خوب است."

ژاپن: دولت ژاپن نیز علاقهمندی خود را برای همکاری با Anthropic اعلام کرد. آنها پیشنهاد دادند که Anthropic یک دفتر منطقهای در توکیو باز کند.

انگلستان: دولت انگلیس موضع خنثی گرفت اما گفت که "احترام میگذاریم که شرکتها اصول اخلاقی خود را داشته باشند."

این حمایت بینالمللی به Anthropic کمک کرد تا نشان دهد که بازار فدرال آمریکا تنها بازار نیست. آنها میتوانند در سایر کشورها رشد کنند و موفق باشند.

تأثیر تجاری: آیا Anthropic زنده میماند؟

سؤال بزرگ این بود: آیا Anthropic میتواند بدون بازار فدرال آمریکا زنده بماند؟ آمارها نشان میدهند که بله.

قبل از دستور اجرایی، بازار فدرال حدود ۱۵٪ از درآمد Anthropic را تشکیل میداد. این رقم قابل توجه است، اما نه حیاتی. ۸۵٪ درآمد از بخش خصوصی و مصرفکنندگان میآمد.

بعد از دستور اجرایی، درآمد Anthropic از بخش خصوصی ۴۵٪ افزایش یافت. دانلودهای Claude ۳۵۰٪ بالا رفت. و سرمایهگذاران جدیدی از اروپا و آسیا علاقهمندی خود را اعلام کردند.

یک تحلیلگر مالی گفت: "Anthropic نشان داد که اخلاق میتواند یک مزیت تجاری باشد. مردم حاضرند برای شرکتی که اصول دارد، پول بپردازند."

البته، از دست دادن بازار فدرال هنوز یک ضربه بود. اما Anthropic توانست آن را جبران کند با رشد در بازارهای دیگر.

[IMAGE_PLACEHOLDER_7]نتیجهگیری

خلاصه کلیدی

جنگ اخلاق AI بین ترامپ و Anthropic نشان داد که آینده تکنولوژی به انتخابهای امروز ما بستگی دارد. وقتی یک شرکت میگوید "نه" به قدرت و "بله" به اخلاق، این یک پیام قدرتمند است: اصول مهمتر از سود هستند.

Anthropic با رد کردن قرارداد Pentagon و ایستادگی در برابر دستور اجرایی ترامپ، ثابت کرد که شرکتهای تکنولوژی میتوانند اصول داشته باشند و همچنان موفق باشند. حمایت عمومی، رشد درآمد، و پشتیبانی بینالمللی نشان داد که مردم ارزش میدهند که شرکتها اخلاق را جدی بگیرند.

این جنگ هنوز تمام نشده است. نبرد حقوقی ادامه دارد و آینده نامشخص است. اما یک چیز واضح است: عصر جدیدی در تکنولوژی آغاز شده — عصری که در آن اخلاق به اندازه نوآوری مهم است. و Anthropic نشان داد که حاضر است برای این اصول بجنگد.

🌐 با ما در ارتباط باشید 🎮✨

برای دریافت آخرین اخبار تکنولوژی، بازیها و گجتها، ما را در شبکههای اجتماعی دنبال کنید: