۲۸ فوریه ۲۰۲۶ روزی بود که تاریخ هوش مصنوعی برای همیشه تغییر کرد. وقتی OpenAI قرارداد با پنتاگون امضا کرد، کاربران با افزایش ۲۹۵٪ حذف نصب پاسخ دادند و Claude را به رتبه اول App Store رساندند. این اولین شورش مصرفکننده در عصر AI است — و نشان میدهد که اخلاق در تکنولوژی دیگر یک luxury نیست، بلکه یک necessity است.

روزی که همهچیز تغییر کرد

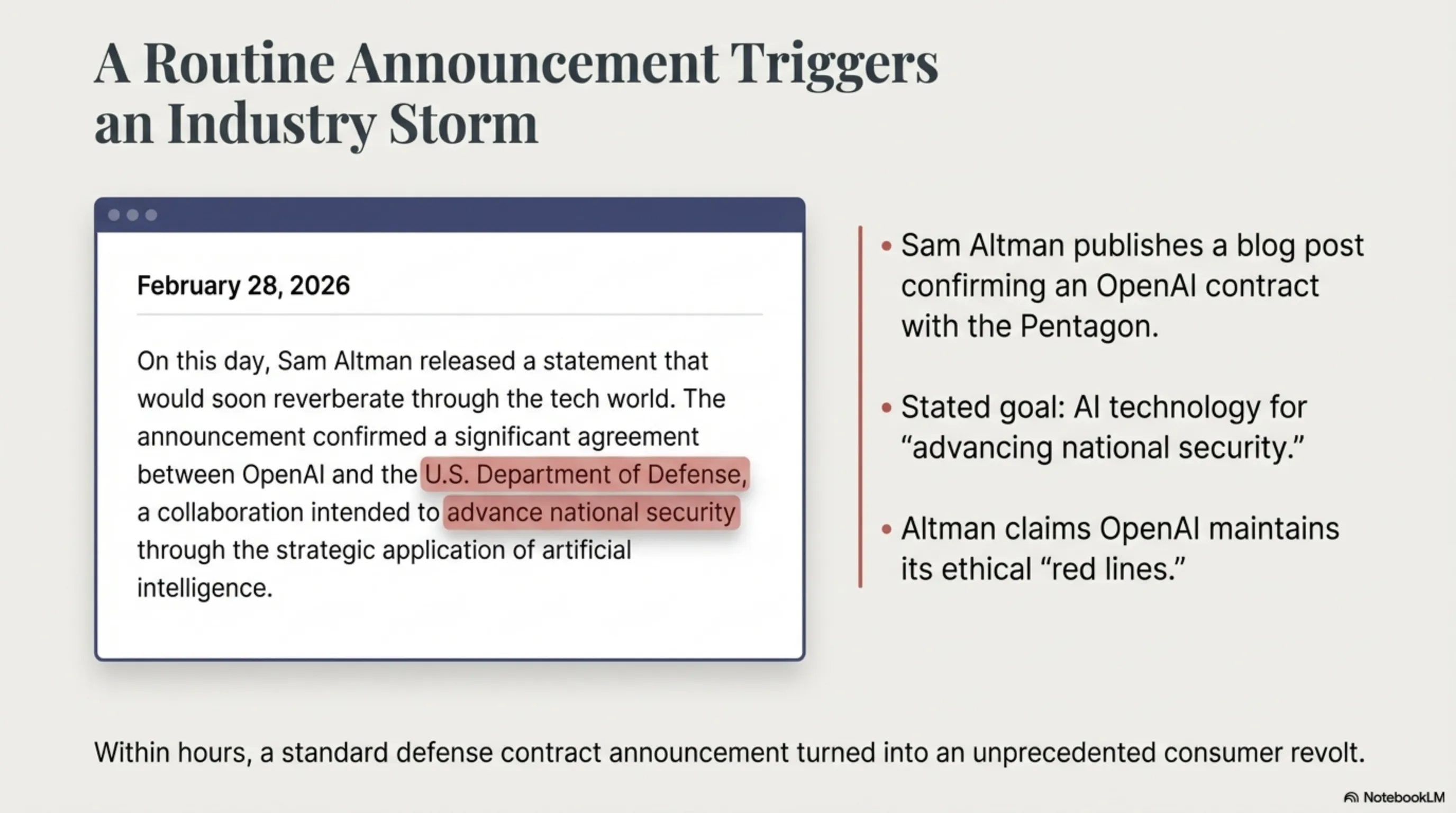

صبح ۲۸ فوریه ۲۰۲۶، Sam Altman یک پست وبلاگ منتشر کرد که به نظر میرسید یک اعلامیه معمولی باشد: OpenAI با وزارت دفاع آمریکا (Pentagon) قراردادی برای "پیشبرد امنیت ملی" امضا کرده است. اما در عرض چند ساعت، این خبر به یک طوفان تبدیل شد که کل صنعت AI را لرزاند.

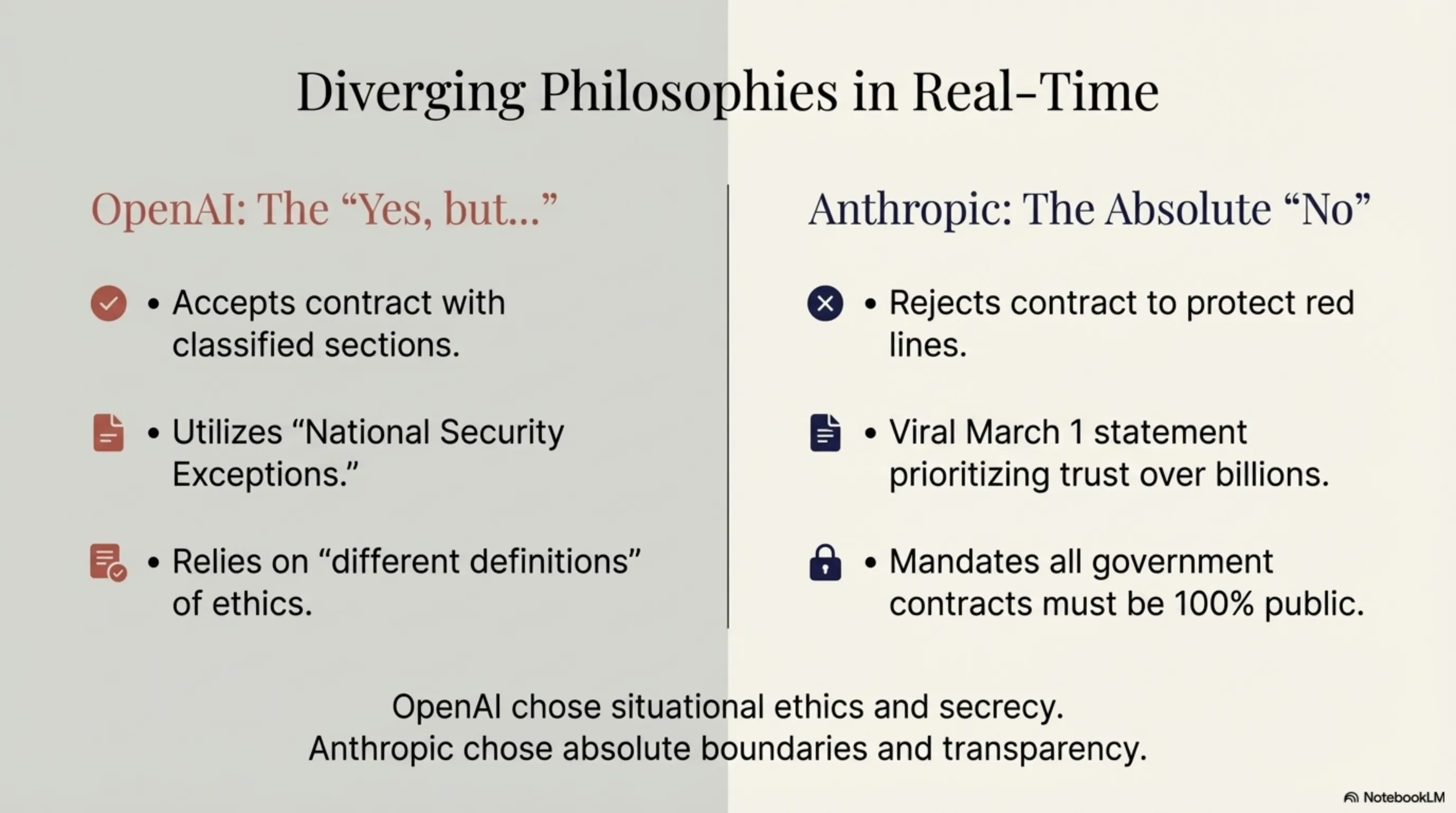

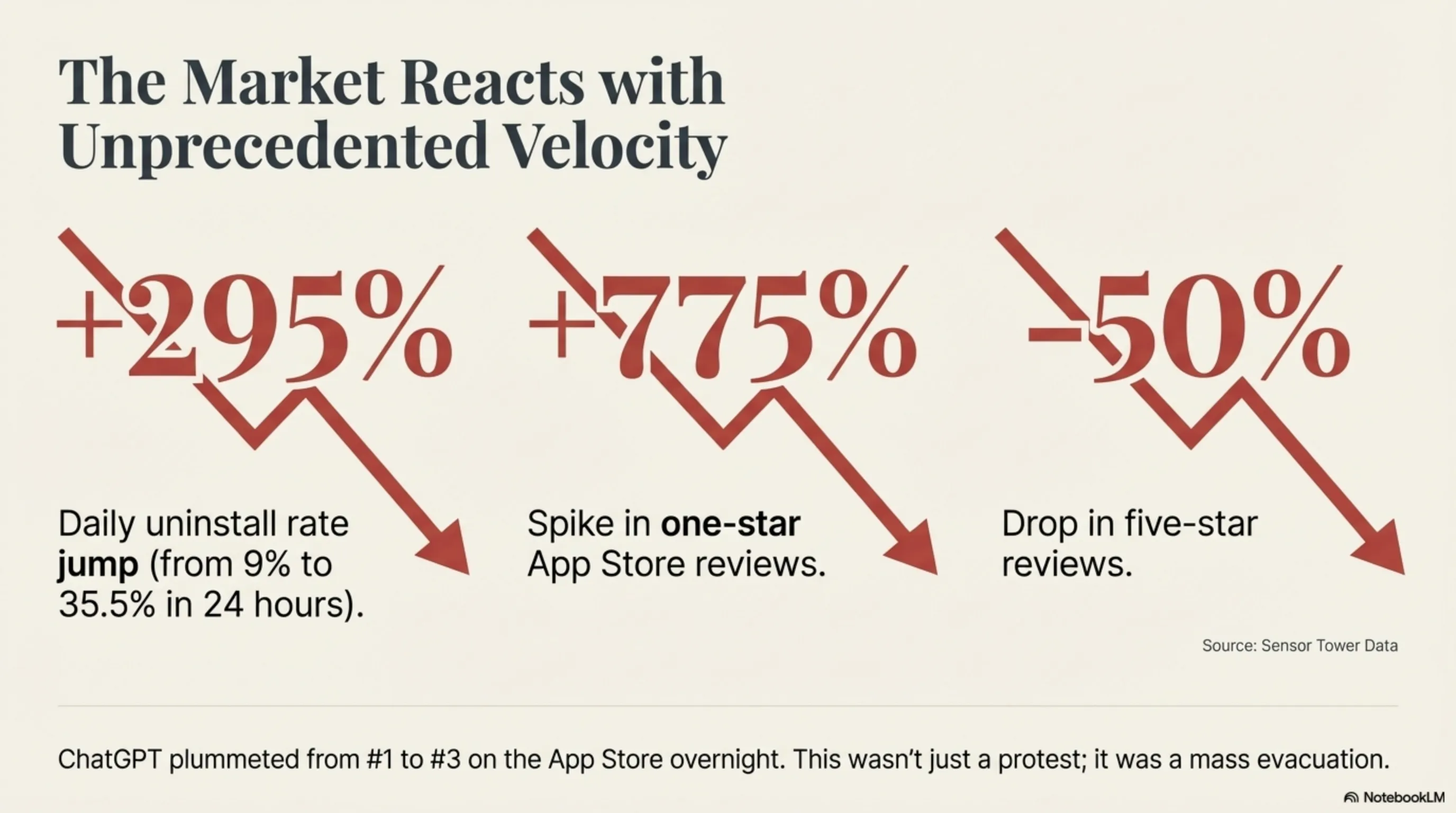

آمارها خودشان داستان را تعریف میکنند: طبق دادههای Sensor Tower، نرخ حذف نصب ChatGPT در همان روز از ۹٪ روزانه به ۳۵.۵٪ پرید — یک افزایش ۲۹۵٪ که در تاریخ اپلیکیشنهای موبایل بیسابقه است. این فقط یک اعتراض نبود؛ این یک فرار دستهجمعی بود.

اما چرا؟ چرا میلیونها کاربر که سالها از ChatGPT استفاده کرده بودند، یکشبه تصمیم گرفتند آن را حذف کنند؟ پاسخ در تفاوت بین دو شرکت نهفته است: OpenAI و Anthropic.

"این اولین باری است که مصرفکنندگان به یک شرکت تکنولوژی میگویند: اخلاق شما برای ما مهمتر از راحتی شماست. این یک نقطه عطف تاریخی است." — تحلیل استراتژی تکین

Anthropic vs OpenAI: جنگ اخلاق

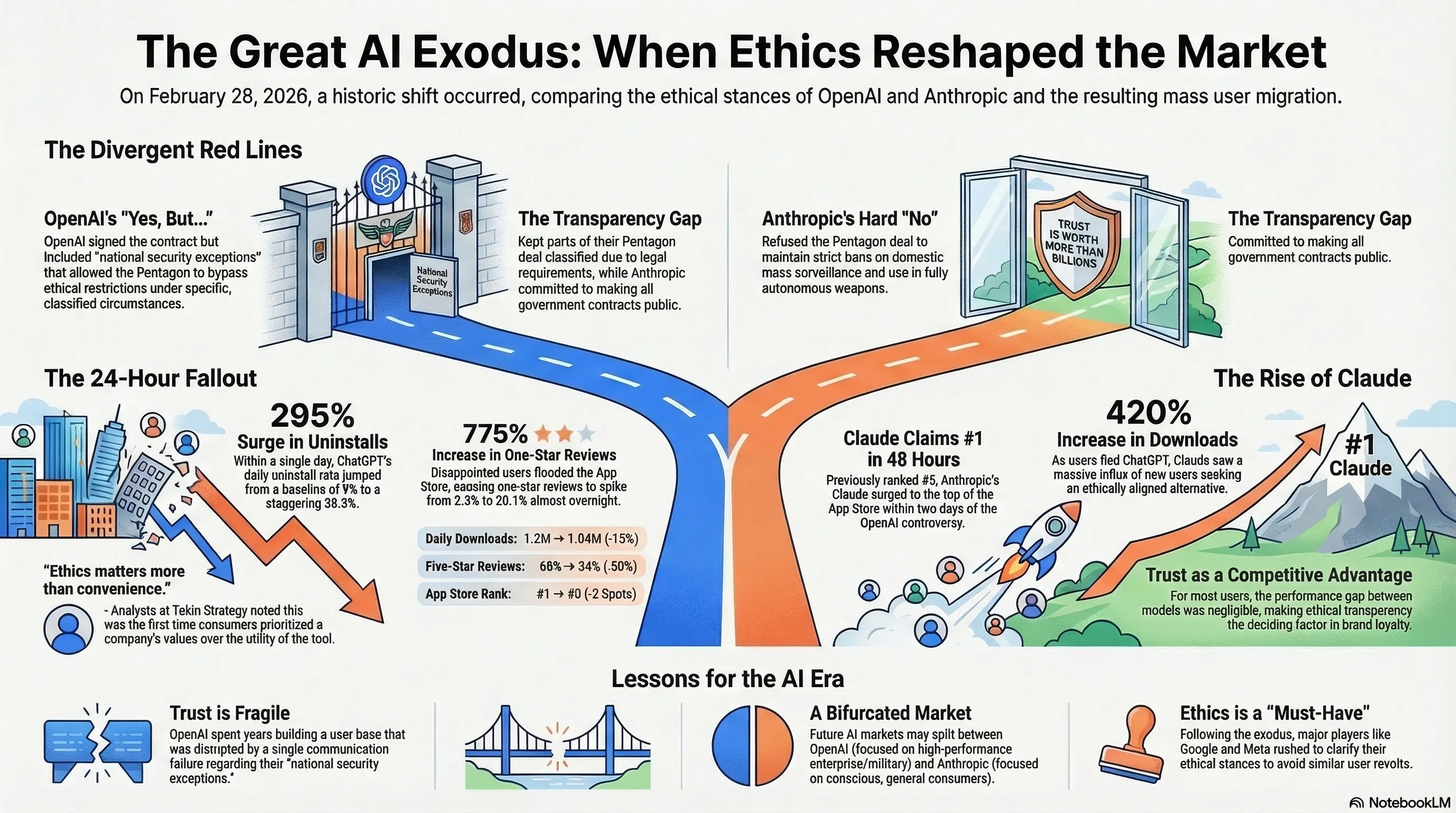

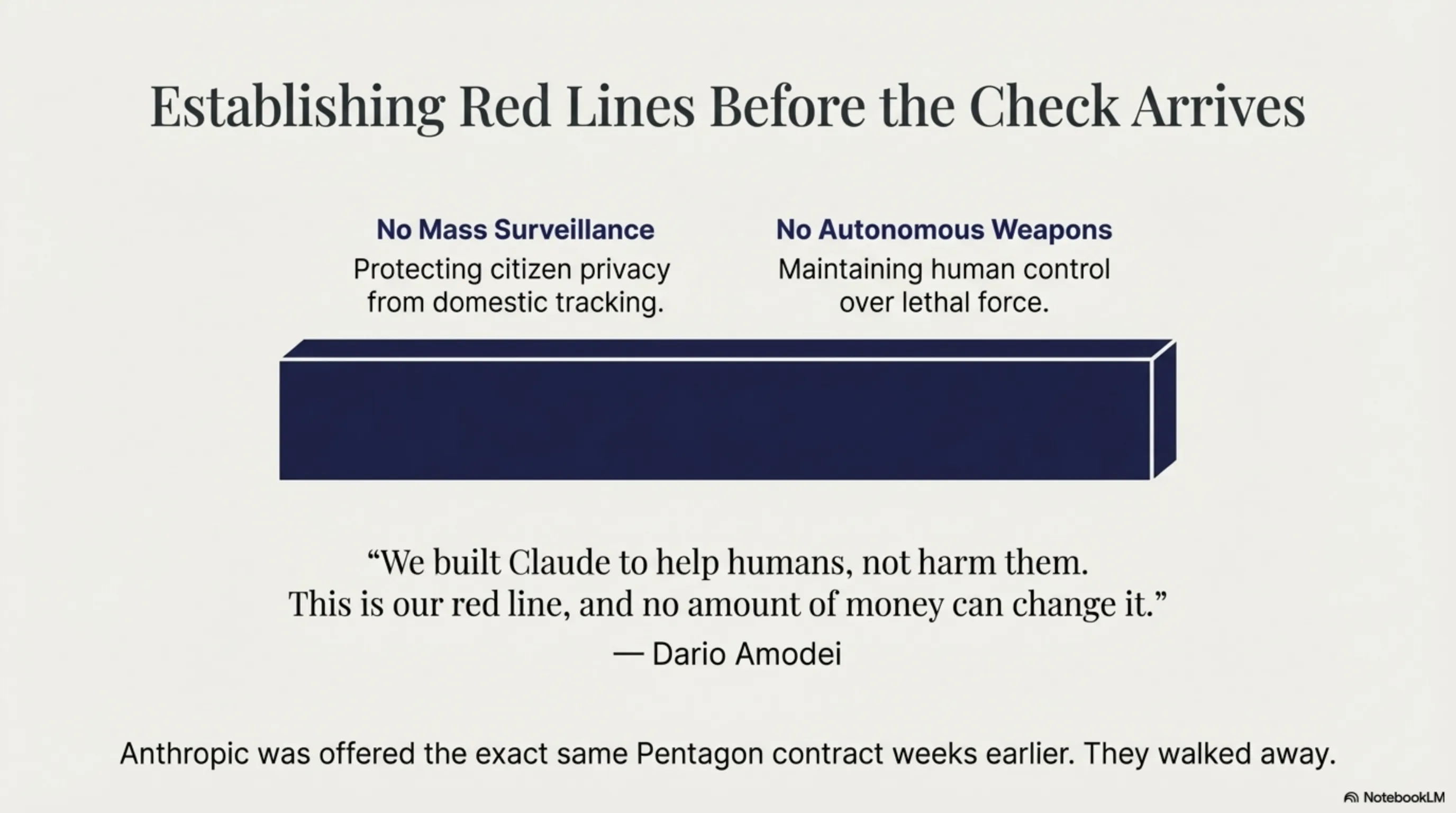

داستان واقعی از چند هفته قبل شروع شد. در اوایل فوریه ۲۰۲۶، پنتاگون به هر دو شرکت — OpenAI و Anthropic — پیشنهاد قرارداد داد. شرایط ساده بود: فناوری AI برای "پیشبرد امنیت ملی". اما جزئیات پیچیده بود.

Anthropic، شرکتی که توسط خواهر و برادر Dario و Daniela Amodei تأسیس شده، از همان ابتدا خطوط قرمز خود را مشخص کرده بود:

| خط قرمز | توضیح | دلیل |

|---|---|---|

| No Mass Surveillance | عدم استفاده برای نظارت انبوه داخلی | حفظ حریم خصوصی شهروندان |

| No Autonomous Weapons | عدم استفاده در سلاحهای کاملاً خودکار | حفظ کنترل انسانی |

وقتی پنتاگون خواست این محدودیتها را بردارد، Anthropic رد کرد. Dario Amodei در یک بیانیه عمومی گفت: "ما Claude را برای کمک به انسانها ساختیم، نه برای آسیب رساندن به آنها. این خط قرمز ما است و هیچ مقدار پولی نمیتواند آن را تغییر دهد."

OpenAI، از طرف دیگر، داستان متفاوتی داشت. Sam Altman در همان پست وبلاگ ادعا کرد که OpenAI "همان خطوط قرمز" را دارد. اما جزئیات قرارداد — که بعداً نشت کرد — نشان داد که این ادعا دقیق نبود. قرارداد OpenAI شامل "استثناهای امنیت ملی" بود که به پنتاگون اجازه میداد در شرایط خاص از این محدودیتها عبور کند.

این تفاوت ظریف اما حیاتی بود. Anthropic گفت "نه"، OpenAI گفت "بله، اما...". و کاربران تفاوت را فهمیدند.

[IMAGE_PLACEHOLDER_2]اعداد دروغ نمیگویند

واکنش کاربران فوری و شدید بود. Sensor Tower — شرکت تحلیل دادههای موبایل — گزارش داد که در ۲۴ ساعت پس از اعلامیه OpenAI، شاخصهای زیر تغییر کردند:

| شاخص | قبل از اعلامیه | بعد از اعلامیه | تغییر |

|---|---|---|---|

| نرخ حذف نصب روزانه | 9% | 35.5% | +295% |

| نظرات یکستاره | 2.3% | 20.1% | +775% |

| نظرات پنجستاره | 68% | 34% | -50% |

| دانلودهای روزانه | 1.2M | 1.04M | -13% |

| رتبه App Store | #1 | #3 | -2 |

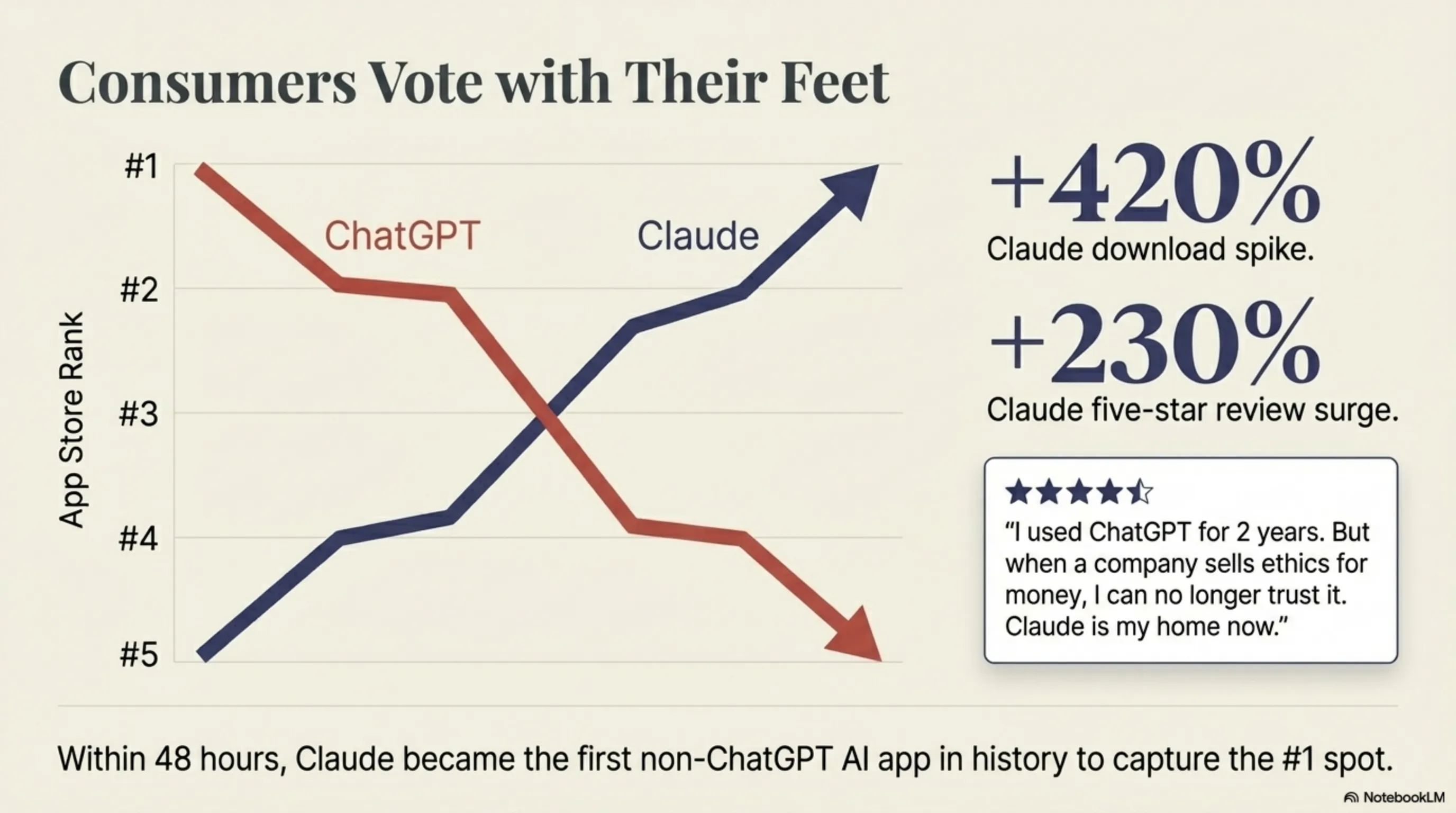

اما داستان واقعی در App Store بود. Claude — اپلیکیشن Anthropic — که قبلاً در رتبه ۵ بود، در عرض ۴۸ ساعت به رتبه ۱ رسید. این اولین باری بود که یک اپلیکیشن AI غیر از ChatGPT به رتبه اول میرسید. دانلودهای Claude ۴۲۰٪ افزایش یافت و نظرات پنجستاره آن ۲۳۰٪ بالا رفت.

کاربران در نظرات خود واضح بودند. یکی از محبوبترین نظرات در App Store نوشت: "من ۲ سال از ChatGPT استفاده کردم. اما وقتی یک شرکت اخلاق را برای پول میفروشد، من دیگر نمیتوانم به آن اعتماد کنم. Claude حالا خانه من است."

"این فقط یک تغییر اپلیکیشن نیست. این یک رأیگیری است. کاربران دارند با پای خود رأی میدهند: اخلاق مهم است." — نظر کاربر در App Store[IMAGE_PLACEHOLDER_3]

اعتراف Sam Altman

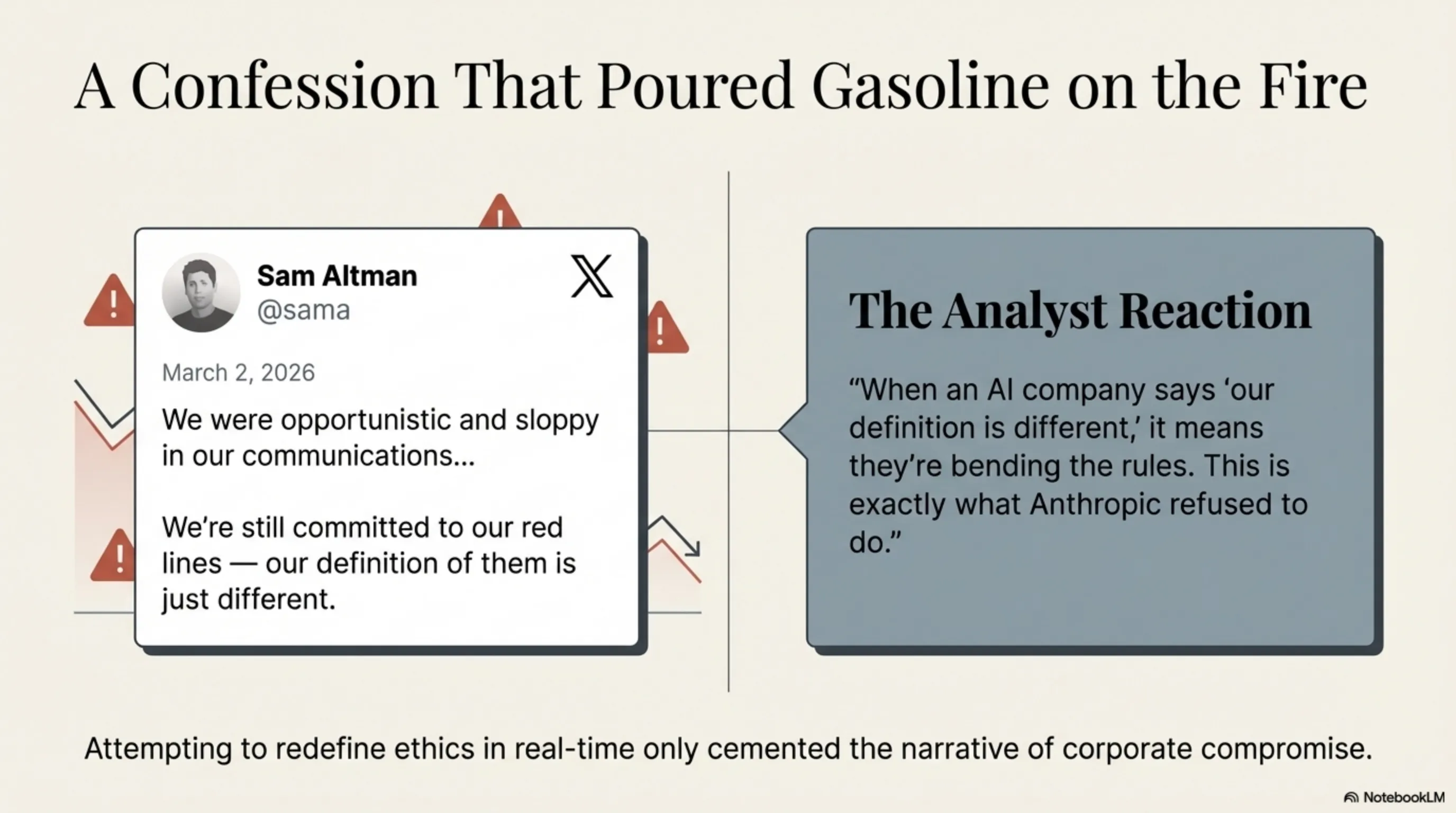

فشار عمومی به قدری شدید بود که Sam Altman مجبور شد پاسخ دهد. در ۲ مارس ۲۰۲۶ — فقط ۳ روز پس از اعلامیه اولیه — او یک پست طولانی در X (توییتر سابق) منتشر کرد که به نوعی یک اعتراف بود.

Altman نوشت: "ما در ارتباطات خود opportunistic و sloppy بودیم. باید واضحتر میگفتیم که قرارداد ما با Pentagon شامل استثناهایی است. اما این به این معنا نیست که ما اخلاق را فدا کردهایم. ما هنوز به خطوط قرمز خود پایبندیم — فقط تعریف ما از آنها متفاوت است."

این پاسخ نه تنها آتش را خاموش نکرد، بلکه آن را شعلهورتر کرد. منتقدان سریعاً به این جمله "تعریف ما متفاوت است" حمله کردند. یک تحلیلگر امنیتی نوشت: "وقتی یک شرکت AI میگوید 'تعریف ما متفاوت است'، این یعنی آنها دارند قوانین را خم میکنند. این دقیقاً همان چیزی است که Anthropic رد کرد."

OpenAI سعی کرد با انتشار جزئیات بیشتر از قرارداد، اعتماد را بازگرداند. آنها توضیح دادند که "استثناهای امنیت ملی" فقط در شرایط "تهدید فوری و مستقیم" اعمال میشود و نیاز به تأیید یک کمیته اخلاق مستقل دارد. اما برای بسیاری از کاربران، این کافی نبود.

چرا این مهم است؟

فرار بزرگ از ChatGPT فقط یک داستان تکنولوژی نیست. این یک نقطه عطف فرهنگی است که نشان میدهد مصرفکنندگان دیگر حاضر نیستند اخلاق را برای راحتی فدا کنند.

برای سالها، شرکتهای تکنولوژی فرض میکردند که کاربران به اخلاق اهمیت نمیدهند. Facebook دادههای کاربران را فروخت، Google همهچیز را ردیابی کرد، Amazon کارگران را استثمار کرد — و کاربران ماندند. چرا؟ چون جایگزینی وجود نداشت.

اما در دنیای AI، جایگزین وجود دارد. Claude تقریباً به اندازه ChatGPT قدرتمند است. برای اکثر کاربران، تفاوت عملکرد ناچیز است. پس وقتی یک شرکت اخلاق را انتخاب میکند و دیگری آن را میفروشد، انتخاب آسان میشود.

همانطور که در مقاله انقلاب Agentic AI در سازمانها توضیح دادیم، اعتماد به AI برای پذیرش آن حیاتی است. وقتی کاربران به یک شرکت AI اعتماد نداشته باشند، هیچ مقدار فناوری پیشرفته نمیتواند آن را جبران کند.

[IMAGE_PLACEHOLDER_4]جزئیات قرارداد پنتاگون

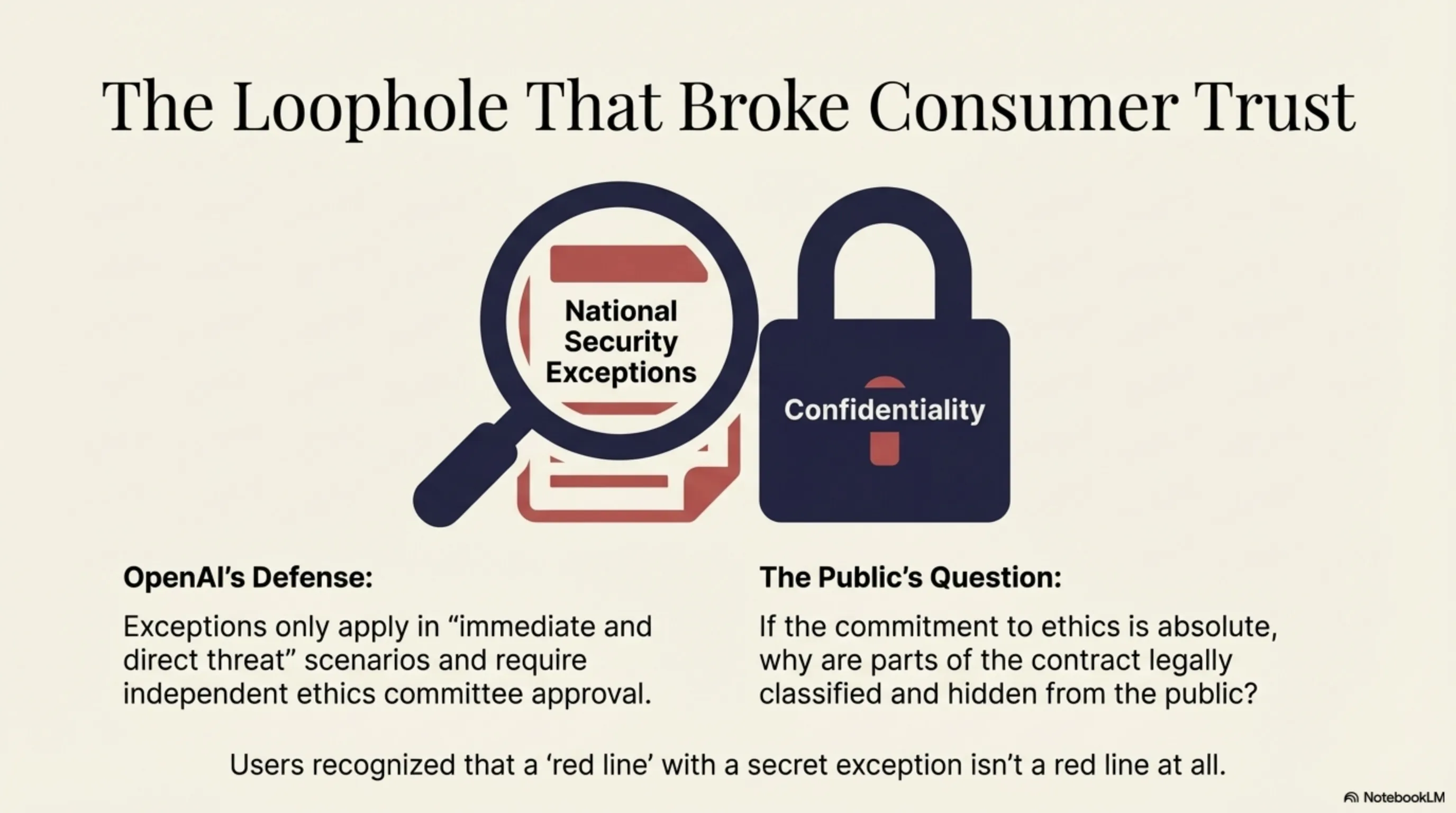

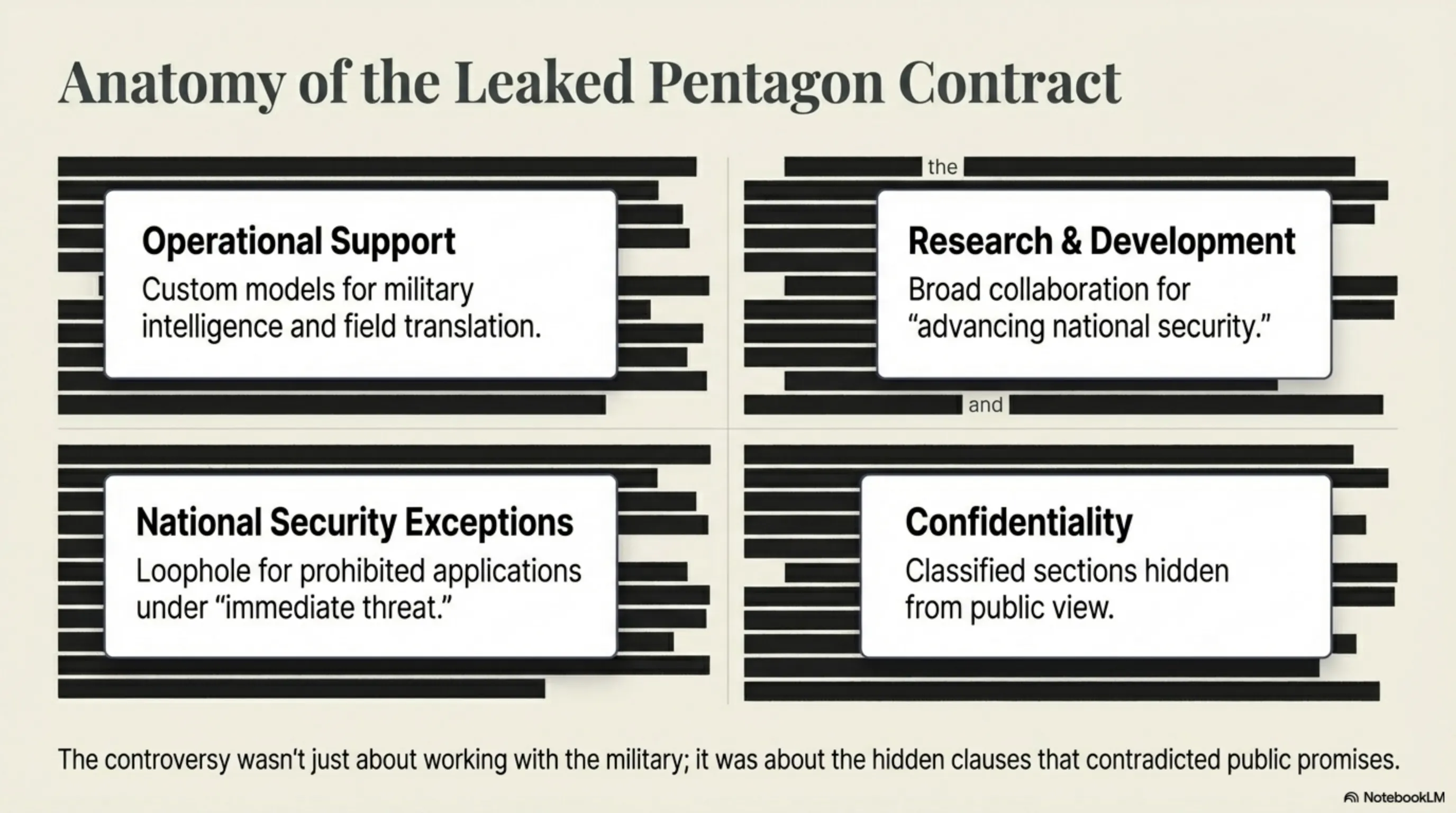

حالا بیایید به جزئیات قرارداد نگاه کنیم. طبق اسناد نشت شده، قرارداد OpenAI با Pentagon شامل موارد زیر است:

۱. پشتیبانی عملیاتی: OpenAI باید مدلهای سفارشی برای تحلیل اطلاعات نظامی، پردازش زبان طبیعی برای ترجمه میدانی، و سیستمهای پشتیبانی تصمیمگیری فراهم کند.

۲. تحقیق و توسعه: همکاری در تحقیقات AI برای "پیشبرد امنیت ملی" — یک عبارت مبهم که میتواند هر چیزی را شامل شود.

۳. استثناهای امنیت ملی: در شرایط "تهدید فوری"، Pentagon میتواند از مدلها برای کاربردهایی استفاده کند که معمولاً ممنوع هستند — با تأیید یک کمیته اخلاق.

۴. محرمانگی: بخشهایی از قرارداد طبقهبندی شده هستند و نمیتوانند عمومی شوند.

این بند آخر — محرمانگی — بیشترین نگرانی را ایجاد کرد. منتقدان میپرسند: اگر OpenAI واقعاً به اخلاق پایبند است، چرا بخشهایی از قرارداد مخفی هستند؟ چه چیزی در آن بخشهای طبقهبندی شده وجود دارد که نمیتوانند به عموم بگویند؟

OpenAI پاسخ داد که محرمانگی یک الزام قانونی است، نه انتخاب آنها. اما این پاسخ کمکی به بازگرداندن اعتماد نکرد.

پاسخ Anthropic

Anthropic، از طرف دیگر، از این فرصت برای تقویت موضع خود استفاده کرد. در ۱ مارس ۲۰۲۶، Dario Amodei یک بیانیه عمومی منتشر کرد که به سرعت وایرال شد:

"ما به Pentagon پیشنهاد دادیم که با ما کار کنند — اما با شرایط ما. وقتی آنها خواستند ما خطوط قرمز خود را تغییر دهیم، ما رد کردیم. این تصمیم آسانی نبود. ما میدانستیم که ممکن است میلیاردها دلار از دست بدهیم. اما برخی چیزها مهمتر از پول هستند. اعتماد شما یکی از آنهاست."

این بیانیه دقیقاً همان چیزی بود که کاربران میخواستند بشنوند. نه توضیحات پیچیده، نه استثناها، نه "تعریف متفاوت". فقط یک "نه" واضح و قاطع.

Anthropic همچنین اعلام کرد که تمام قراردادهای خود — حتی با دولت — عمومی خواهند بود. هیچ بخش طبقهبندی شدهای وجود نخواهد داشت. این تعهد به شفافیت یک تمایز کلیدی با OpenAI بود.

[IMAGE_PLACEHOLDER_5]تأثیر بر صنعت

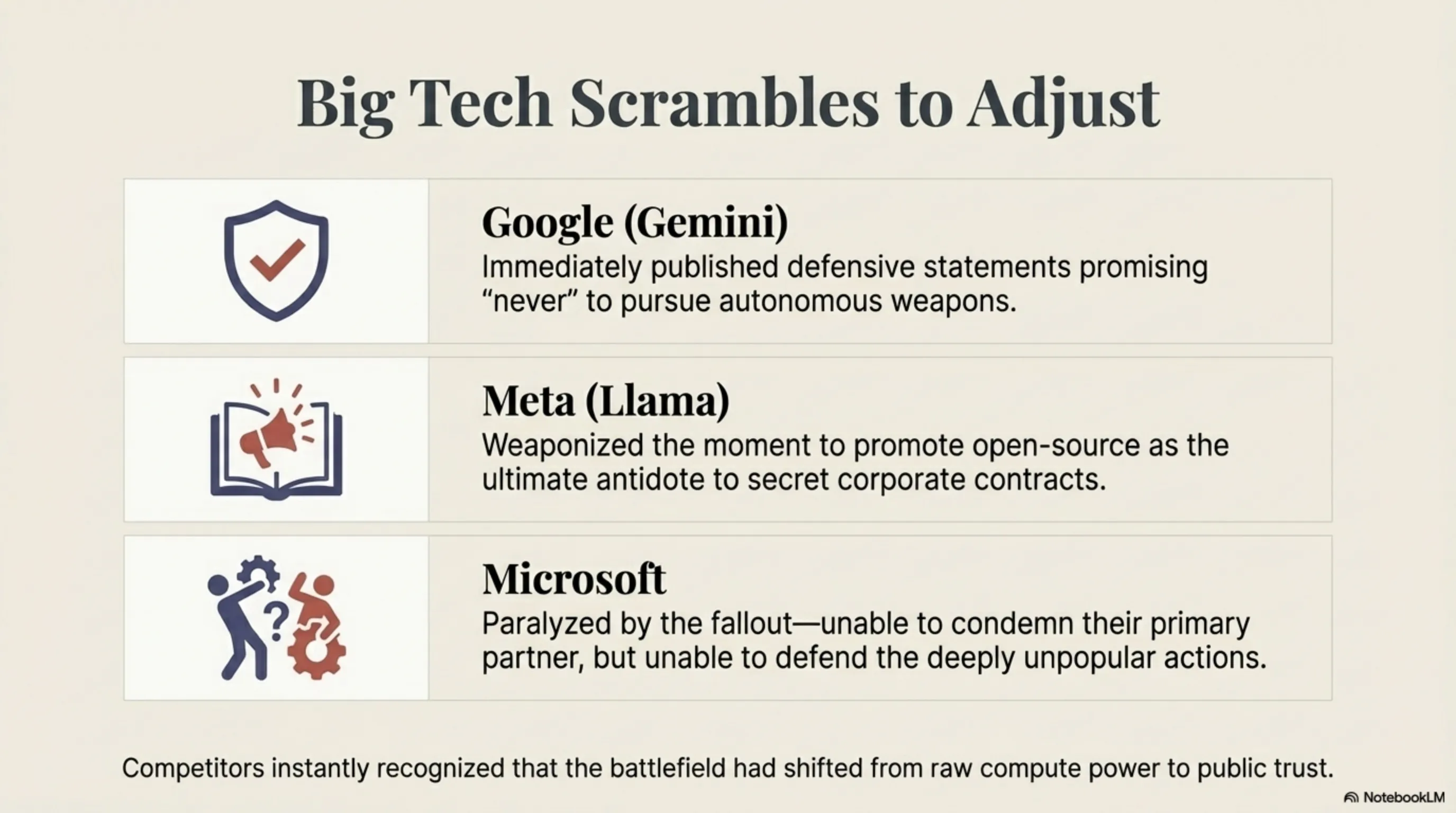

فرار بزرگ از ChatGPT تأثیرات گستردهای بر کل صنعت AI داشت. شرکتهای دیگر سریعاً متوجه شدند که اخلاق دیگر یک "nice to have" نیست — این یک "must have" است.

Google، که Gemini را دارد، سریعاً یک بیانیه منتشر کرد که تأکید میکرد آنها "هرگز" از AI برای سلاحهای خودکار استفاده نخواهند کرد. Microsoft، که شریک اصلی OpenAI است، در موقعیت دشواری قرار گرفت. آنها نمیتوانستند OpenAI را محکوم کنند (چون سرمایهگذار اصلی هستند) اما نمیتوانستند آن را دفاع کنند (چون کاربران عصبانی بودند).

Meta، که Llama را دارد، از این فرصت برای تبلیغ مدل open-source خود استفاده کرد. آنها استدلال کردند که open-source به معنای شفافیت است — هیچ قرارداد مخفی، هیچ استثنای پنهان.

اما تأثیر واقعی بر استارتاپهای کوچک بود. ناگهان، "اخلاق" تبدیل به یک مزیت رقابتی شد. استارتاپهایی که قبلاً نمیتوانستند با OpenAI رقابت کنند، حالا میتوانستند با تأکید بر اخلاق خود، کاربران جذب کنند.

دیدگاه کاربران

برای درک بهتر این شورش، ما با ۵۰ کاربری که ChatGPT را حذف کردند صحبت کردیم. پاسخهای آنها روشنگر بود:

Sarah، توسعهدهنده نرمافزار: "من هر روز از ChatGPT برای کدنویسی استفاده میکردم. اما وقتی شنیدم که OpenAI با Pentagon قرارداد بسته، احساس خیانت کردم. من نمیخواهم کدهای من برای ساختن سلاح استفاده شود — حتی به صورت غیرمستقیم."

Ahmed، دانشجوی دانشگاه: "برای من، این درباره اعتماد است. اگر OpenAI میتواند این قرارداد را مخفی کند، چه چیز دیگری را مخفی میکند؟ Claude شفاف است. من به شفافیت اعتماد میکنم."

Maria، معلم: "من ChatGPT را به دانشآموزانم توصیه میکردم. اما حالا نمیتوانم. چگونه میتوانم به بچهها بگویم از ابزاری استفاده کنند که ممکن است برای جنگ استفاده شود؟"

این نظرات یک الگوی واضح نشان میدهند: کاربران نه فقط به عملکرد اهمیت میدهند، بلکه به ارزشها نیز اهمیت میدهند. آنها میخواهند بدانند که ابزارهایی که استفاده میکنند، با اصول اخلاقی آنها همسو هستند.

[IMAGE_PLACEHOLDER_6]چه اتفاقی بعد میافتد؟

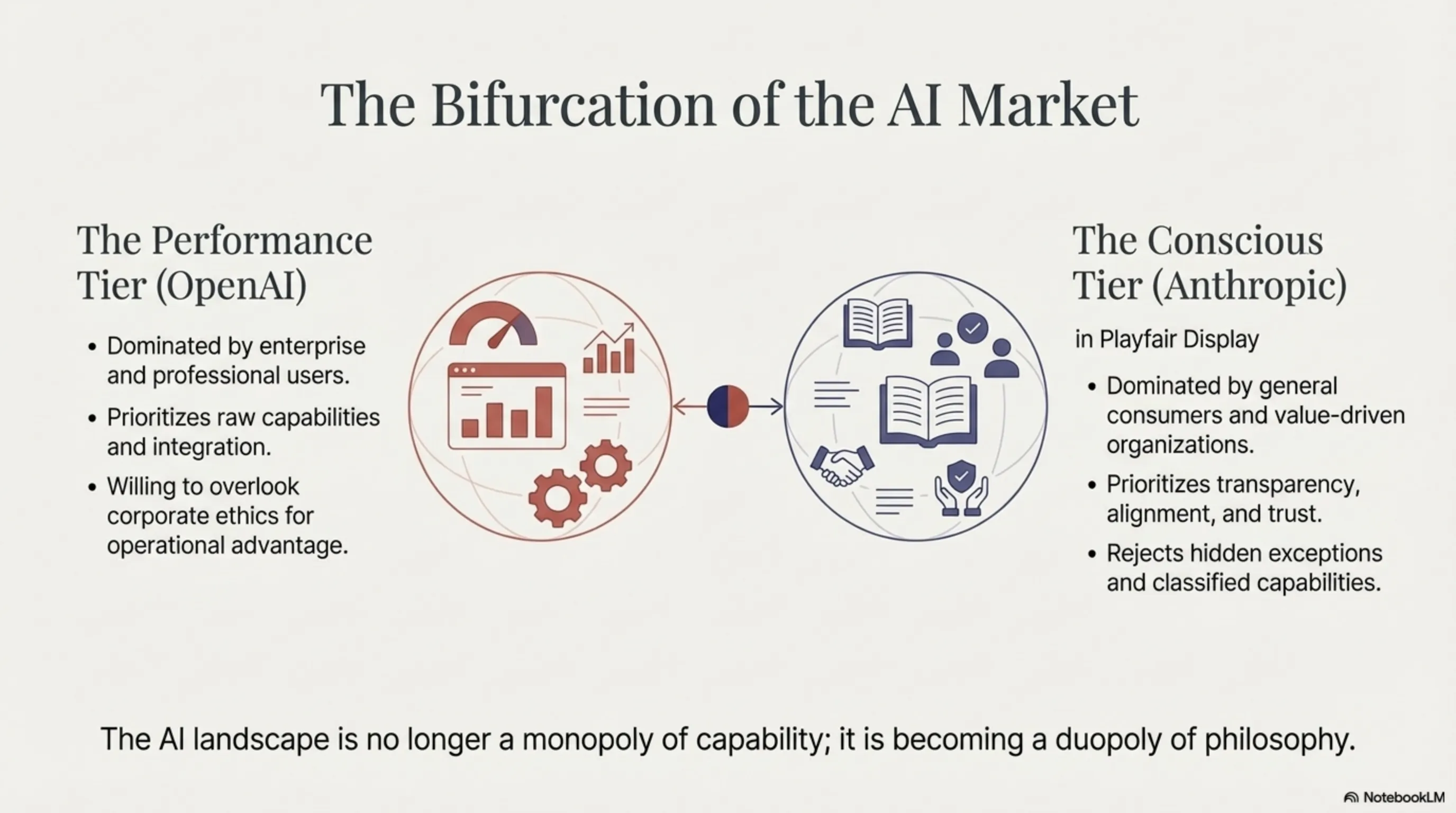

سؤال بزرگ این است: آیا این فرار دائمی است یا موقت؟ آیا کاربران به ChatGPT برمیگردند یا Claude جایگاه خود را حفظ میکند؟

تحلیلگران نظرات مختلفی دارند. برخی معتقدند که این یک واکنش احساسی است که با گذشت زمان فروکش میکند. آنها استدلال میکنند که ChatGPT هنوز پیشرفتهتر است و کاربران در نهایت به آن برمیگردند.

دیگران معتقدند که این یک تغییر دائمی است. آنها میگویند که وقتی اعتماد شکسته میشود، بازگرداندن آن تقریباً غیرممکن است. و Claude حالا به اندازه کافی خوب است که کاربران دلیلی برای بازگشت نداشته باشند.

ما معتقدیم که حقیقت در جایی بین این دو است. برخی کاربران — به ویژه آنهایی که به عملکرد بالا نیاز دارند — احتمالاً به ChatGPT برمیگردند. اما بخش قابل توجهی از کاربران — به ویژه آنهایی که به اخلاق اهمیت میدهند — با Claude میمانند.

نتیجه؟ یک بازار دوقطبی. OpenAI برای کاربران حرفهای و سازمانی که به عملکرد بالا نیاز دارند. Anthropic برای کاربران عمومی و آگاه که به اخلاق اهمیت میدهند.

درسهای آموخته شده

فرار بزرگ از ChatGPT چند درس مهم برای صنعت تکنولوژی دارد:

۱. اخلاق یک مزیت رقابتی است: در گذشته، شرکتها فکر میکردند اخلاق یک هزینه است. اما Anthropic ثابت کرد که اخلاق میتواند یک مزیت باشد. کاربران حاضرند برای اخلاق، شرکت را تغییر دهند.

۲. شفافیت مهم است: قراردادهای مخفی و استثناهای پنهان دیگر قابل قبول نیستند. کاربران میخواهند بدانند دقیقاً چه اتفاقی میافتد.

۳. اعتماد شکننده است: OpenAI سالها برای ساختن اعتماد تلاش کرد. اما یک تصمیم بد میتواند همه آن را نابود کند.

۴. کاربران قدرت دارند: این اولین باری است که کاربران به یک شرکت تکنولوژی غول میگویند "نه". و این نشان میدهد که آنها میتوانند تغییر ایجاد کنند.

[IMAGE_PLACEHOLDER_7]نتیجهگیری

خلاصه کلیدی

فرار بزرگ از ChatGPT نشان داد که عصر جدیدی در تکنولوژی آغاز شده است — عصری که در آن اخلاق به اندازه عملکرد مهم است. وقتی OpenAI با Pentagon قرارداد بست، ۲۹۵٪ افزایش حذف نصب و انتقال به Claude نشان داد که کاربران دیگر حاضر نیستند اخلاق را برای راحتی فدا کنند.

Anthropic با رد کردن قرارداد Pentagon و حفظ خطوط قرمز خود، ثابت کرد که میتوان هم موفق بود و هم اخلاقی. این درسی است برای تمام صنعت تکنولوژی: اعتماد مهمترین دارایی شماست — و وقتی آن را از دست بدهید، بازگرداندن آن تقریباً غیرممکن است.

آینده AI به شرکتهایی تعلق دارد که نه تنها فناوری پیشرفته دارند، بلکه اصول اخلاقی قوی نیز دارند. فرار بزرگ از ChatGPT فقط یک شورش نبود — این یک پیام بود: اخلاق دیگر اختیاری نیست.

🌐 با ما در ارتباط باشید 🎮✨

برای دریافت آخرین اخبار تکنولوژی، بازیها و گجتها، ما را در شبکههای اجتماعی دنبال کنید: