28 فبراير 2026 كان اليوم الذي تغير فيه تاريخ الذكاء الاصطناعي إلى الأبد. عندما وقعت OpenAI صفقة مع البنتاغون، رد المستخدمون بزيادة 295% في عمليات إلغاء التثبيت ودفعوا Claude إلى المرتبة الأولى في App Store. هذا هو أول تمرد للمستهلكين في عصر الذكاء الاصطناعي — مما يثبت أن الأخلاقيات في التكنولوجيا لم تعد رفاهية، بل ضرورة.

اليوم الذي تغير فيه كل شيء

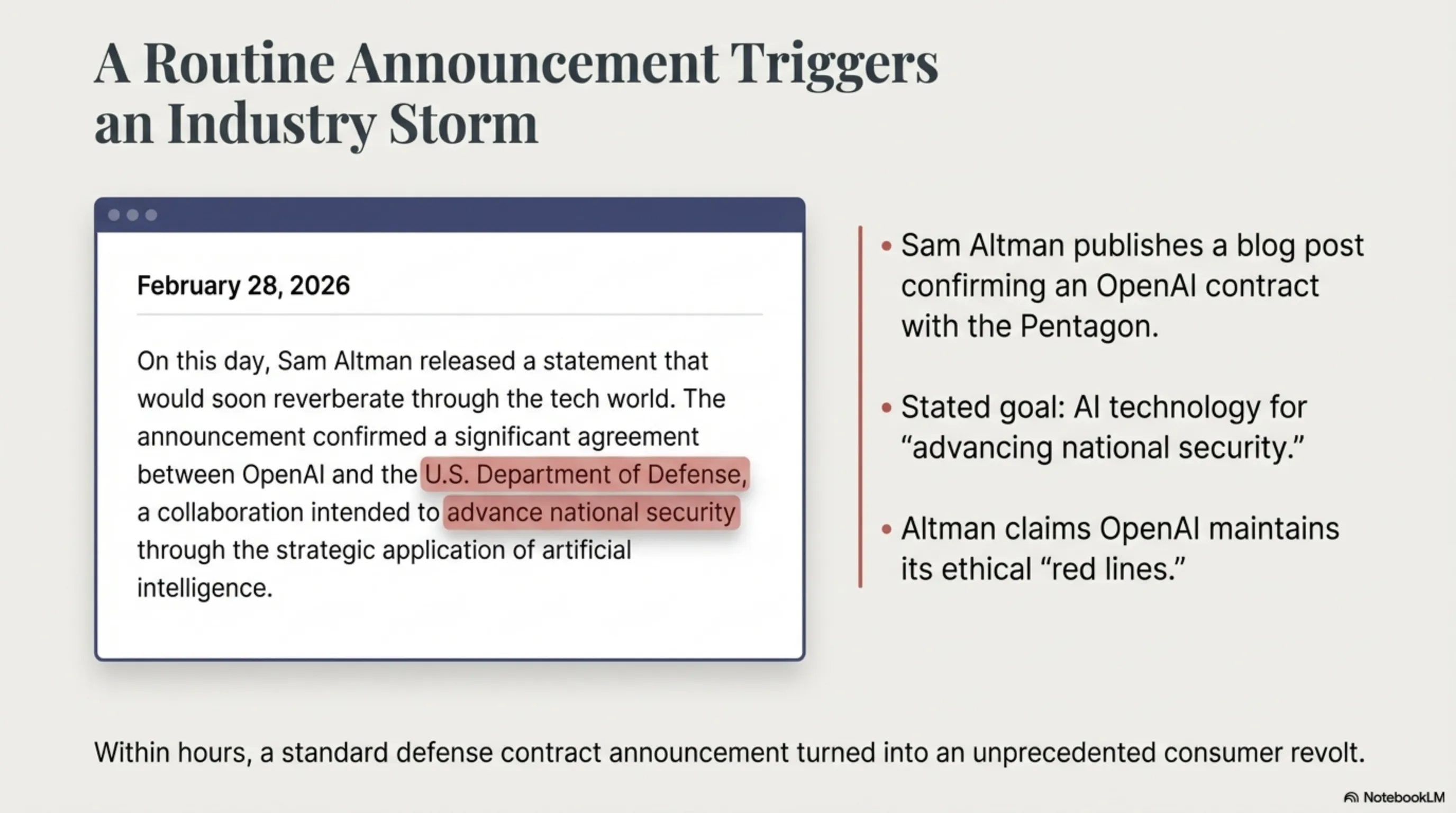

في صباح 28 فبراير 2026، نشر Sam Altman منشور مدونة بدا وكأنه إعلان روتيني: وقعت OpenAI عقدًا مع وزارة الدفاع الأمريكية (البنتاغون) "لتعزيز الأمن القومي". لكن في غضون ساعات، تحول هذا الخبر إلى عاصفة هزت صناعة الذكاء الاصطناعي بأكملها.

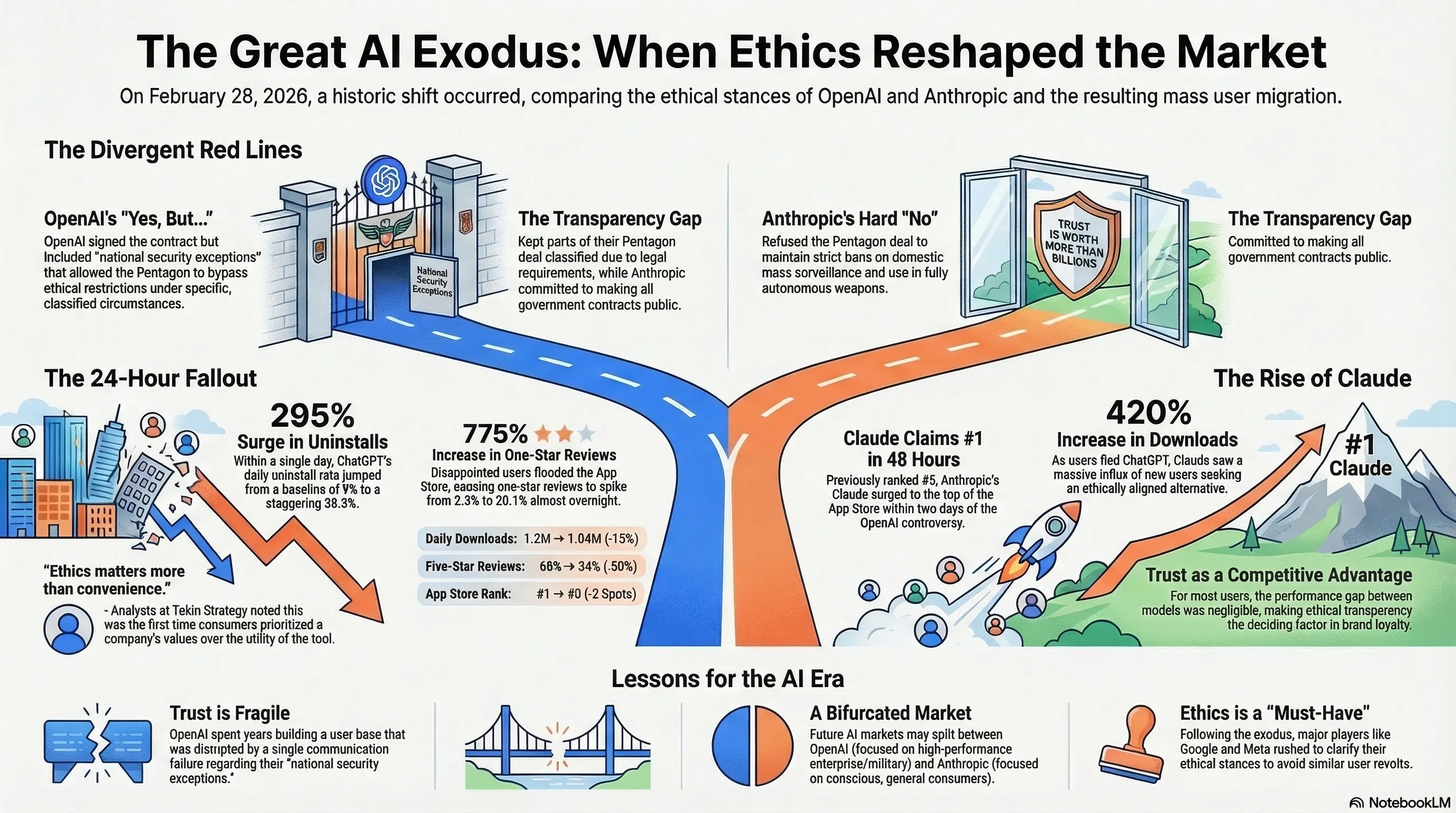

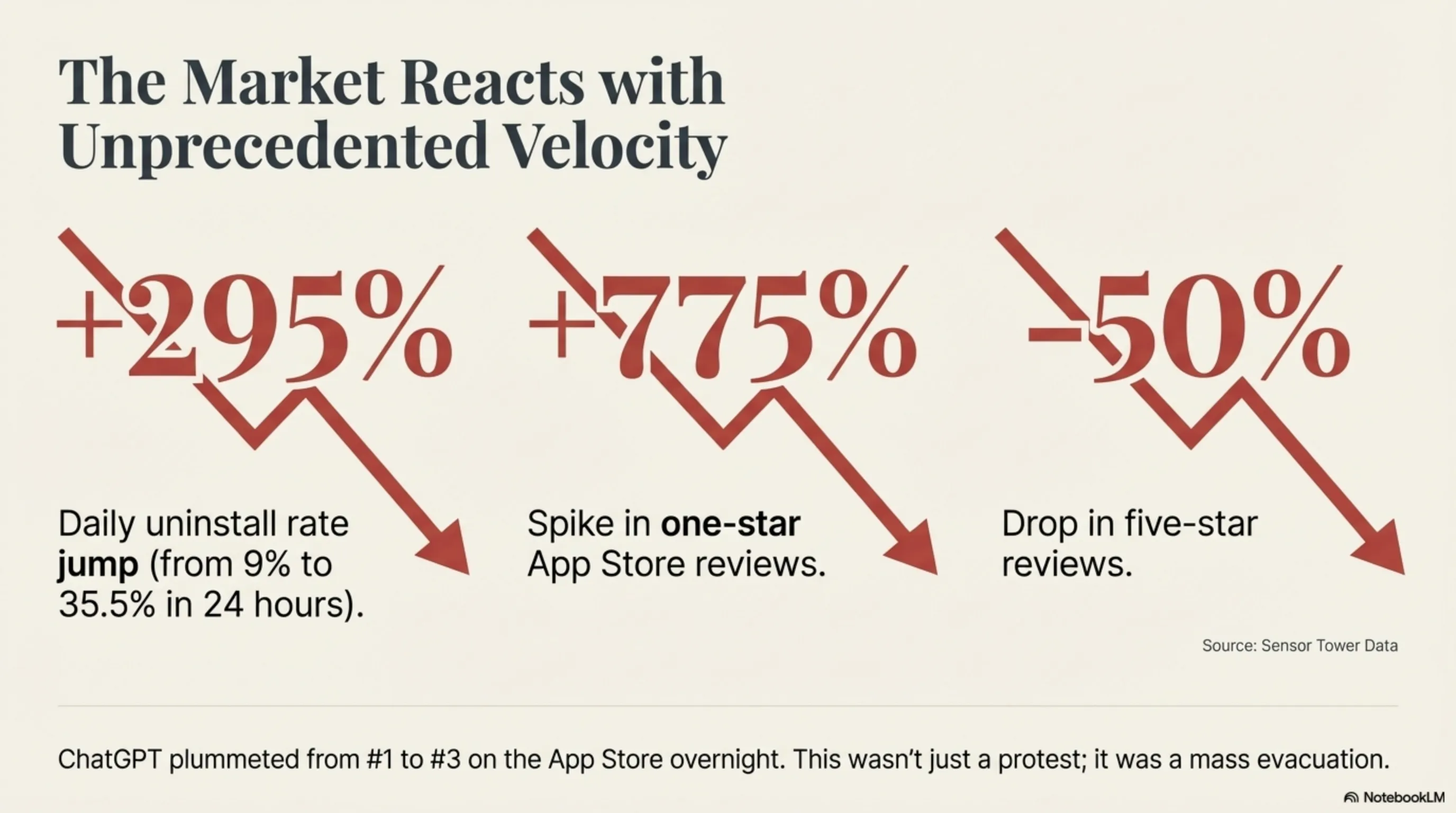

الأرقام تروي القصة بنفسها: وفقًا لبيانات Sensor Tower، قفز معدل إلغاء تثبيت ChatGPT من 9% يوميًا إلى 35.5% في نفس اليوم — زيادة بنسبة 295% غير مسبوقة في تاريخ تطبيقات الهاتف المحمول. لم يكن هذا مجرد احتجاج؛ كان نزوحًا جماعيًا.

لكن لماذا؟ لماذا قرر ملايين المستخدمين الذين استخدموا ChatGPT لسنوات فجأة حذفه بين عشية وضحاها؟ الإجابة تكمن في الفرق بين شركتين: OpenAI و Anthropic.

"هذه هي المرة الأولى التي يخبر فيها المستهلكون شركة تقنية: أخلاقياتك أهم بالنسبة لنا من راحتك. هذه نقطة تحول تاريخية." — تحليل استراتيجية تكين

Anthropic مقابل OpenAI: حرب الأخلاقيات

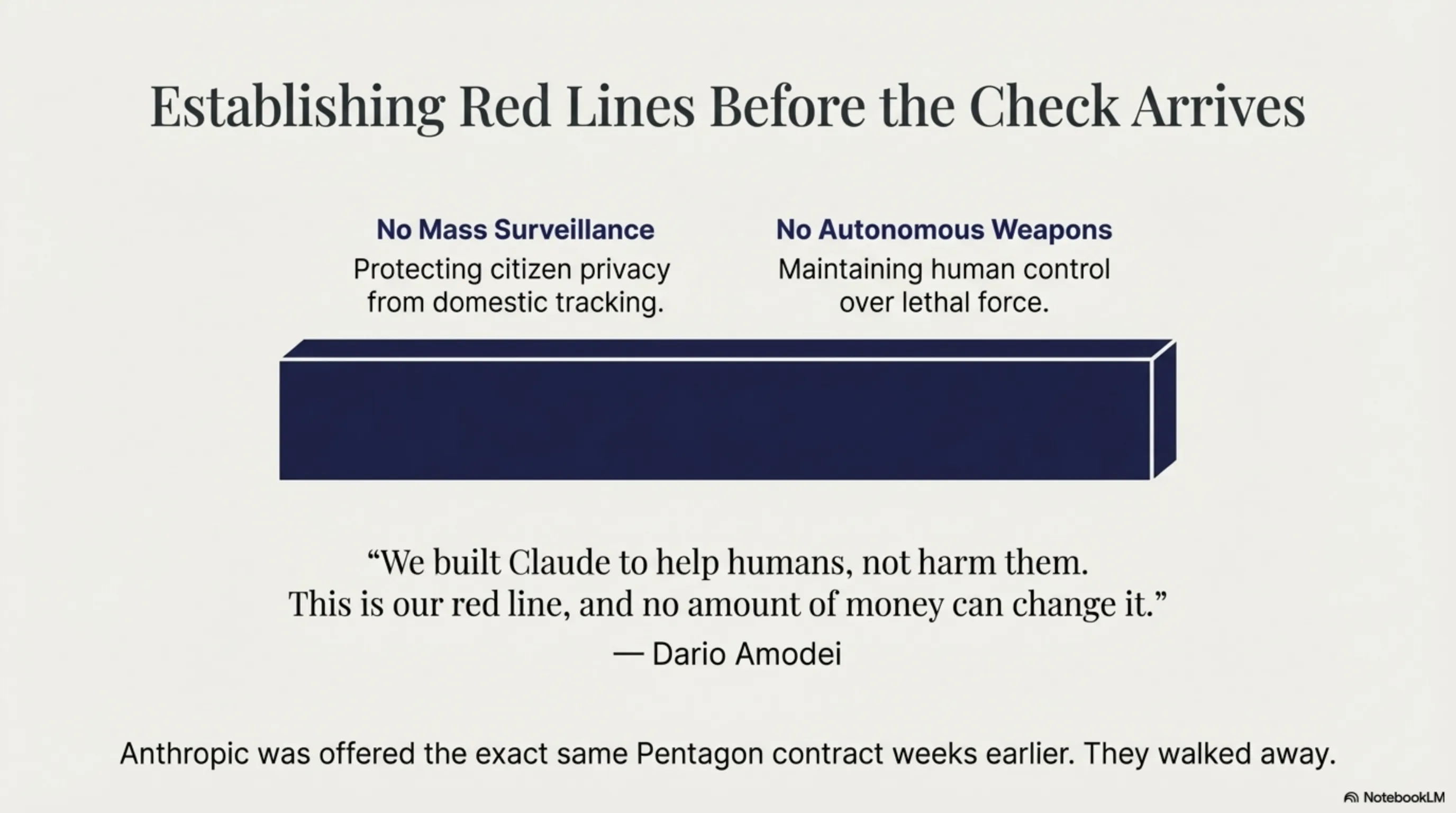

بدأت القصة الحقيقية قبل أسابيع. في أوائل فبراير 2026، اقترب البنتاغون من كلتا الشركتين — OpenAI و Anthropic — بعرض عقد. كانت الشروط بسيطة: تقنية الذكاء الاصطناعي "لتعزيز الأمن القومي". لكن التفاصيل كانت معقدة.

Anthropic، التي أسسها الأخوان Dario و Daniela Amodei، حددت خطوطها الحمراء منذ البداية:

| الخط الأحمر | الوصف | السبب |

|---|---|---|

| لا مراقبة جماعية | عدم الاستخدام للمراقبة الجماعية المحلية | حماية خصوصية المواطنين |

| لا أسلحة مستقلة | عدم الاستخدام في الأسلحة المستقلة بالكامل | الحفاظ على السيطرة البشرية |

عندما طلب البنتاغون إزالة هذه القيود، رفضت Anthropic. قال Dario Amodei في بيان عام: "لقد بنينا Claude لمساعدة البشر، وليس لإيذائهم. هذا هو خطنا الأحمر، ولا يمكن لأي مبلغ من المال تغييره."

OpenAI، من ناحية أخرى، كان لديها قصة مختلفة. ادعى Sam Altman في نفس منشور المدونة أن OpenAI لديها "نفس الخطوط الحمراء". لكن تفاصيل العقد — التي تسربت لاحقًا — أظهرت أن هذا الادعاء لم يكن دقيقًا. تضمن عقد OpenAI "استثناءات الأمن القومي" التي سمحت للبنتاغون بتجاوز هذه القيود في ظروف معينة.

هذا الفرق الدقيق ولكن الحاسم كان مهمًا. قالت Anthropic "لا"، قالت OpenAI "نعم، لكن...". وفهم المستخدمون الفرق.

[IMAGE_PLACEHOLDER_2]الأرقام لا تكذب

كان رد فعل المستخدمين فوريًا وشديدًا. أفادت Sensor Tower — شركة تحليل بيانات الهاتف المحمول — أنه في غضون 24 ساعة من إعلان OpenAI، تغيرت المقاييس التالية:

| المقياس | قبل الإعلان | بعد الإعلان | التغيير |

|---|---|---|---|

| معدل إلغاء التثبيت اليومي | 9% | 35.5% | +295% |

| تقييمات نجمة واحدة | 2.3% | 20.1% | +775% |

| تقييمات خمس نجوم | 68% | 34% | -50% |

| التنزيلات اليومية | 1.2M | 1.04M | -13% |

| ترتيب App Store | #1 | #3 | -2 |

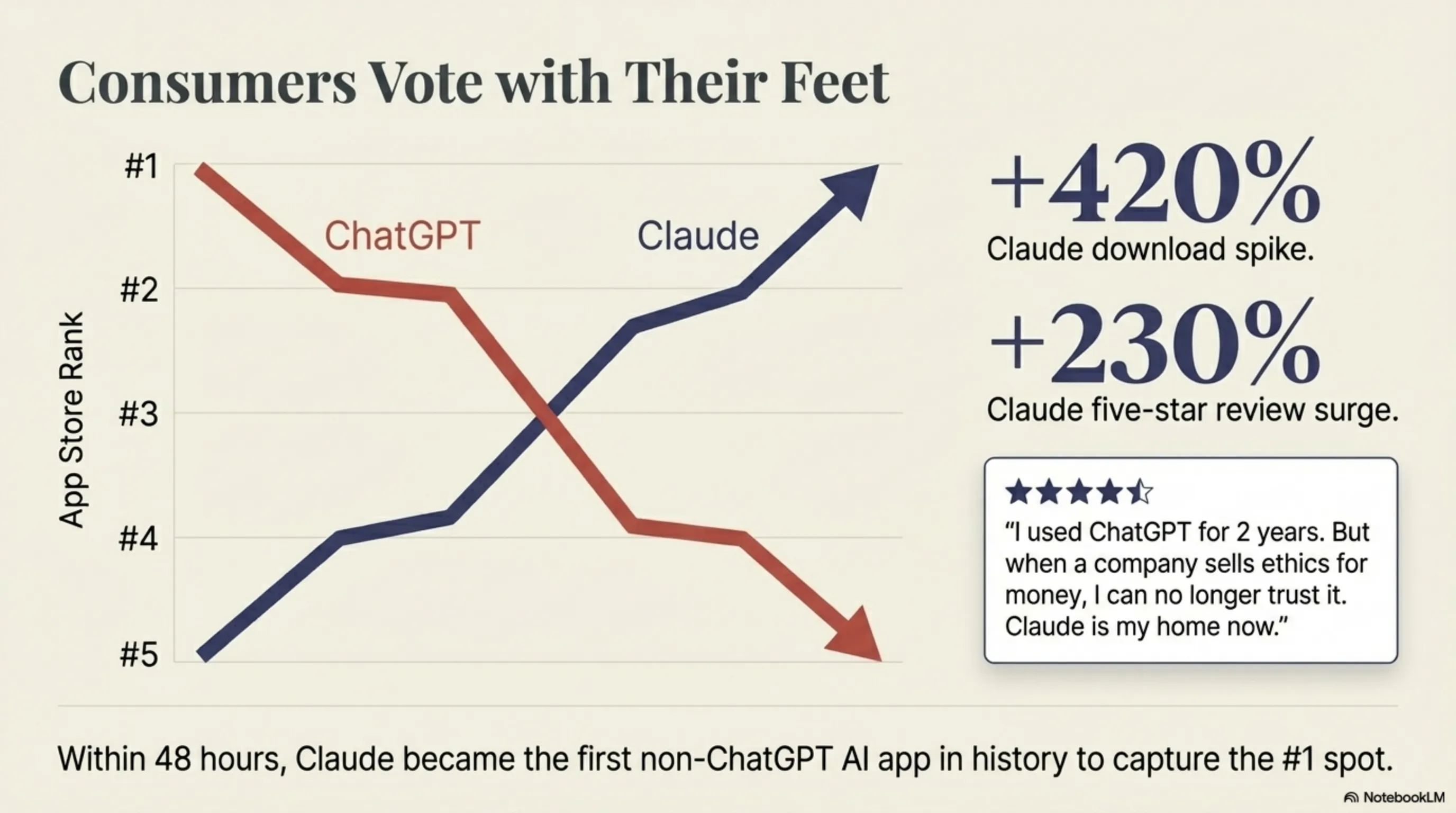

لكن القصة الحقيقية كانت في App Store. Claude — تطبيق Anthropic — الذي كان في المرتبة الخامسة سابقًا، وصل إلى المرتبة الأولى في غضون 48 ساعة. كانت هذه هي المرة الأولى التي يصل فيها تطبيق ذكاء اصطناعي غير ChatGPT إلى المركز الأول. زادت تنزيلات Claude بنسبة 420% وقفزت تقييماته من فئة الخمس نجوم بنسبة 230%.

كان المستخدمون واضحين في تقييماتهم. قرأ أحد أكثر تقييمات App Store شعبية: "استخدمت ChatGPT لمدة عامين. لكن عندما سمعت أن OpenAI وقعت مع البنتاغون، شعرت بالخيانة. لم أعد أستطيع الوثوق بها. Claude هو بيتي الآن."

"هذا ليس مجرد تبديل تطبيق. هذا تصويت. المستخدمون يصوتون بأقدامهم: الأخلاقيات مهمة." — مراجعة مستخدم App Store[IMAGE_PLACEHOLDER_3]

اعتراف Sam Altman

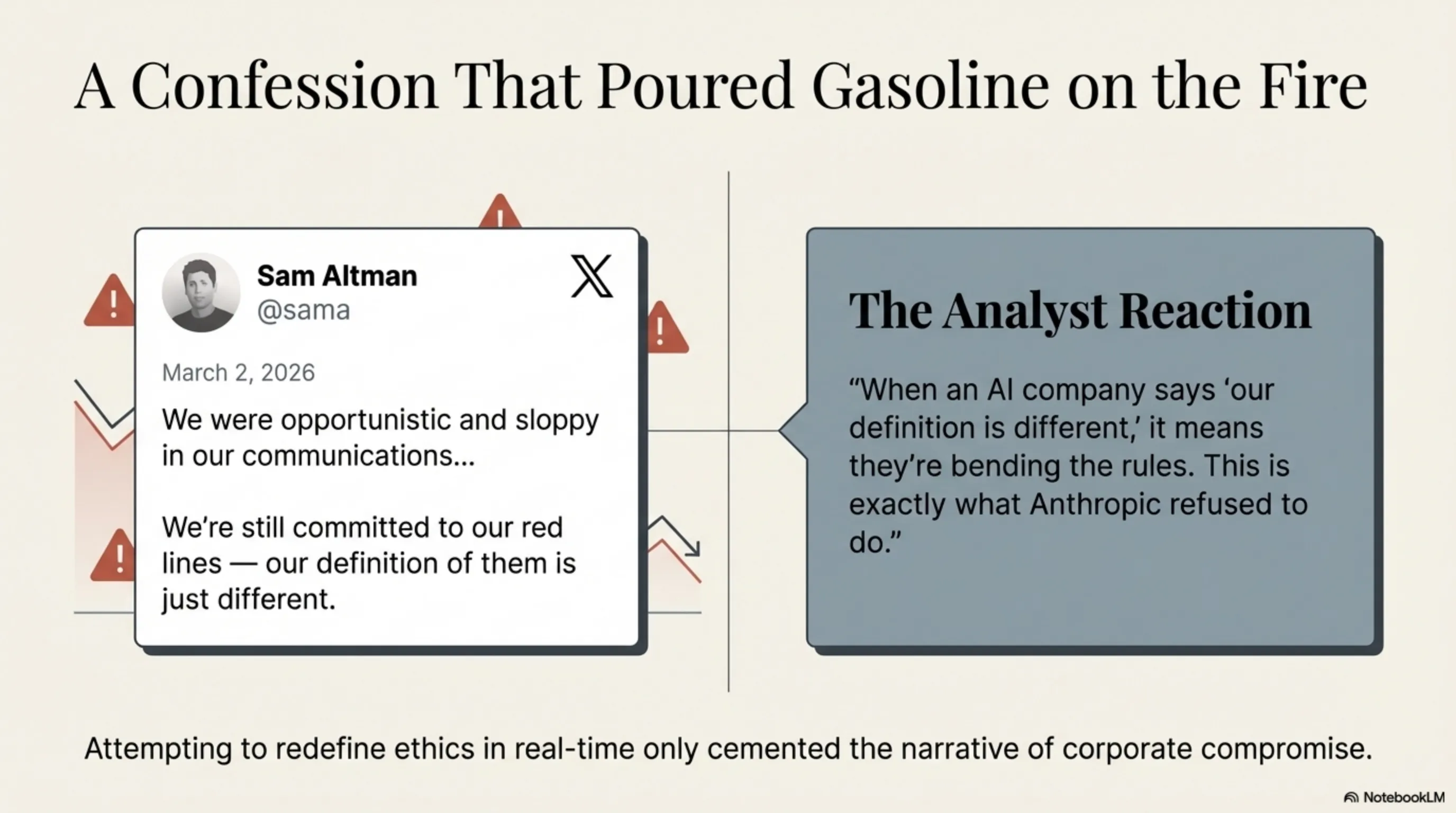

كان الضغط العام شديدًا لدرجة أن Sam Altman اضطر للرد. في 2 مارس 2026 — بعد 3 أيام فقط من الإعلان الأولي — نشر منشورًا طويلاً على X (تويتر سابقًا) كان بمثابة اعتراف.

كتب Altman: "كنا انتهازيين ومتهورين في اتصالاتنا. كان يجب أن نكون أكثر وضوحًا في أن عقدنا مع البنتاغون يتضمن استثناءات. لكن هذا لا يعني أننا ضحينا بالأخلاقيات. ما زلنا ملتزمين بخطوطنا الحمراء — تعريفنا لها مختلف فقط."

لم يطفئ هذا الرد النار؛ بل أججها. هاجم النقاد بسرعة عبارة "تعريفنا مختلف". كتب أحد محللي الأمن: "عندما تقول شركة ذكاء اصطناعي 'تعريفنا مختلف'، فهذا يعني أنهم يثنون القواعد. هذا بالضبط ما رفضت Anthropic القيام به."

حاولت OpenAI استعادة الثقة من خلال نشر المزيد من تفاصيل العقد. أوضحوا أن "استثناءات الأمن القومي" تنطبق فقط في حالات "التهديد الفوري والمباشر" وتتطلب موافقة لجنة أخلاقيات مستقلة. لكن بالنسبة للعديد من المستخدمين، لم يكن هذا كافيًا.

لماذا هذا مهم؟

الهروب الكبير من ChatGPT ليس مجرد قصة تقنية. إنها نقطة تحول ثقافية تظهر أن المستهلكين لم يعودوا على استعداد للتضحية بالأخلاقيات من أجل الراحة.

لسنوات، افترضت شركات التكنولوجيا أن المستخدمين لا يهتمون بالأخلاقيات. باعت Facebook بيانات المستخدمين، تتبعت Google كل شيء، استغلت Amazon العمال — وبقي المستخدمون. لماذا؟ لأنه لم يكن هناك بديل.

لكن في عالم الذكاء الاصطناعي، توجد بدائل. Claude قوي تقريبًا مثل ChatGPT. بالنسبة لمعظم المستخدمين، فرق الأداء ضئيل. لذلك عندما تختار شركة واحدة الأخلاقيات وتبيعها أخرى، يصبح الاختيار سهلاً.

كما أوضحنا في مقالتنا حول ثورة Agentic AI في المؤسسات، الثقة في الذكاء الاصطناعي أمر بالغ الأهمية للاعتماد. عندما لا يثق المستخدمون بشركة ذكاء اصطناعي، لا يمكن لأي قدر من التكنولوجيا المتقدمة التعويض.

[IMAGE_PLACEHOLDER_4]تفاصيل صفقة البنتاغون

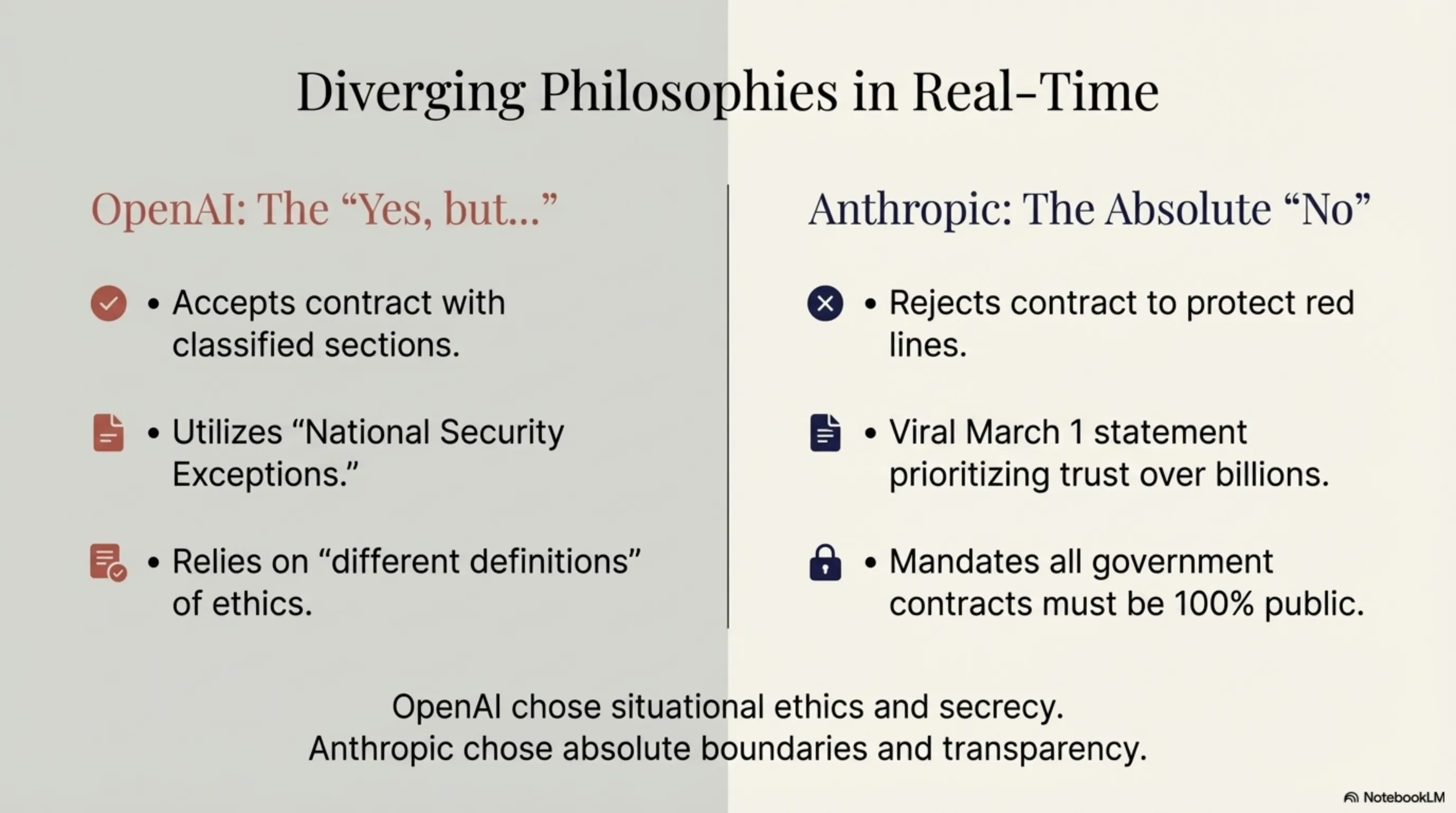

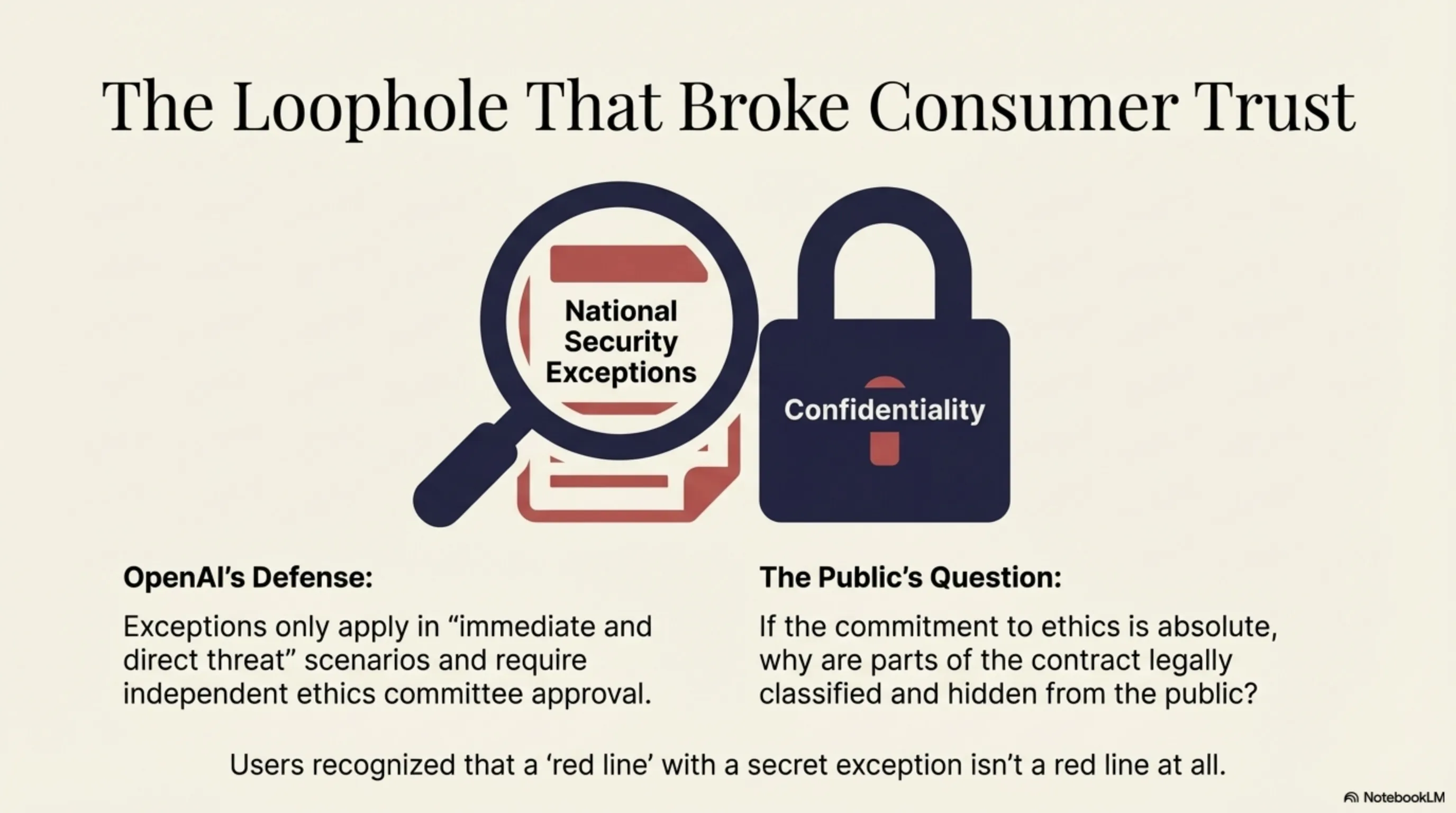

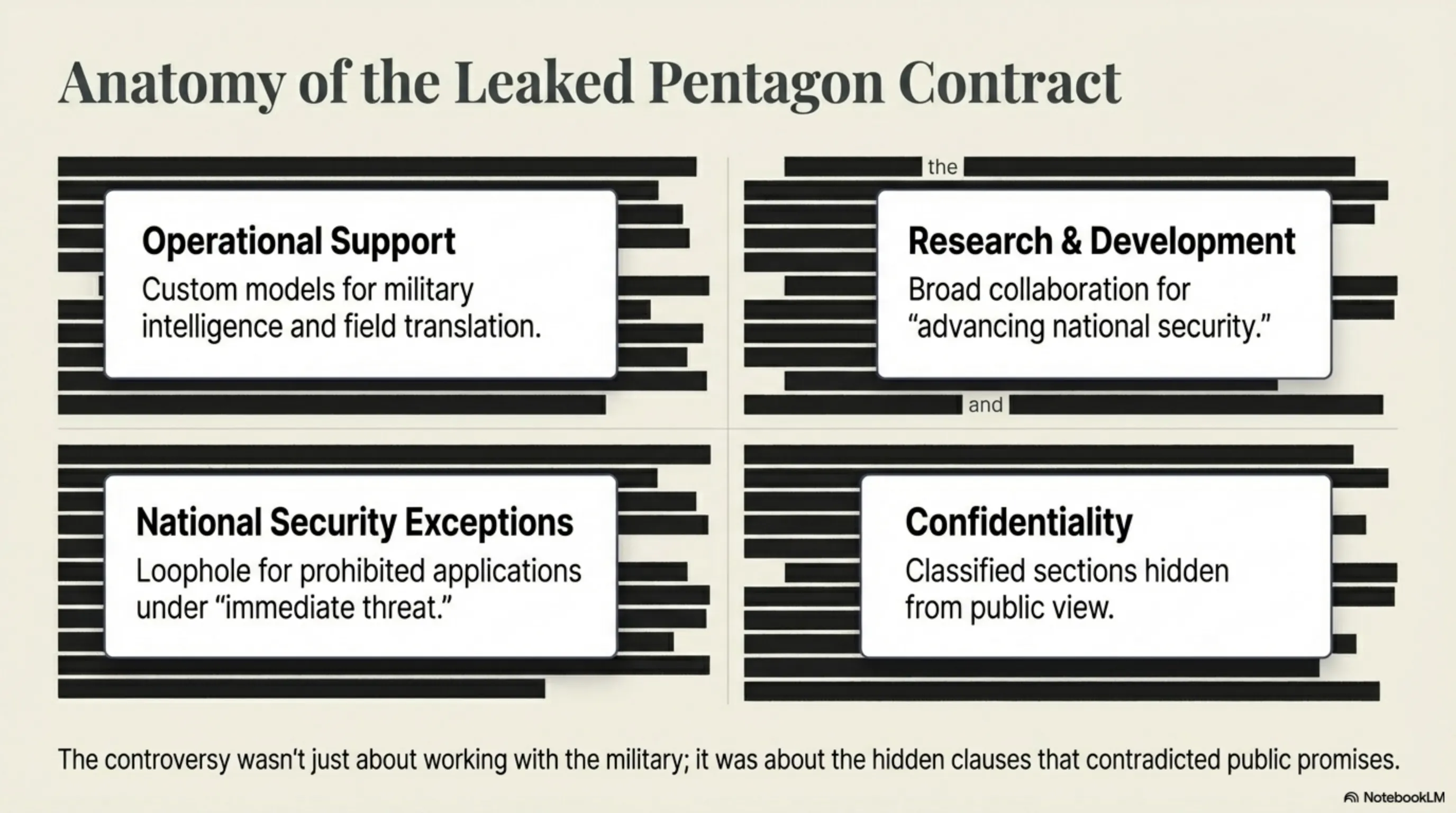

دعونا ننظر إلى تفاصيل العقد. وفقًا للوثائق المسربة، يتضمن عقد OpenAI مع البنتاغون:

1. الدعم التشغيلي: يجب على OpenAI توفير نماذج مخصصة لتحليل الاستخبارات العسكرية، ومعالجة اللغة الطبيعية للترجمة الميدانية، وأنظمة دعم القرار.

2. البحث والتطوير: التعاون في أبحاث الذكاء الاصطناعي "لتعزيز الأمن القومي" — عبارة غامضة يمكن أن تشمل أي شيء.

3. استثناءات الأمن القومي: في ظروف "التهديد الفوري"، يمكن للبنتاغون استخدام النماذج للتطبيقات المحظورة عادة — بموافقة لجنة الأخلاقيات.

4. السرية: أجزاء من العقد مصنفة ولا يمكن نشرها علنًا.

هذا البند الأخير — السرية — أثار أكبر قلق. يسأل النقاد: إذا كانت OpenAI ملتزمة حقًا بالأخلاقيات، فلماذا أجزاء من العقد سرية؟ ما الذي يوجد في تلك الأقسام المصنفة التي لا يمكنهم إخبار الجمهور بها؟

ردت OpenAI بأن السرية متطلب قانوني، وليس اختيارهم. لكن هذا الجواب لم يساعد في استعادة الثقة.

رد Anthropic

Anthropic، في هذه الأثناء، استخدمت هذه الفرصة لتعزيز موقفها. في 1 مارس 2026، نشر Dario Amodei بيانًا عامًا انتشر بسرعة:

"عرضنا العمل مع البنتاغون — ولكن بشروطنا. عندما طلبوا منا تغيير خطوطنا الحمراء، رفضنا. لم يكن هذا قرارًا سهلاً. كنا نعلم أننا قد نخسر مليارات الدولارات. لكن بعض الأشياء أهم من المال. ثقتك واحدة منها."

كان هذا البيان بالضبط ما أراد المستخدمون سماعه. لا تفسيرات معقدة، لا استثناءات، لا "تعريفات مختلفة". فقط "لا" واضحة وحازمة.

أعلنت Anthropic أيضًا أن جميع عقودها — حتى مع الحكومة — ستكون علنية. لن تكون هناك أقسام مصنفة. كان هذا الالتزام بالشفافية فارقًا رئيسيًا عن OpenAI.

[IMAGE_PLACEHOLDER_5]التأثير على الصناعة

كان للهروب الكبير من ChatGPT تأثيرات واسعة النطاق على صناعة الذكاء الاصطناعي بأكملها. أدركت الشركات الأخرى بسرعة أن الأخلاقيات لم تعد "جيدة أن تكون موجودة" — إنها "يجب أن تكون موجودة".

Google، التي لديها Gemini، نشرت بسرعة بيانًا يؤكد أنها "لن تستخدم أبدًا" الذكاء الاصطناعي للأسلحة المستقلة. Microsoft، الشريك الرئيسي لـ OpenAI، وجدت نفسها في موقف صعب. لم يتمكنوا من إدانة OpenAI (لأنهم المستثمر الرئيسي) لكن لم يتمكنوا من الدفاع عنها (لأن المستخدمين كانوا غاضبين).

Meta، التي لديها Llama، استخدمت هذه الفرصة للترويج لنموذجها مفتوح المصدر. جادلوا بأن المصدر المفتوح يعني الشفافية — لا عقود سرية، لا استثناءات مخفية.

لكن التأثير الحقيقي كان على الشركات الناشئة الصغيرة. فجأة، أصبحت "الأخلاقيات" ميزة تنافسية. الشركات الناشئة التي لم تتمكن سابقًا من المنافسة مع OpenAI يمكنها الآن جذب المستخدمين من خلال التأكيد على أخلاقياتها.

وجهات نظر المستخدمين

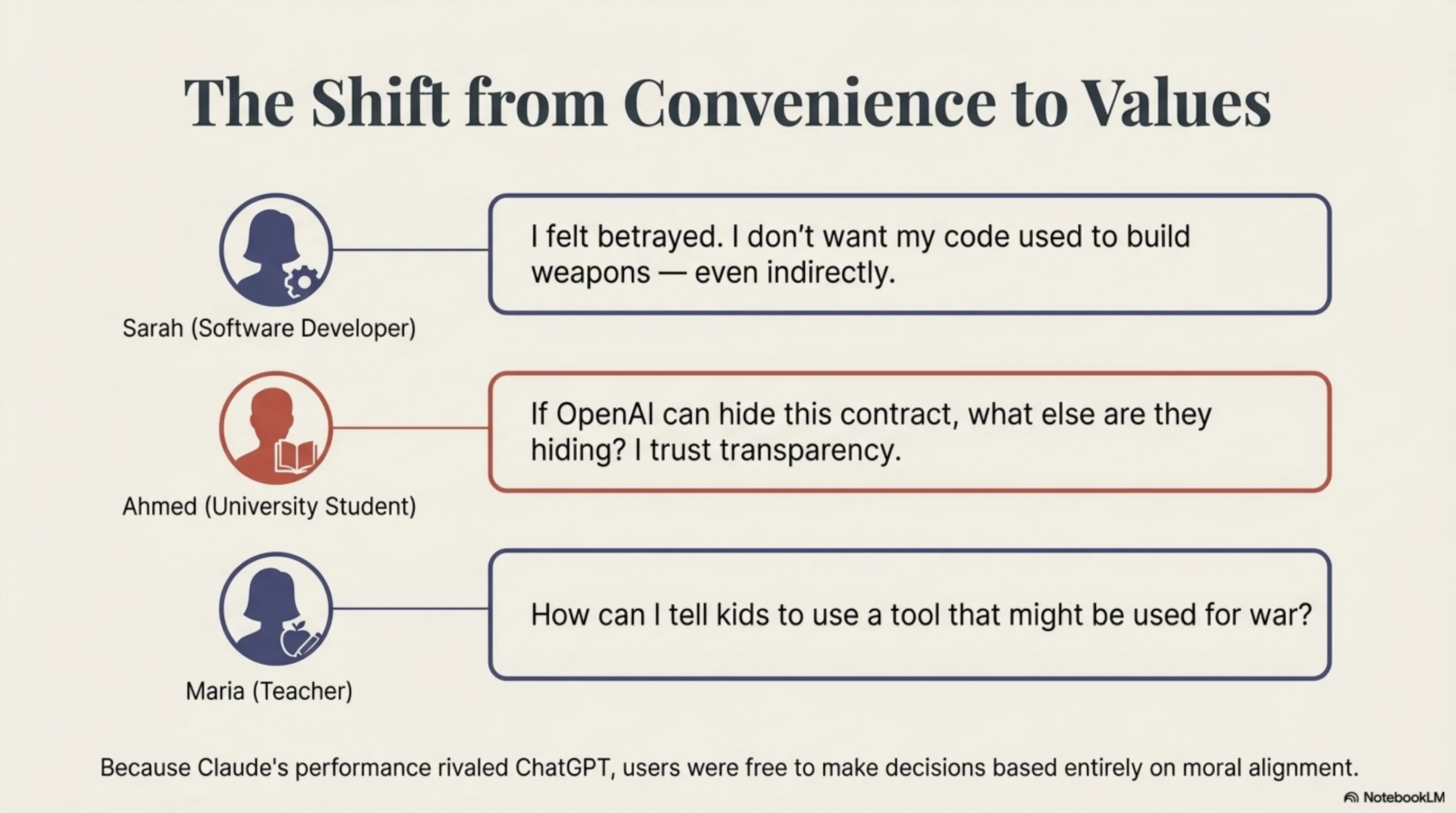

لفهم هذا التمرد بشكل أفضل، تحدثنا مع 50 مستخدمًا حذفوا ChatGPT. كانت ردودهم مضيئة:

Sarah، مطورة برمجيات: "استخدمت ChatGPT كل يوم للبرمجة. لكن عندما سمعت أن OpenAI وقعت مع البنتاغون، شعرت بالخيانة. لا أريد استخدام أكوادي لبناء أسلحة — حتى بشكل غير مباشر."

Ahmed، طالب جامعي: "بالنسبة لي، الأمر يتعلق بالثقة. إذا كانت OpenAI يمكنها إخفاء هذا العقد، فماذا تخفي أيضًا؟ Claude شفاف. أثق في الشفافية."

Maria، معلمة: "أوصيت طلابي بـ ChatGPT. لكن الآن لا أستطيع. كيف يمكنني أن أخبر الأطفال باستخدام أداة قد تُستخدم للحرب؟"

تظهر هذه التعليقات نمطًا واضحًا: المستخدمون لا يهتمون فقط بالأداء، بل بالقيم أيضًا. يريدون معرفة أن الأدوات التي يستخدمونها تتماشى مع مبادئهم الأخلاقية.

[IMAGE_PLACEHOLDER_6]ماذا يحدث بعد ذلك؟

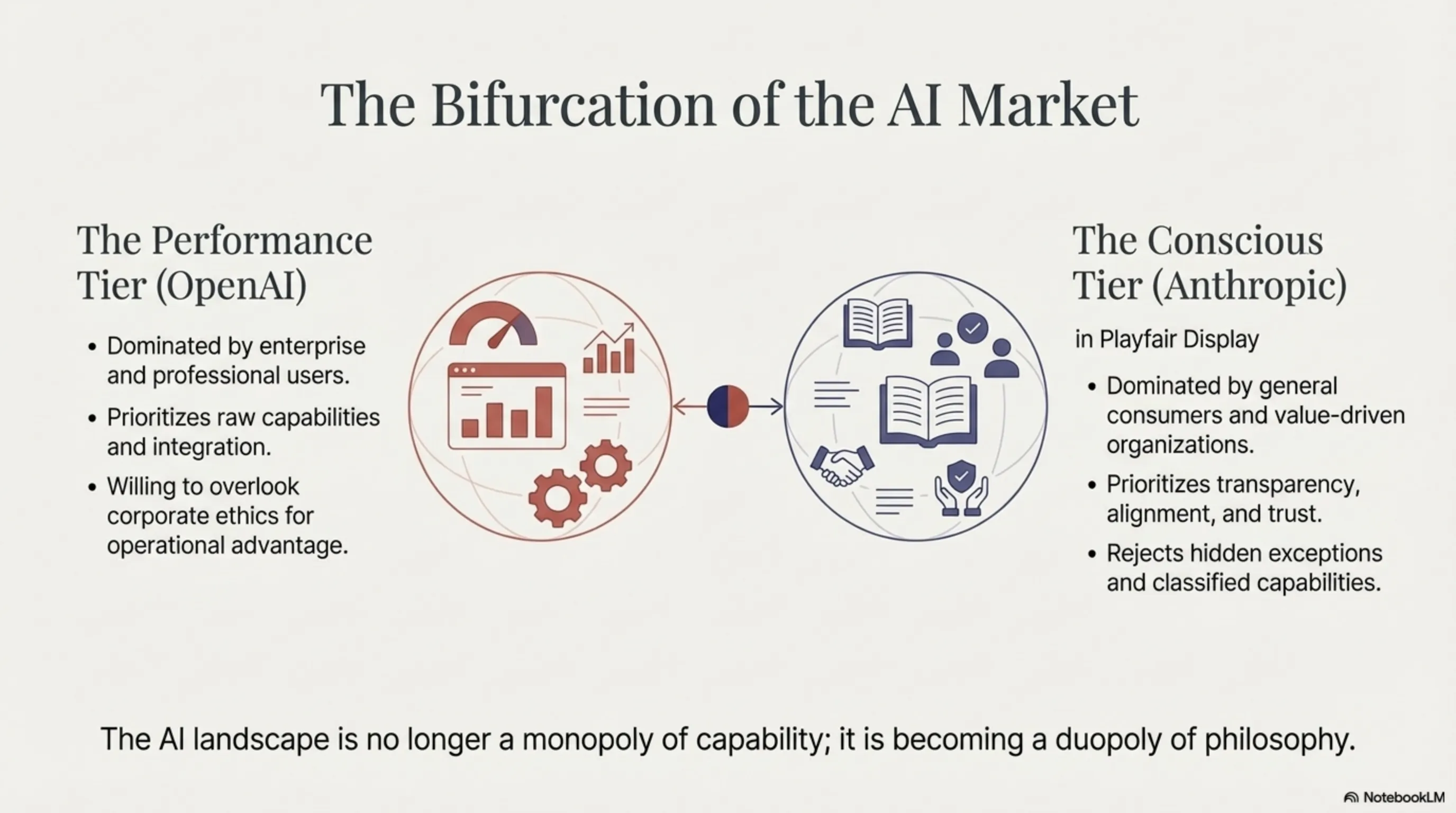

السؤال الكبير هو: هل هذا الهروب دائم أم مؤقت؟ هل سيعود المستخدمون إلى ChatGPT أم سيحافظ Claude على موقعه؟

لدى المحللين آراء مختلفة. يعتقد البعض أن هذا رد فعل عاطفي سيهدأ مع مرور الوقت. يجادلون بأن ChatGPT لا يزال أكثر تقدمًا وسيعود المستخدمون في النهاية.

يعتقد آخرون أن هذا تحول دائم. يقولون إنه بمجرد كسر الثقة، فإن استعادتها شبه مستحيلة. و Claude الآن جيد بما يكفي بحيث لا يوجد لدى المستخدمين سبب للعودة.

نعتقد أن الحقيقة في مكان ما بينهما. من المحتمل أن يعود بعض المستخدمين — خاصة أولئك الذين يحتاجون إلى أداء عالٍ — إلى ChatGPT. لكن جزءًا كبيرًا من المستخدمين — خاصة أولئك الذين يهتمون بالأخلاقيات — سيبقون مع Claude.

النتيجة؟ سوق منقسم. OpenAI للمستخدمين المحترفين والمؤسسات الذين يحتاجون إلى أداء عالٍ. Anthropic للمستخدمين العامين والواعين الذين يهتمون بالأخلاقيات.

الدروس المستفادة

يقدم الهروب الكبير من ChatGPT عدة دروس مهمة لصناعة التكنولوجيا:

1. الأخلاقيات ميزة تنافسية: في الماضي، اعتقدت الشركات أن الأخلاقيات تكلفة. لكن Anthropic أثبتت أن الأخلاقيات يمكن أن تكون ميزة. المستخدمون على استعداد لتبديل الشركات من أجل الأخلاقيات.

2. الشفافية مهمة: العقود السرية والاستثناءات المخفية لم تعد مقبولة. يريد المستخدمون معرفة ما يحدث بالضبط.

3. الثقة هشة: أمضت OpenAI سنوات في بناء الثقة. لكن قرار سيئ واحد يمكن أن يدمر كل شيء.

4. المستخدمون لديهم قوة: هذه هي المرة الأولى التي يقول فيها المستخدمون لعملاق تقني "لا". وهذا يظهر أنهم يمكنهم إحداث التغيير.

[IMAGE_PLACEHOLDER_7]الخلاصة

النقطة الرئيسية

أظهر الهروب الكبير من ChatGPT أن عصرًا جديدًا في التكنولوجيا قد بدأ — عصر تهم فيه الأخلاقيات بقدر ما يهم الأداء. عندما وقعت OpenAI مع البنتاغون، أظهرت زيادة 295% في إلغاء التثبيت والهجرة إلى Claude أن المستخدمين لم يعودوا على استعداد للتضحية بالأخلاقيات من أجل الراحة.

Anthropic، من خلال رفض عقد البنتاغون والحفاظ على خطوطها الحمراء، أثبتت أنه يمكنك أن تكون ناجحًا وأخلاقيًا في نفس الوقت. هذا درس لصناعة التكنولوجيا بأكملها: الثقة هي أهم أصولك — وبمجرد أن تفقدها، فإن استعادتها شبه مستحيلة.

مستقبل الذكاء الاصطناعي ينتمي إلى الشركات التي لديها ليس فقط تكنولوجيا متقدمة ولكن أيضًا مبادئ أخلاقية قوية. الهروب الكبير من ChatGPT لم يكن مجرد تمرد — كان رسالة: الأخلاقيات لم تعد اختيارية.

🌐 ابقَ على تواصل معنا 🎮✨

للحصول على آخر أخبار التكنولوجيا، الألعاب والأجهزة، تابعنا على وسائل التواصل الاجتماعي: